- Главная

- Разное

- Бизнес и предпринимательство

- Образование

- Развлечения

- Государство

- Спорт

- Графика

- Культурология

- Еда и кулинария

- Лингвистика

- Религиоведение

- Черчение

- Физкультура

- ИЗО

- Психология

- Социология

- Английский язык

- Астрономия

- Алгебра

- Биология

- География

- Геометрия

- Детские презентации

- Информатика

- История

- Литература

- Маркетинг

- Математика

- Медицина

- Менеджмент

- Музыка

- МХК

- Немецкий язык

- ОБЖ

- Обществознание

- Окружающий мир

- Педагогика

- Русский язык

- Технология

- Физика

- Философия

- Химия

- Шаблоны, картинки для презентаций

- Экология

- Экономика

- Юриспруденция

Что такое findslide.org?

FindSlide.org - это сайт презентаций, докладов, шаблонов в формате PowerPoint.

Обратная связь

Email: Нажмите что бы посмотреть

Презентация на тему Двоичное кодирование информации

Содержание

- 2. Информация и ее свойстваИнформация — это осознанные

- 3. Свойства информацииОбъективность информации. Объективный – существующий вне

- 4. Свойства информацииДостоверность информации. Информация достоверна, если она

- 5. Свойства информацииПолнота информации. Информацию можно назвать полной,

- 6. Свойства информацииАктуальность информации – важность для настоящего

- 7. Количество информацииКоличество информацииN = 2i

- 8. За единицу количества информации принимается такое количество

- 9. Производные единицы измерения количества информации.Минимальной единицей измерения

- 10. Информационная емкость знака. Сообщение кодируется с помощью

- 11. Формула N = 2i связывает между собой

- 12. С помощью этой формулы можно, например, определить

- 13. С помощью формулы N = 2i определим

- 14. Количество информации в сообщении. Сообщение состоит из последовательности знаков, каждый из которых несет определенное количество информации.

- 15. Если знаки несут одинаковое количество информации, то

- 16. Скачать презентацию

- 17. Похожие презентации

Информация и ее свойстваИнформация — это осознанные сведения об окружающем мире, которые являются объектом хранения, преобразования, передачи и использования.

Слайд 3

Свойства информации

Объективность информации. Объективный – существующий вне и

независимо от человеческого сознания. Информация – это отражение внешнего

объективного мира.Информация объективна, если она не зависит от методов ее фиксации, чьего-либо мнения, суждения.

Слайд 4

Свойства информации

Достоверность информации. Информация достоверна, если она отражает

истинное положение дел.

Объективная информация всегда достоверна, но достоверная

информация может быть как объективной, так и субъективной.

Слайд 5

Свойства информации

Полнота информации. Информацию можно назвать полной, если

ее достаточно для понимания и принятия решений. Неполная информация

может привести к ошибочному выводу или решению.Точность информации определяется степенью ее близости к реальному состоянию объекта, процесса, явления и т. п.

Слайд 6

Свойства информации

Актуальность информации – важность для настоящего времени,

злободневность, насущность. Только вовремя полученная информация может быть полезна.

Полезность (ценность) информации. Полезность может быть оценена применительно к нуждам конкретных ее потребителей и оценивается по тем задачам, которые можно решить с ее помощью.

Слайд 7

Количество информации

Количество информации

N = 2i

I = log2N

, где I – количество информации, которое

несет каждый символ;

N – полное количество символов в алфавите.Слайд 8 За единицу количества информации принимается такое количество информации,

которое содержится в информационном сообщении, уменьшающем неопределенность знания в

два раза.Такая единица названа битом.

Слайд 9

Производные единицы измерения количества информации.

Минимальной единицей измерения количества

информации является бит, а следующей по величине единицей -

байт, причем:1 байт = 8 битов = 23 битов.

1 килобайт (Кбайт) = 210 байт = 1024 байт;

1 мегабайт (Мбайт) = 210 Кбайт = 1024 Кбайт;

1 гигабайт (Гбайт) = 210 Мбайт = 1024 Мбайт.

Слайд 10

Информационная емкость знака.

Сообщение кодируется с помощью знаковой

системы, алфавит которой состоит из N знаков {1, ...,

N}Слайд 11 Формула N = 2i связывает между собой количество

возможных информационных сообщений N и количество информации I, которое

несет полученное сообщение.Слайд 12 С помощью этой формулы можно, например, определить количество

информации, которое несет знак в двоичной знаковой системе:

N =

2 => 2 = 2I => 21 = 2I => I=1 бит Таким образом, в двоичной знаковой системе знак несет 1 бит информации.

Слайд 13 С помощью формулы N = 2i определим количество

информации, которое несет буква русского алфавита:

N = 32 =>

32 = 2I => 25 = 2I => I=5 битов.Таким образом, буква русского алфавита несет 5 битов информации (при алфавитном подходе к измерению количества информации).

Слайд 14

Количество информации в сообщении.

Сообщение состоит из последовательности

знаков, каждый из которых несет определенное количество информации.

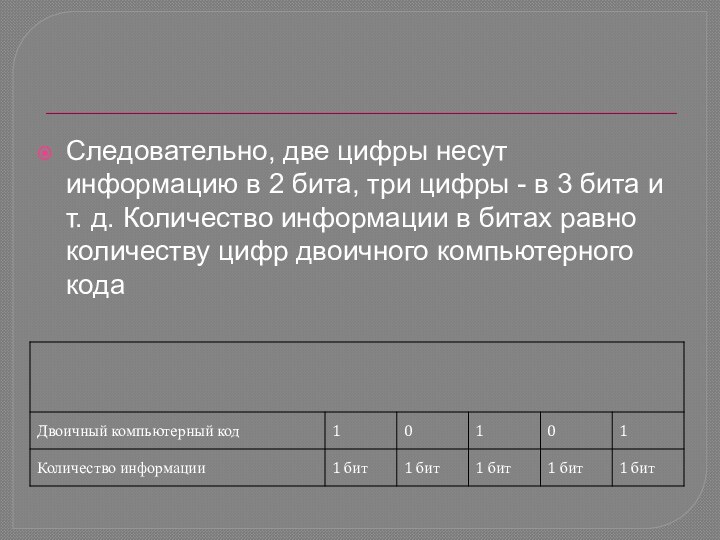

Слайд 15 Если знаки несут одинаковое количество информации, то количество

информации Ic в сообщении можно подсчитать, умножив количество информации

Iз, которое несет один знак, на длину кода (количество знаков в сообщении) К:Ic = Iз × K

Так, каждая цифра двоичного компьютерного кода несет информацию в 1 бит.