- Главная

- Разное

- Бизнес и предпринимательство

- Образование

- Развлечения

- Государство

- Спорт

- Графика

- Культурология

- Еда и кулинария

- Лингвистика

- Религиоведение

- Черчение

- Физкультура

- ИЗО

- Психология

- Социология

- Английский язык

- Астрономия

- Алгебра

- Биология

- География

- Геометрия

- Детские презентации

- Информатика

- История

- Литература

- Маркетинг

- Математика

- Медицина

- Менеджмент

- Музыка

- МХК

- Немецкий язык

- ОБЖ

- Обществознание

- Окружающий мир

- Педагогика

- Русский язык

- Технология

- Физика

- Философия

- Химия

- Шаблоны, картинки для презентаций

- Экология

- Экономика

- Юриспруденция

Что такое findslide.org?

FindSlide.org - это сайт презентаций, докладов, шаблонов в формате PowerPoint.

Обратная связь

Email: Нажмите что бы посмотреть

Презентация на тему Информация и цивилизация

Содержание

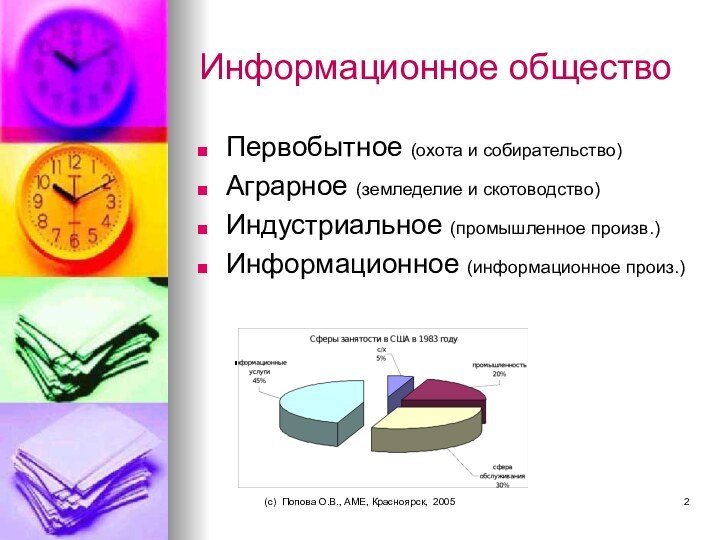

- 2. (c) Попова О.В., AME, Красноярск, 2005Информационное обществоПервобытное

- 3. (c) Попова О.В., AME, Красноярск, 2005Темпы роста объема информации

- 4. (c) Попова О.В., AME, Красноярск, 2005Цивилизация – это информация

- 5. (c) Попова О.В., AME, Красноярск, 2005Атрибуты общества

- 6. Информация и информатика

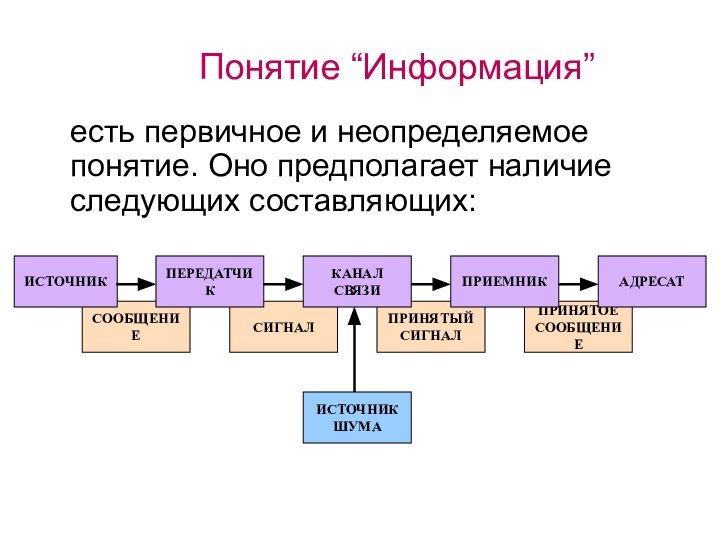

- 7. Понятие “Информация”есть первичное и неопределяемое понятие. Оно предполагает наличие следующих составляющих:

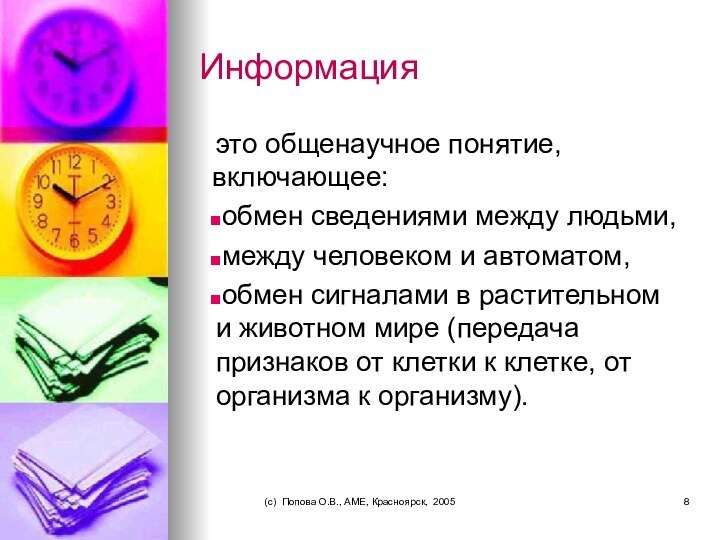

- 8. (c) Попова О.В., AME, Красноярск, 2005Информацияэто общенаучное

- 9. (c) Попова О.В., AME, Красноярск, 2005Информация в

- 10. (c) Попова О.В., AME, Красноярск, 2005Термин “Информация”происходит от латинского слова informatio – пояснение, разъяснение.

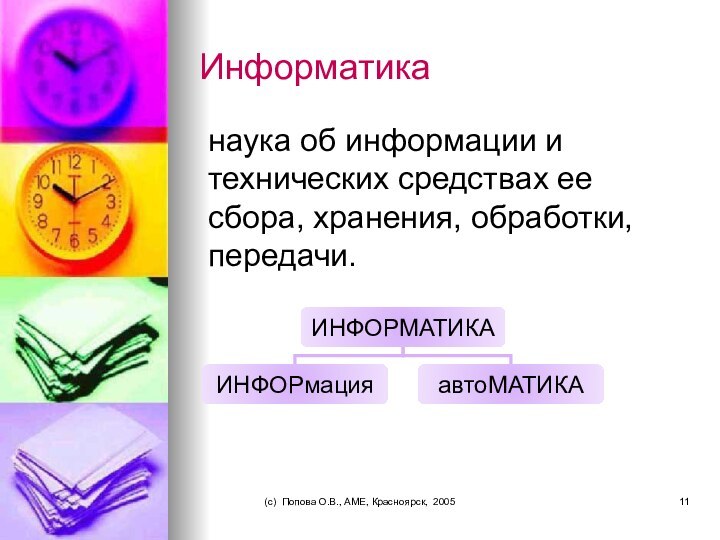

- 11. (c) Попова О.В., AME, Красноярск, 2005Информатиканаука об информации и технических средствах ее сбора, хранения, обработки, передачи.

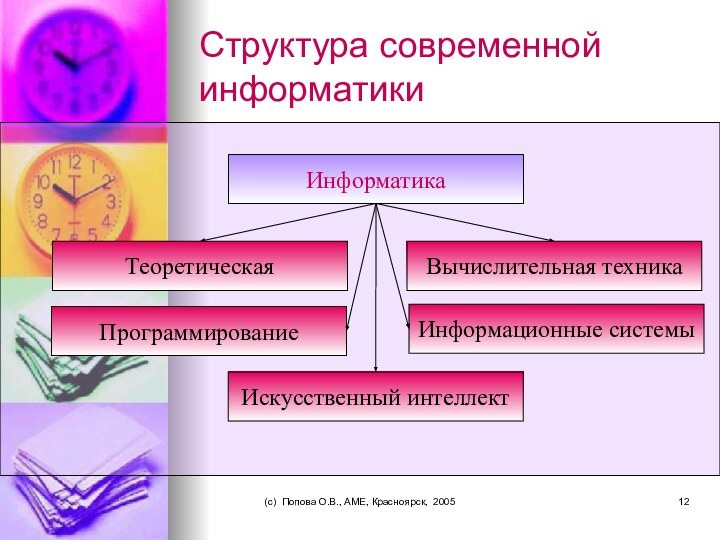

- 12. (c) Попова О.В., AME, Красноярск, 2005Структура современной информатикиИнформатикаТеоретическаяВычислительная техникаПрограммированиеИнформационные системыИскусственный интеллект

- 13. (c) Попова О.В., AME, Красноярск, 2005С термином

- 14. (c) Попова О.В., AME, Красноярск, 2005С термином

- 15. (c) Попова О.В., AME, Красноярск, 2005Данные /

- 16. (c) Попова О.В., AME, Красноярск, 2005С термином

- 17. Способы передачи информацииСигнал – любой процесс, несущий информацию

- 18. (c) Попова О.В., AME, Красноярск, 2005Способы передачи

- 19. (c) Попова О.В., AME, Красноярск, 2005Регистрация сигналов

- 20. Регистрация сигналов на носителях информации

- 21. (c) Попова О.В., AME, Красноярск, 2005 Сама

- 22. (c) Попова О.В., AME, Красноярск, 2005Способы передачи

- 23. (c) Попова О.В., AME, Красноярск, 2005Способы передачи

- 24. Классификация информации

- 25. (c) Попова О.В., AME, Красноярск, 2005По способу

- 26. (c) Попова О.В., AME, Красноярск, 2005По отношению к окружающей средевходнаявыходнаявнутренняя

- 27. (c) Попова О.В., AME, Красноярск, 2005По отношению к конечному результатуисходнаяпромежуточнаярезультирующая

- 28. (c) Попова О.В., AME, Красноярск, 2005В философском аспектеМировоззренческаяЭстетическаяРелигиознаяНаучнаяБытоваяТехническаяЭкономическаяТехнологическая

- 29. (c) Попова О.В., AME, Красноярск, 2005Качество информацииполнота

- 30. Информация-третья фундаментальная величинаВначале было слово. И слово было 2 байта ☺

- 31. (c) Попова О.В., AME, Красноярск, 2005В природе

- 32. (c) Попова О.В., AME, Красноярск, 2005Информационное взаимодействиеНесимметричное

- 33. (c) Попова О.В., AME, Красноярск, 2005Любые взаимодействия

- 34. (c) Попова О.В., AME, Красноярск, 2005

- 35. (c) Попова О.В., AME, Красноярск, 2005Ноосфера (noos

- 36. Количество информацииИнформация – снятая неопределенность Клод Шеннон

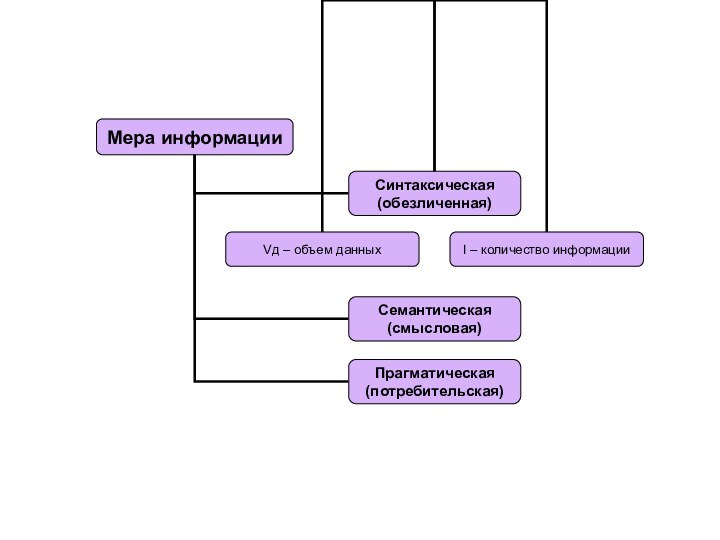

- 37. (c) Попова О.В., AME, Красноярск, 2005Синтаксическая —

- 39. Синтаксическая мера информацииоперирует с обезличенной информацией (данными), не выражающей смыслового отношения к объекту

- 40. (c) Попова О.В., AME, Красноярск, 2005Объем данных

- 41. (c) Попова О.В., AME, Красноярск, 2005Количество информации

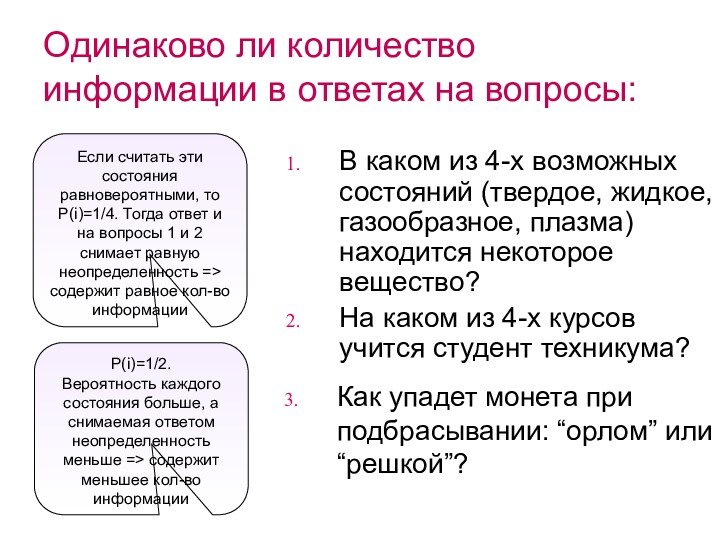

- 42. Одинаково ли количество информации в ответах на

- 43. (c) Попова О.В., AME, Красноярск, 2005Чем меньше

- 44. «Конкурс выиграет один из участников: A или

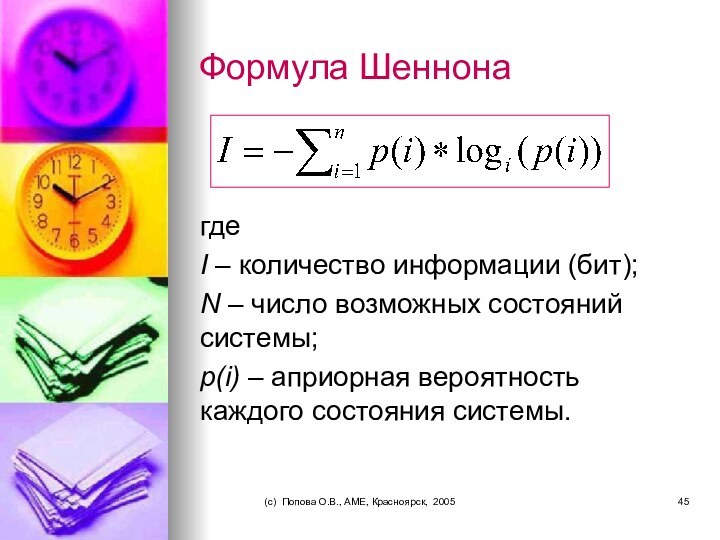

- 45. (c) Попова О.В., AME, Красноярск, 2005Формула Шеннонагде

- 46. (c) Попова О.В., AME, Красноярск, 2005Расчет количества информации по Шеннону

- 47. (c) Попова О.В., AME, Красноярск, 2005Расчет количества

- 48. (c) Попова О.В., AME, Красноярск, 2005БитКоличество информации,

- 49. (c) Попова О.В., AME, Красноярск, 2005БитЛампочка горит? (да/нет) – 1 бит информации (при равных вероятностях).

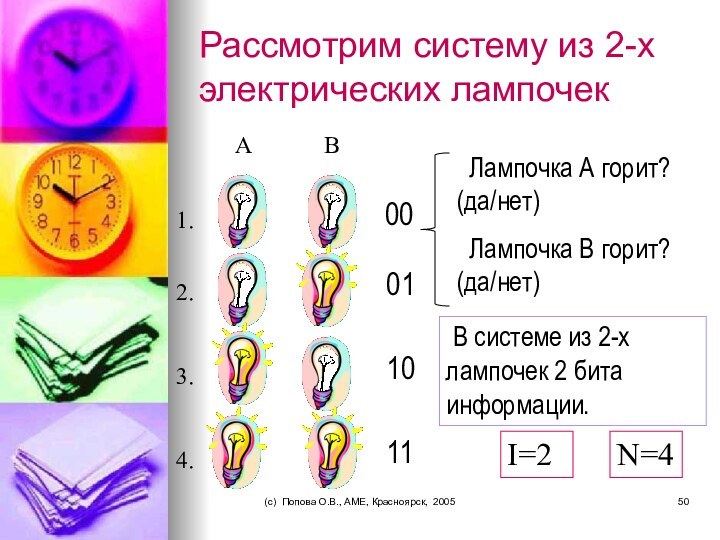

- 50. (c) Попова О.В., AME, Красноярск, 2005Рассмотрим систему

- 51. Рассмотрим систему из 2-х электрических лампочек

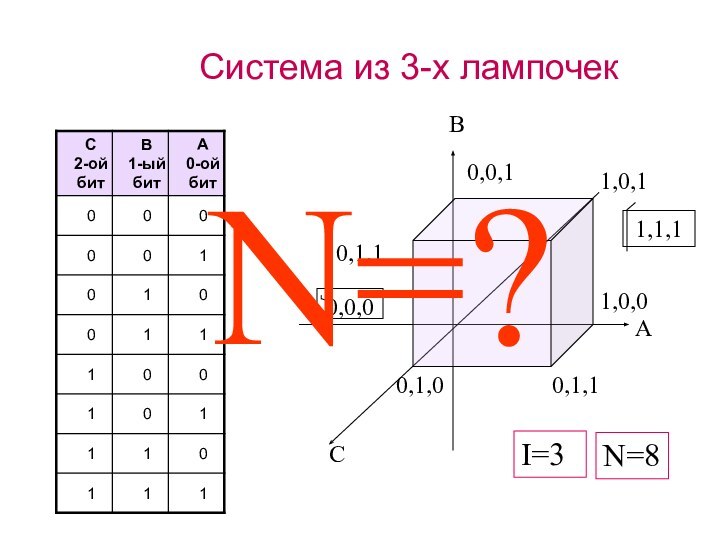

- 52. Система из 3-х лампочекN=?N=8I=3

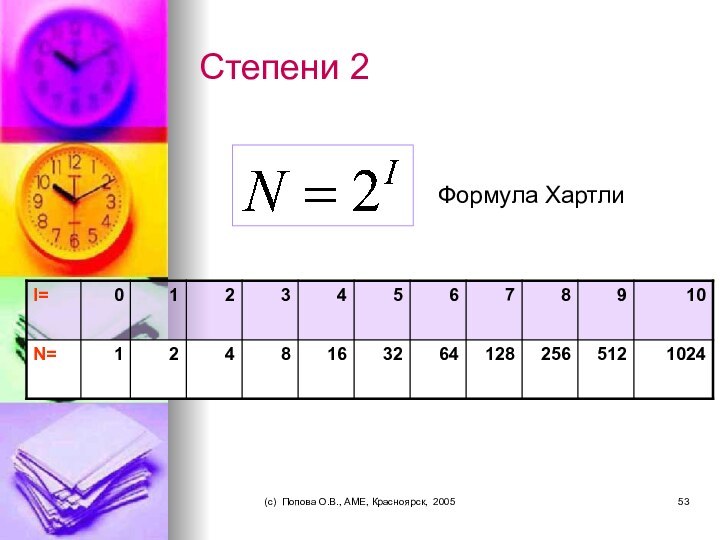

- 53. (c) Попова О.В., AME, Красноярск, 2005Степени 2

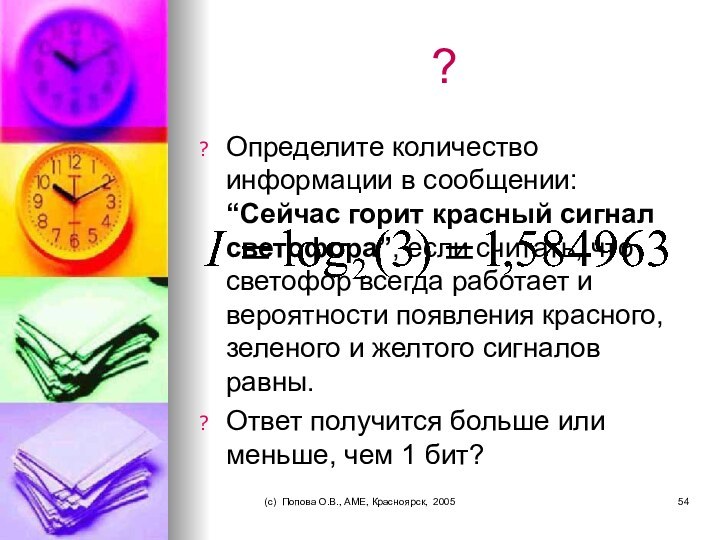

- 54. (c) Попова О.В., AME, Красноярск, 2005?Определите количество

- 55. (c) Попова О.В., AME, Красноярск, 2005БайтГруппа из

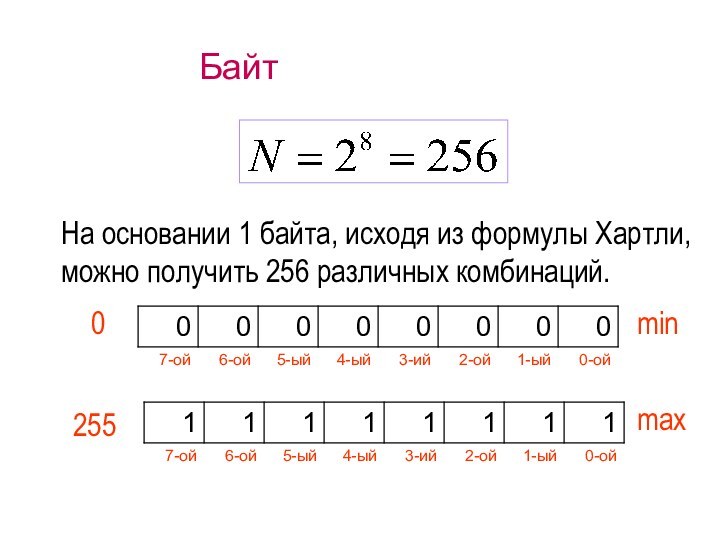

- 56. БайтНа основании 1 байта, исходя из формулы Хартли, можно получить 256 различных комбинаций.

- 57. (c) Попова О.В., AME, Красноярск, 20051 символ

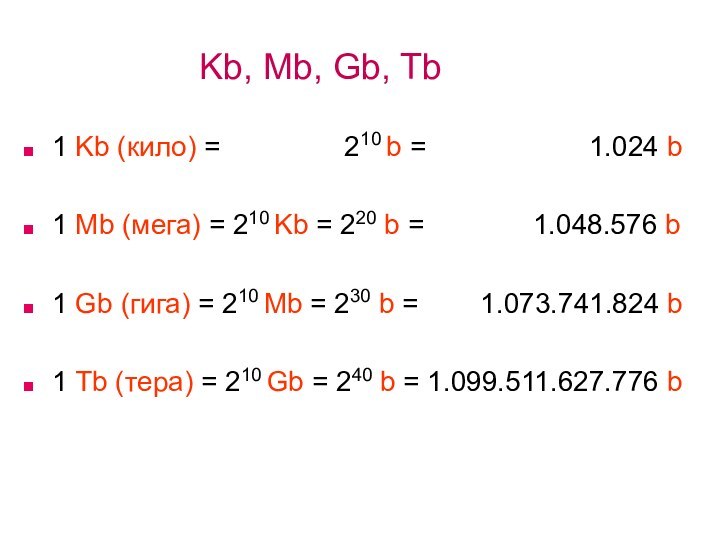

- 58. Kb, Mb, Gb, Tb1 Kb (кило) =

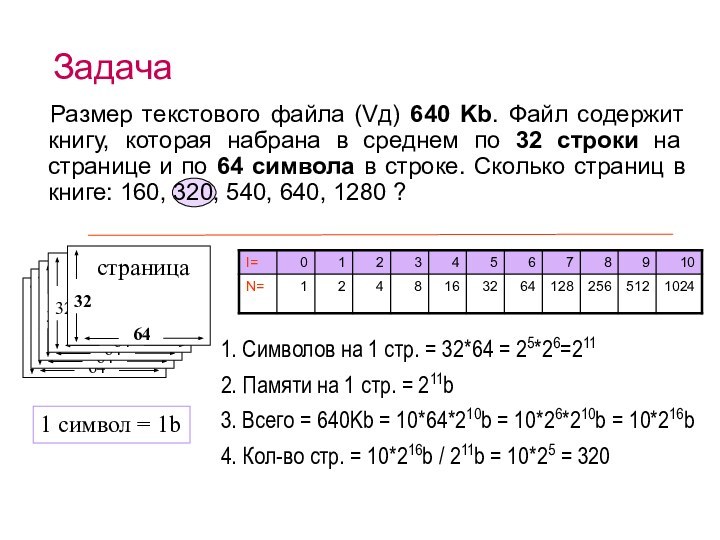

- 59. Размер текстового файла (Vд) 640 Kb. Файл

- 60. (c) Попова О.В., AME, Красноярск, 2005Информация и

- 61. (c) Попова О.В., AME, Красноярск, 2005Информация есть

- 62. (c) Попова О.В., AME, Красноярск, 2005?Увеличится или

- 63. (c) Попова О.В., AME, Красноярск, 2005Информация есть

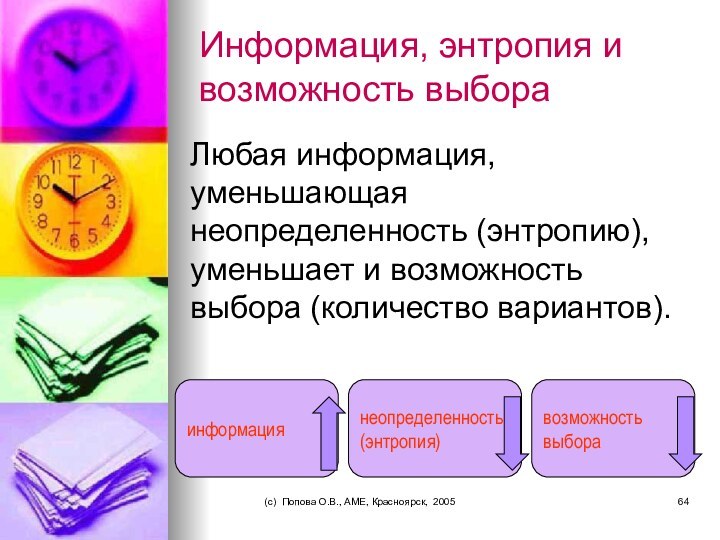

- 64. (c) Попова О.В., AME, Красноярск, 2005Информация, энтропия

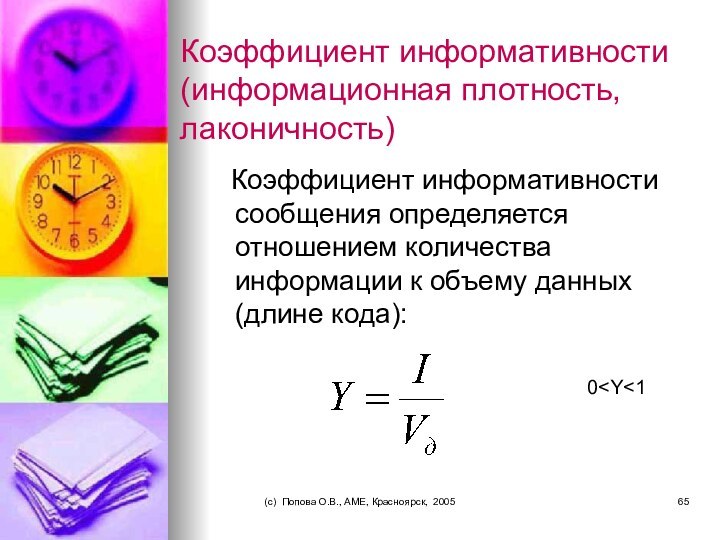

- 65. (c) Попова О.В., AME, Красноярск, 2005Коэффициент информативности

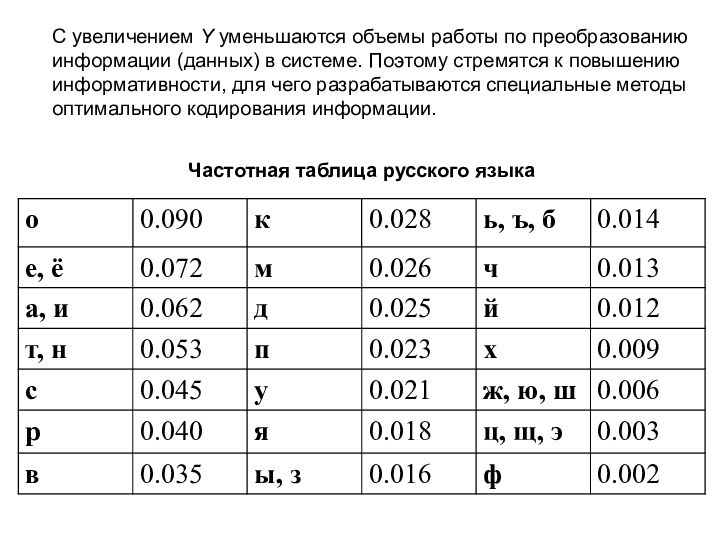

- 66. С увеличением Y уменьшаются объемы работы по

- 68. Интересные фактыЯзык обладает ≈ 20% избыточностью. Это

- 69. Интересные фактыОбщая сумма информации, собранной во всех

- 70. Семантическая мера информациисмысл и содержательность сообщений

- 71. (c) Попова О.В., AME, Красноярск, 2005Семантическая (смысловая)

- 72. (c) Попова О.В., AME, Красноярск, 2005Для измерения

- 73. «Тезаурус» – сокровищница (греч.)Человеческое знание, можно рассматривать

- 74. (c) Попова О.В., AME, Красноярск, 2005Количество семантической

- 75. (c) Попова О.В., AME, Красноярск, 2005Максимальное количество

- 76. (c) Попова О.В., AME, Красноярск, 2005Почему академики

- 77. Прагматическая мера информацииполезность информации для достижения цели

- 78. (c) Попова О.В., AME, Красноярск, 2005Цель –

- 79. (c) Попова О.В., AME, Красноярск, 2005Прагматический аспект

- 80. (c) Попова О.В., AME, Красноярск, 2005Ценность информации

- 81. (c) Попова О.В., AME, Красноярск, 2005А.А. Харкевич

- 82. Кодирование информацииИнформация может накапливаться и передаваться физическими средствами лишь с помощью кода

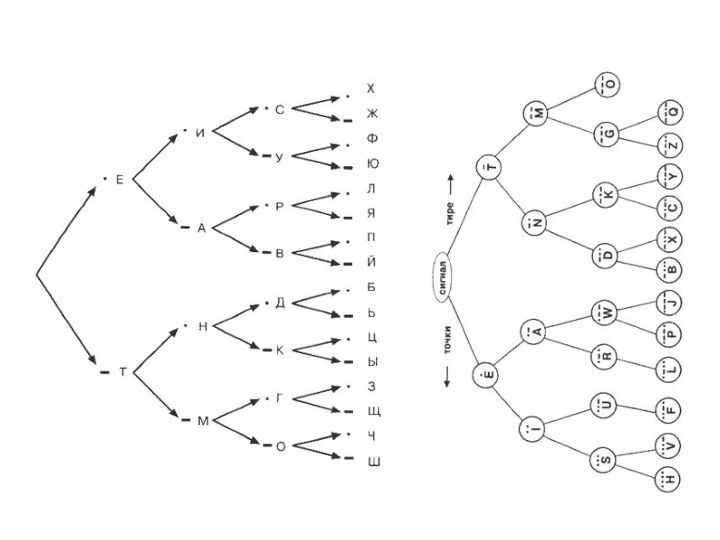

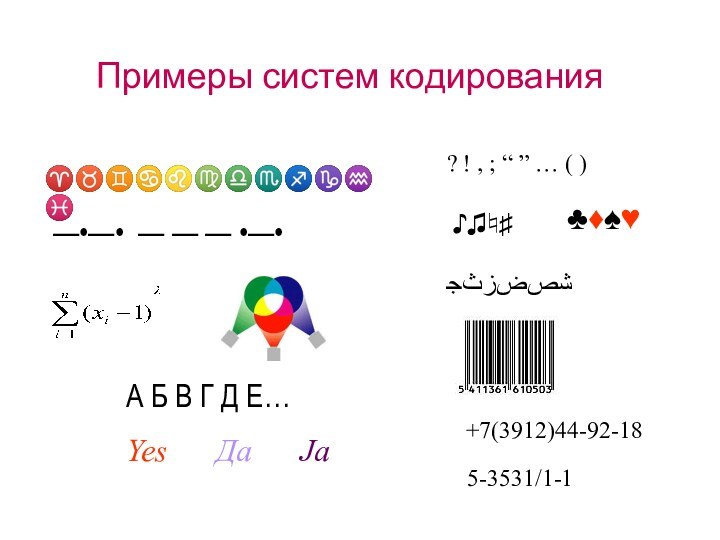

- 83. Примеры систем кодирования—•—• — — — •—•

- 84. (c) Попова О.В., AME, Красноярск, 2005Любой способ

- 85. Кодирование текстовой информацииКомпьютер - всего лишь синтаксическое приспособление, не различающее семантических категорий

- 86. Для кодирования текстовой информации используется таблица символов ASCII (American Standard Code of Information Interchange).

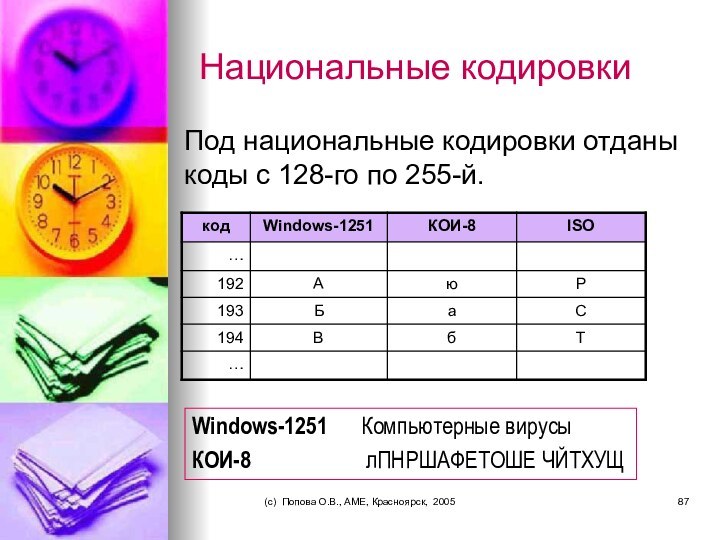

- 87. (c) Попова О.В., AME, Красноярск, 2005Национальные кодировкиПод

- 88. КОИ-8 Win-1251

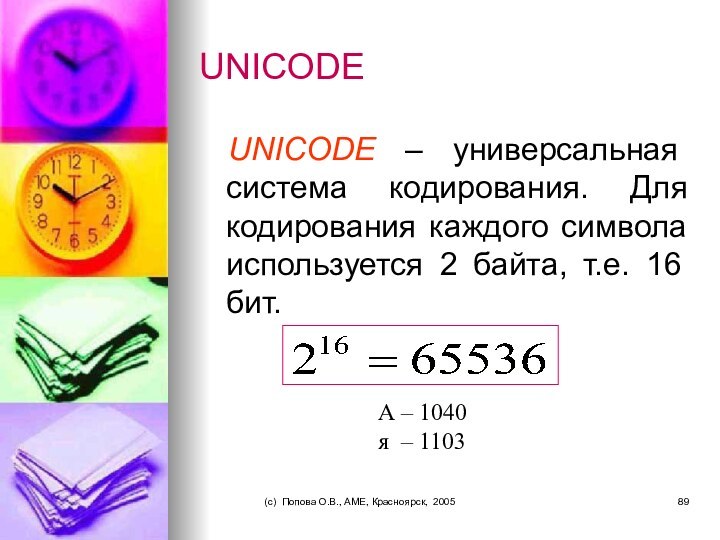

- 89. (c) Попова О.В., AME, Красноярск, 2005UNICODEUNICODE –

- 90. Кодирование графической информации

- 91. Графика: понятие цвета

- 92. Графика: восприятие цветаЛягушка видит только движущиеся предметы.

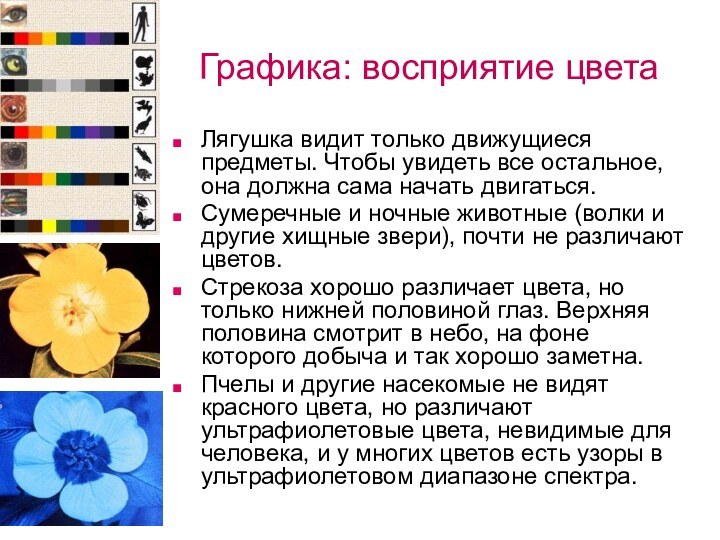

- 93. Графика: восприятие цветаВ человеческом глазе присутствуют два

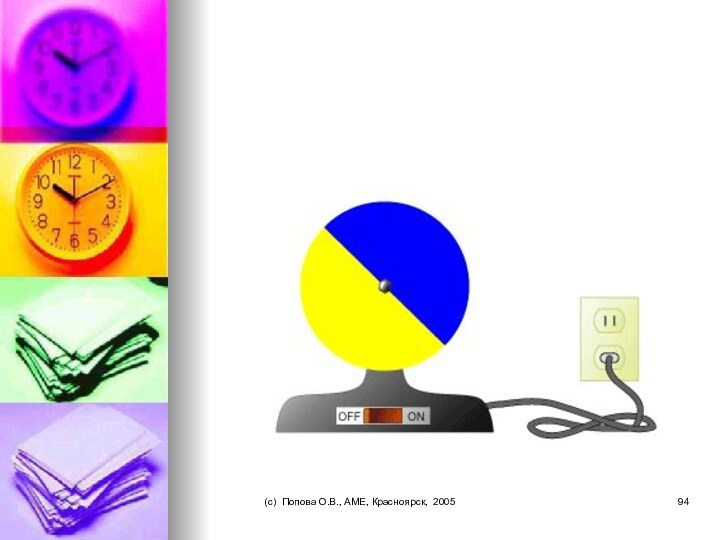

- 94. (c) Попова О.В., AME, Красноярск, 2005

- 95. Цветовые модели RGB/ CMYKизлучающиеотражающие

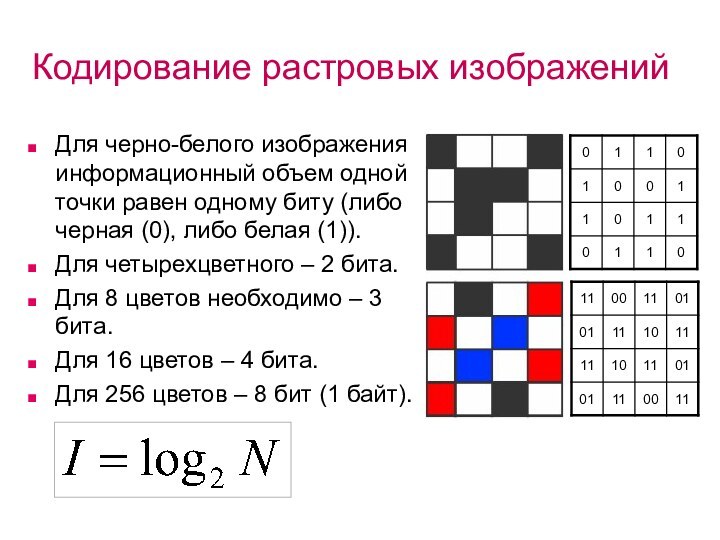

- 96. Кодирование растровых изображенийДля черно-белого изображения информационный объем

- 97. Двоичное кодирование графики

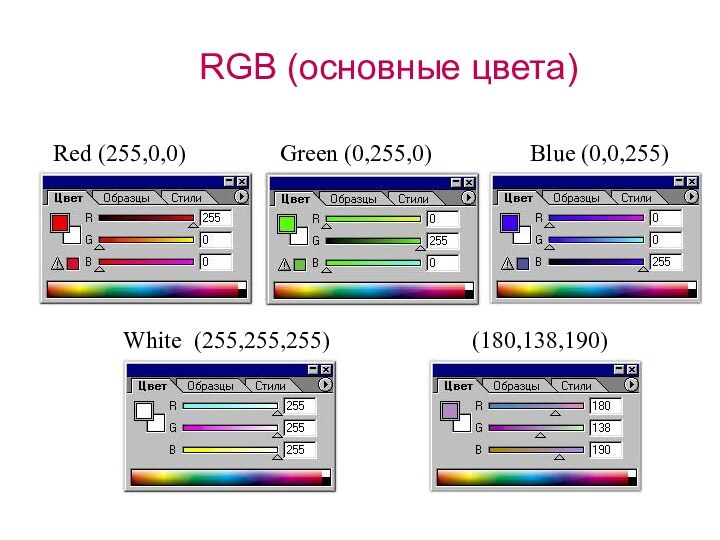

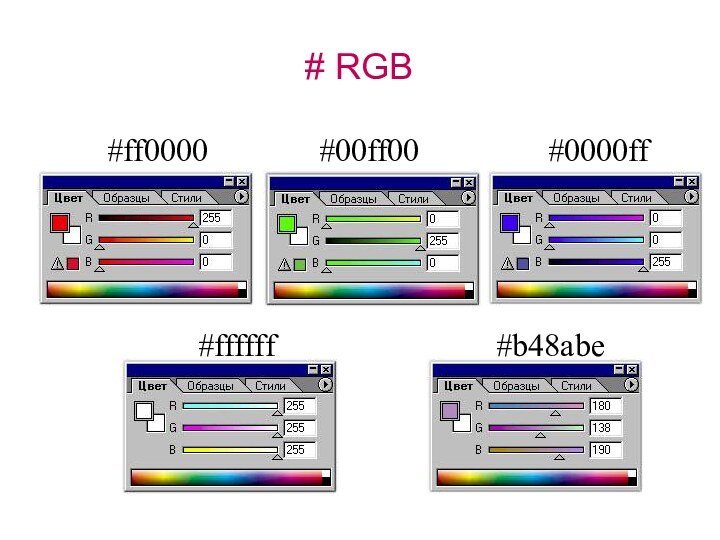

- 98. RGB (основные цвета)Red (255,0,0)Green (0,255,0)Blue (0,0,255)

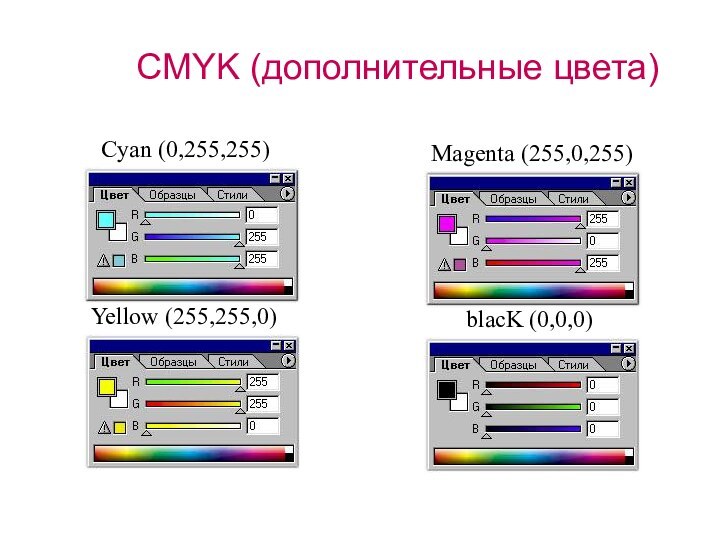

- 99. CMYK (дополнительные цвета)Cyan (0,255,255)Magenta (255,0,255)

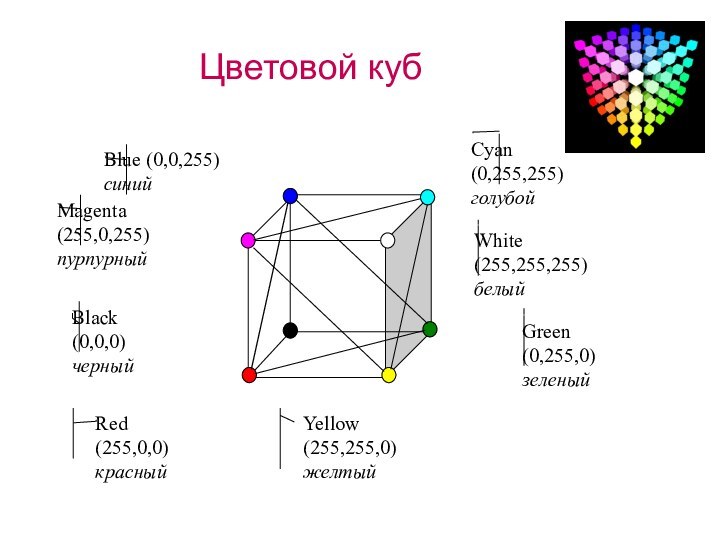

- 100. Цветовой куб

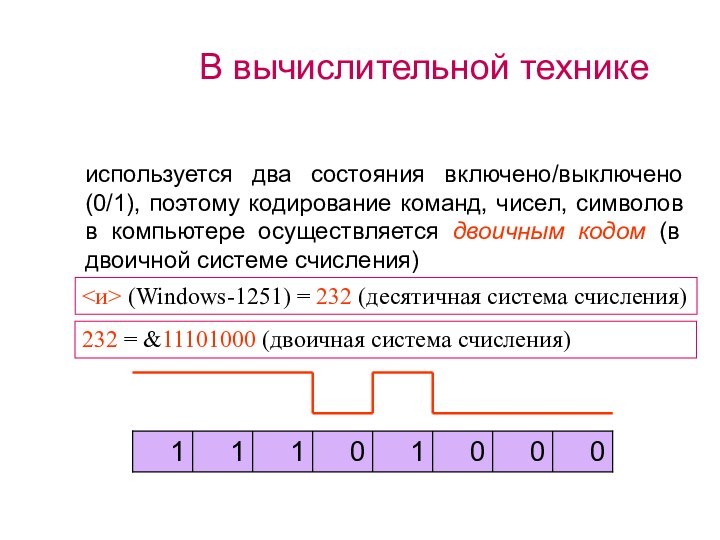

- 101. В вычислительной техникеиспользуется два состояния включено/выключено (0/1),

- 102. Системы счисления

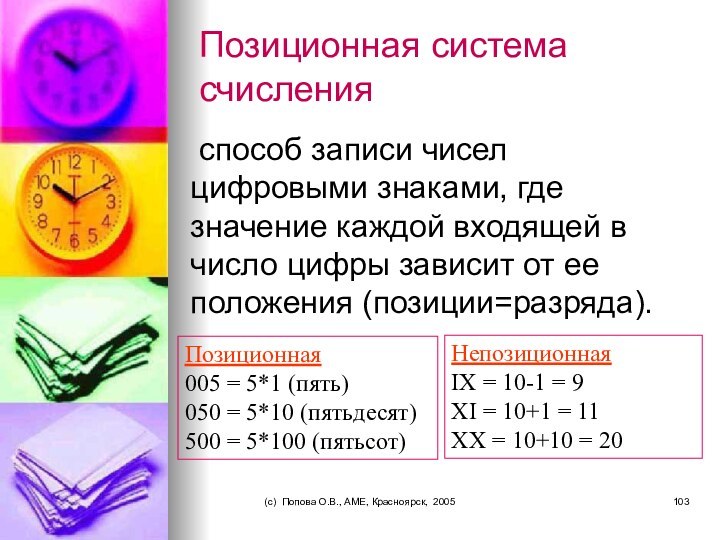

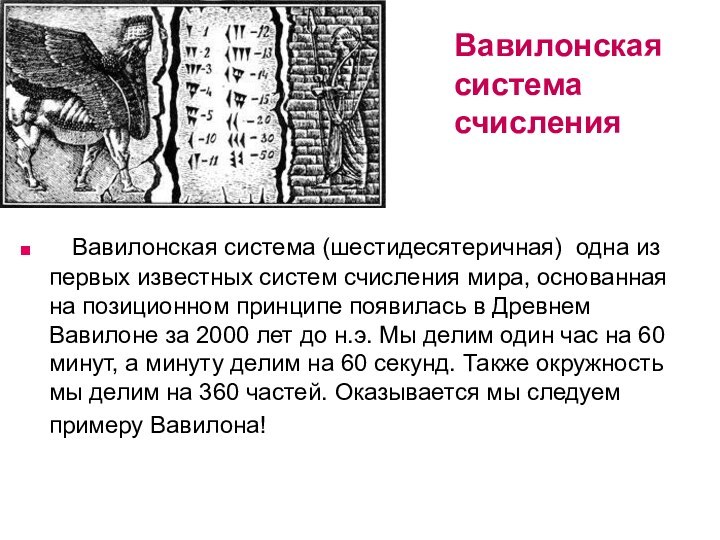

- 103. (c) Попова О.В., AME, Красноярск, 2005Позиционная система

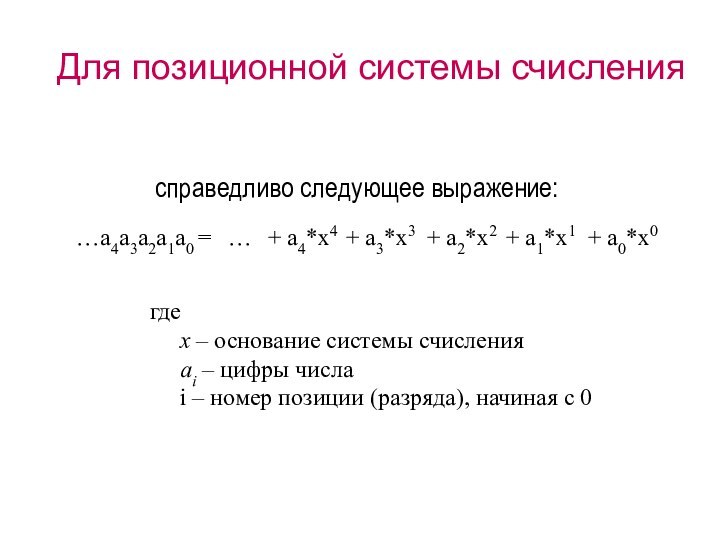

- 104. Для позиционной системы счислениягде x

- 105. Десятичная система счислениянапример, 1062 – число в десятичной системе счисления

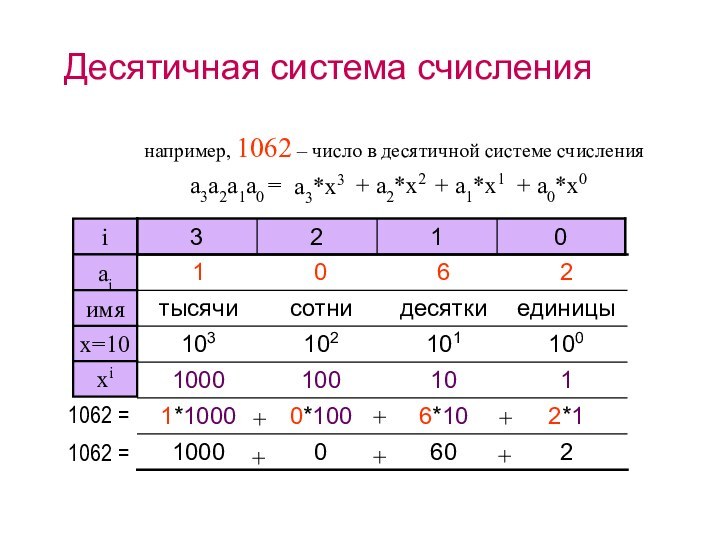

- 106. Двоичная система счислениянапример, &1010 – число в двоичной системе счисления= 10

- 107. xПеревод 2 -> 1001231011&120+0211+22+1231+4+8=13xxx

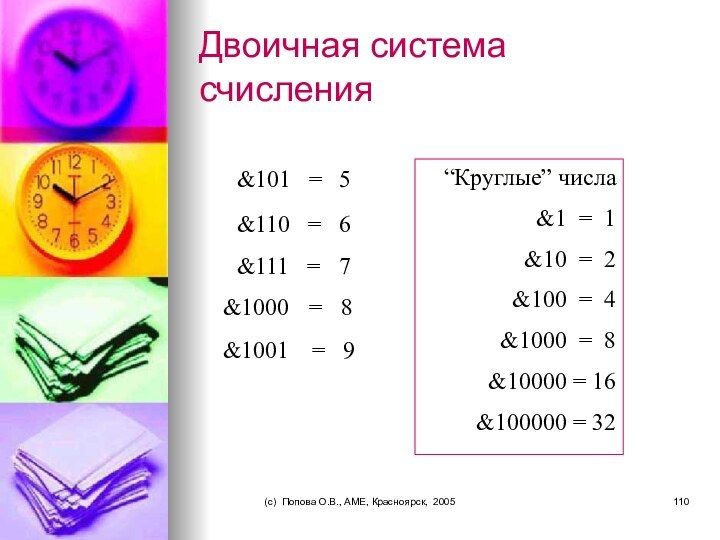

- 108. (c) Попова О.В., AME, Красноярск, 2005Двоичная система

- 109. (c) Попова О.В., AME, Красноярск, 2005«Вычисление с

- 110. (c) Попова О.В., AME, Красноярск, 2005Двоичная система

- 111. Перевод 10 –> 225 = &11001Проверка1* 24

- 112. Перевод самостоятельно (10 –> 2)18 = &10010Проверка1*

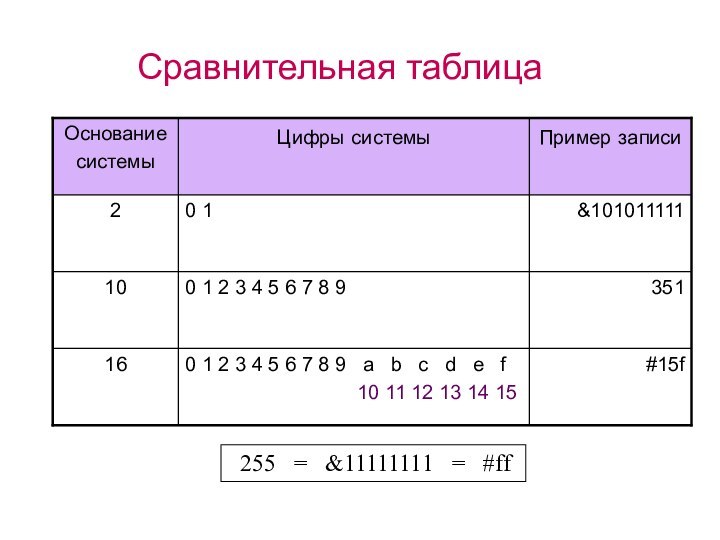

- 113. Сравнительная таблица 255 = &11111111 = #ff

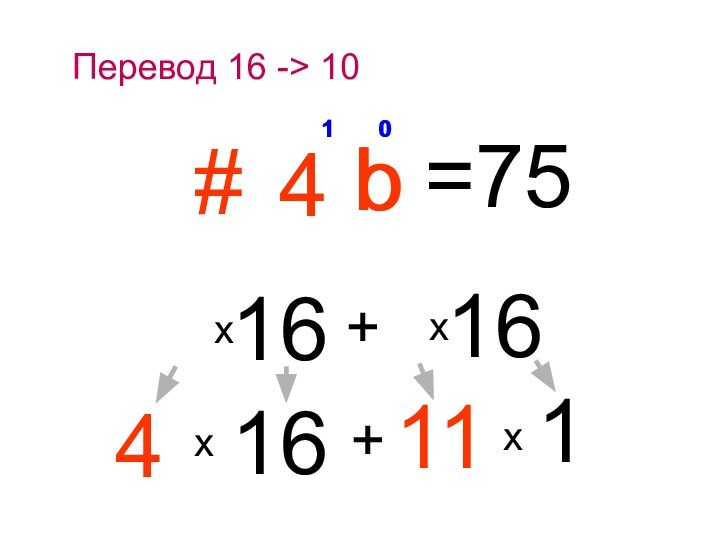

- 114. xПеревод 16 -> 1001b4#0b1614+161+164=75xx11x

- 115. (c) Попова О.В., AME, Красноярск, 2005Перевод 10

- 116. # RGB #ff0000#00ff00#0000ff

- 117. Запись чисел в различных системах счисления

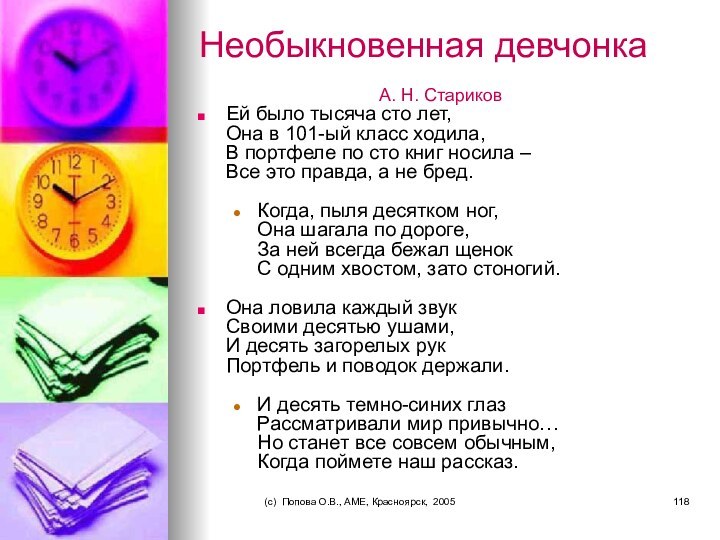

- 118. (c) Попова О.В., AME, Красноярск, 2005Необыкновенная девчонка

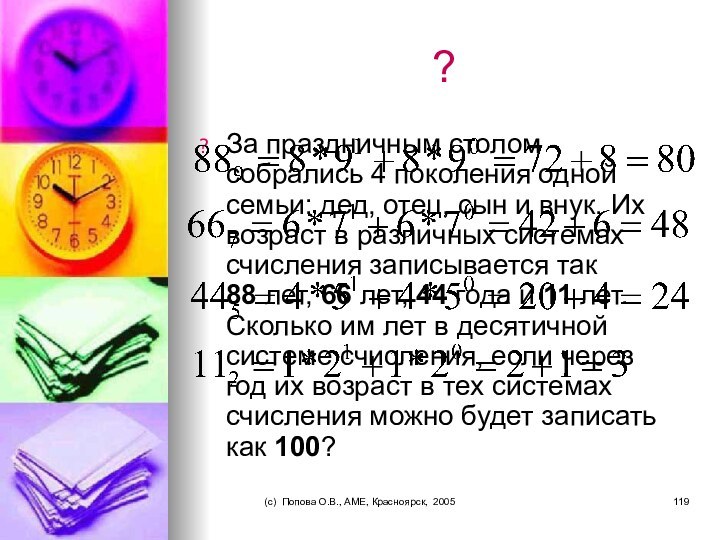

- 119. (c) Попова О.В., AME, Красноярск, 2005?За праздничным

- 120. Скачать презентацию

- 121. Похожие презентации

Слайд 2

(c) Попова О.В., AME, Красноярск, 2005

Информационное общество

Первобытное (охота

и собирательство)

Слайд 5

(c) Попова О.В., AME, Красноярск, 2005

Атрибуты общества безбумажной

информатики

Электронный документооборот

Информационная (сетевая) грамотность населения

Превращение информации в товар

Доступность населению

баз данных и знаний (в том числе сети Интернет)Информатизация основных систем общества

Слайд 7

Понятие “Информация”

есть первичное и неопределяемое понятие. Оно предполагает

наличие следующих составляющих:

Слайд 8

(c) Попова О.В., AME, Красноярск, 2005

Информация

это общенаучное понятие,

включающее:

обмен сведениями между людьми,

между человеком и автоматом,

обмен сигналами в

растительном и животном мире (передача признаков от клетки к клетке, от организма к организму).

Слайд 9

(c) Попова О.В., AME, Красноярск, 2005

Информация в технике

включает

в себя все сведения, являющиеся объектом хранения, передачи и

преобразования (данные).

Слайд 10

(c) Попова О.В., AME, Красноярск, 2005

Термин “Информация”

происходит от

латинского слова informatio – пояснение, разъяснение.

Слайд 11

(c) Попова О.В., AME, Красноярск, 2005

Информатика

наука об информации

и технических средствах ее сбора, хранения, обработки, передачи.

Слайд 12

(c) Попова О.В., AME, Красноярск, 2005

Структура современной информатики

Информатика

Теоретическая

Вычислительная

техника

Программирование

Информационные системы

Искусственный интеллект

Слайд 13

(c) Попова О.В., AME, Красноярск, 2005

С термином “информация”

связаны

термины:

Сообщение – информация представленная в определенной форме (речь, текст,

изображение, цифровые данные, график, таблица) и предназначенная для передачи.

Слайд 14

(c) Попова О.В., AME, Красноярск, 2005

С термином “информация”

связаны

термины:

Данные – сведения, представленные в определенной знаковой системе и

на определенном носителе для обеспечения возможностей их хранения, передачи, приема и обработки. Данные безотносительны к содержанию информации.

Слайд 15

(c) Попова О.В., AME, Красноярск, 2005

Данные / информация

Информация

- это данные, сопровождающиеся смысловой нагрузкой.

Пример данных: 812,

930, 944.Пример информации: 812 руб., 930 руб., 944 руб.

Более информативное сообщение: 812 руб., 930 руб., 944 руб. - цены на бальзам после бритья.

Ещё более информативное: 812 руб., 930 руб., 944 руб. - цены на бальзам после бритья "Dune", 100 мл. в Москве.

Слайд 16

(c) Попова О.В., AME, Красноярск, 2005

С термином “информация”

связаны

термины:

Знания – проверенный практикой и удостоверенный логикой результат познания

действительности, отраженный в сознании человека в виде представлений, понятий, суждений и теорий. Знания позволяют принимать решения. Для знаний характерны структурированность, связанность.

Слайд 18

(c) Попова О.В., AME, Красноярск, 2005

Способы передачи информации

Носителями

информации являются сигналы. Это физические процессы различной природы, например:

процесс

протекания электрического тока в цепи,процесс механического перемещения тела,

химические и биохимические процессы,

процесс распространения электромагнитных волн…

Слайд 19

(c) Попова О.В., AME, Красноярск, 2005

Регистрация сигналов

При

взаимодействии сигналов с физическими телами, в последних возникают определенные

изменения свойств – это явление называется регистрацией сигналов.

Слайд 21

(c) Попова О.В., AME, Красноярск, 2005

Сама информация

совершенно инвариантна по отношению к изменению способа ее передачи

(акустический, оптический, электрический) и системы запоминания (мозг, книга, электронный носитель).

Слайд 22

(c) Попова О.В., AME, Красноярск, 2005

Способы передачи информации

От

одного человека к другому информация может передаваться:

символами ( ®

$ Σ → ∞ ♪ ♋ ♣ ♂ )жестами ( ? ? )

художественными образами (стихи, живопись, балет…)

звуками

Слайд 23

(c) Попова О.В., AME, Красноярск, 2005

Способы передачи информации

В

технических устройствах (телевизор, телефон, ЭВМ…) информация может быть передана

электрическими, магнитными, световыми импульсами.Между животными информация может быть передана звуками (вой, лай, писк), запахами, ситуационным поведением.

Слайд 25

(c) Попова О.В., AME, Красноярск, 2005

По способу передачи

и восприятия

визуальная

аудиальная

тактильная (ощущения)

органолентическая (запах и вкус)

машинно-выдаваемая и воспринимаемая

средствами вычислительной техники

Слайд 26

(c) Попова О.В., AME, Красноярск, 2005

По отношению к

окружающей среде

входная

выходная

внутренняя

Слайд 27

(c) Попова О.В., AME, Красноярск, 2005

По отношению к

конечному результату

исходная

промежуточная

результирующая

Слайд 28

(c) Попова О.В., AME, Красноярск, 2005

В философском аспекте

Мировоззренческая

Эстетическая

Религиозная

Научная

Бытовая

Техническая

Экономическая

Технологическая

Слайд 29

(c) Попова О.В., AME, Красноярск, 2005

Качество информации

полнота (содержит

всё необходимое для понимания информации)

ясность (выразительность сообщений на языке

интерпретатора)адекватность, точность, корректность интерпретации, приема-передачи

интерпретируемость и понятность интерпретатору информации

достоверность

информативность и значимость

доступность

ценность

Слайд 31

(c) Попова О.В., AME, Красноярск, 2005

В природе существует

два фундаментальных вида взаимодействия: обмен веществом и энергией.

Энергетическое

и вещественное взаимодействие объектов является симметричным, т.е. сколько вещества и энергии один объект передал другому, столько тот и получил, и наоборот.

Слайд 32

(c) Попова О.В., AME, Красноярск, 2005

Информационное взаимодействие

Несимметричное взаимодействие

- при передаче субстанции между объектами один из них

ее приобретает, а другой не теряет.Любое взаимодействие между объектами, в процессе которого один приобретает некоторую субстанцию, а другой ее не теряет называется информационным взаимодействием. При этом передаваемая субстанция называется Информацией.

Слайд 33

(c) Попова О.В., AME, Красноярск, 2005

Любые взаимодействия систем

всегда материально-энергетически-информационные.

Информация не может существовать без энергии и вещества,

как и они не могут существовать без информации.Информация не может существовать вне взаимодействия объектов.

Информация не теряется ни одним из объектов в процессе этого взаимодействия.

Слайд 34

(c) Попова О.В., AME, Красноярск, 2005

Сейчас

многие учёные считают, что уместно говорить о трех ипостасях

существования материи:вещество, отражающее постоянство материи;

энергия, отражающая движение, изменение материи;

информация, отражающая структуру, строение материи.

Слайд 35

(c) Попова О.В., AME, Красноярск, 2005

Ноосфера (noos -

разум ...)

Термин "ноосфера", был введен в 1927г. французским

ученым Э. Леруа, и развит ак. В.И. Вернадским. Ноосфера - сфера разума - эволюционное состояние биосферы, при котором разумная, творческая деятельность человека, опирающаяся на научную мысль, становится решающим фактором ее развития.

Формы хранения - библиотеки, музеи, словари, учебники, Интернет.

Слайд 37

(c) Попова О.В., AME, Красноярск, 2005

Синтаксическая — обезличенная

информация, не выражающая смыслового отношения к объекту.

Семантическая — информация

воспринимаемая пользователем и включаемая им в дальнейшем в свой тезаурус. Прагматическая — информация полезная (ценная) для достижения пользователем поставленной цели.

Слайд 39

Синтаксическая мера информации

оперирует с обезличенной информацией (данными), не

выражающей смыслового отношения к объекту

Слайд 40

(c) Попова О.В., AME, Красноярск, 2005

Объем данных Vд

Объем данных в сообщении измеряется количеством символов (разрядов)

в этом сообщении (длина информационного кода). конкурс выиграл B Vд =17 символов

B стал победителем Vд =18 символов

A проиграл Vд = 10 символов

Слайд 41

(c) Попова О.В., AME, Красноярск, 2005

Количество информации I

Количество

информации о системе, полученное в сообщении, измеряется уменьшением неопределенности

о состоянии системы.Меру неопределенности в теории информации называют “энтропия”.

Неопределенность не отделима от понятия вероятности.

Слайд 42

Одинаково ли количество информации в ответах на вопросы:

В

каком из 4-х возможных состояний (твердое, жидкое, газообразное, плазма)

находится некоторое вещество?На каком из 4-х курсов учится студент техникума?

Как упадет монета при подбрасывании: “орлом” или “решкой”?

Если считать эти состояния равновероятными, то P(i)=1/4. Тогда ответ и на вопросы 1 и 2 снимает равную неопределенность => содержит равное кол-во информации

P(i)=1/2.

Вероятность каждого состояния больше, а снимаемая ответом неопределенность меньше => содержит меньшее кол-во информации

Слайд 43

(c) Попова О.В., AME, Красноярск, 2005

Чем меньше вероятность

события, тем больше информации несет сообщение о его появлении.

Если

вероятность события равна 1 (достоверное событие), количество информации в сообщении о его появлении равно 0.

Слайд 44

«Конкурс выиграет один из участников: A или B»

-

это априорная информация о системе, утверждающая, что система может

находиться в одном из 2х состояний.После получения любого сообщения из:

конкурс выиграл B Vд =17 символов

B стал победителем Vд =18 символов

A проиграл Vд = 10 символов

неопределенность снизилась до 1 варианта из 2-х изначально возможных.

Чему равно количество информации, которое несет это сообщение?

Для синтаксической оценки количества информации не важно в каком именно состоянии находится система, важно только возможное количество состояний системы и их априорные вероятности.

Слайд 45

(c) Попова О.В., AME, Красноярск, 2005

Формула Шеннона

где

I

– количество информации (бит);

N – число возможных состояний системы;

p(i)

– априорная вероятность каждого состояния системы.

Слайд 47

(c) Попова О.В., AME, Красноярск, 2005

Расчет количества информации

по Хартли

Частный случай формулы Шеннона для равновероятных событий

где

I –

количество информации, битN – число возможных состояний системы

Слайд 48

(c) Попова О.В., AME, Красноярск, 2005

Бит

Количество информации, которое

можно получить при ответе на вопрос типа “да/нет” (включено/выключено,

true/false, 0/1), если эти состояния равновероятны, называется “бит” (англ. bit – binary digit – двоичное число).

Слайд 49

(c) Попова О.В., AME, Красноярск, 2005

Бит

Лампочка горит? (да/нет)

– 1 бит информации (при равных вероятностях).

Слайд 50

(c) Попова О.В., AME, Красноярск, 2005

Рассмотрим систему из

2-х электрических лампочек

А B

В системе из 2-х лампочек 2 бита информации.I=2

N=4

Лампочка А горит? (да/нет)

Лампочка B горит? (да/нет)

Слайд 54

(c) Попова О.В., AME, Красноярск, 2005

?

Определите количество информации

в сообщении: “Сейчас горит красный сигнал светофора”, если считать,

что светофор всегда работает и вероятности появления красного, зеленого и желтого сигналов равны.Ответ получится больше или меньше, чем 1 бит?

Слайд 55

(c) Попова О.В., AME, Красноярск, 2005

Байт

Группа из 8

бит называется байтом

(byte – binary term – двоичный элемент)

Байт

– основная единица измерения информации, занесенная в систему СИ

Слайд 56

Байт

На основании 1 байта, исходя из формулы Хартли,

можно получить 256 различных комбинаций.

Слайд 57

(c) Попова О.В., AME, Красноярск, 2005

1 символ =

1 байт

Количество байтов для представления текста (в принятых на

сегодняшний день кодировках) равно числу знаков естественного языка этого текста.

Слайд 58

Kb, Mb, Gb, Tb

1 Kb (кило) =

210 b =

1.024 b1 Mb (мега) = 210 Kb = 220 b = 1.048.576 b

1 Gb (гига) = 210 Mb = 230 b = 1.073.741.824 b

1 Tb (тера) = 210 Gb = 240 b = 1.099.511.627.776 b

Слайд 59

Размер текстового файла (Vд) 640 Kb. Файл содержит

книгу, которая набрана в среднем по 32 строки на

странице и по 64 символа в строке. Сколько страниц в книге: 160, 320, 540, 640, 1280 ?Задача

1. Символов на 1 стр. = 32*64 = 25*26=211

3. Всего = 640Kb = 10*64*210b = 10*26*210b = 10*216b

4. Кол-во стр. = 10*216b / 211b = 10*25 = 320

1 символ = 1b

2. Памяти на 1 стр. = 211b

Слайд 60

(c) Попова О.В., AME, Красноярск, 2005

Информация и энтропия

Формула

Шеннона выглядит также, как используемая в физике формула энтропии,

выведенная Больцманом, но со знаком “-”.Энтропия обозначает степень неупорядоченности движения молекул. По мере увеличения упорядоченности энтропия стремится к нулю.

Слайд 61

(c) Попова О.В., AME, Красноярск, 2005

Информация есть отрицательная

энтропия

Т.к. энтропия является мерой неупорядоченности, то информация может быть

определена как мера упорядоченности материальных систем.

Слайд 62

(c) Попова О.В., AME, Красноярск, 2005

?

Увеличится или уменьшится

количество информации в системе «Сосуд с водой» после замораживания

воды?Как изменится энтропия этой системы?

Слайд 63

(c) Попова О.В., AME, Красноярск, 2005

Информация есть снятая

неразличимость

Р. Эшби осуществил переход от толкования информации как «снятой неопределенности»

к «снятой неразличимости». Он считал, что информация есть там, где имеется разнообразие, неоднородность.

Слайд 64

(c) Попова О.В., AME, Красноярск, 2005

Информация, энтропия и

возможность выбора

Любая информация, уменьшающая неопределенность (энтропию), уменьшает и возможность

выбора (количество вариантов).

Слайд 65

(c) Попова О.В., AME, Красноярск, 2005

Коэффициент информативности (информационная

плотность, лаконичность)

Коэффициент информативности сообщения определяется отношением количества

информации к объему данных (длине кода):0

Слайд 66 С увеличением Y уменьшаются объемы работы по преобразованию

информации (данных) в системе. Поэтому стремятся к повышению информативности,

для чего разрабатываются специальные методы оптимального кодирования информации.Частотная таблица русского языка

Слайд 68

Интересные факты

Язык обладает ≈ 20% избыточностью. Это означает,

что любое сообщение можно без потери информации сократить на

1/5, но при этом резко уменьшается помехоустойчивость информации.Информативность стихов в 1,5 раза больше, чем прозы, т.е. сообщение в 150 строк может быть передано 100 стихотворными строчками.

Информативность стихов Пушкина очень близка к пределу информационной способности русского языка вообще.

Слайд 69

Интересные факты

Общая сумма информации, собранной во всех библиотеках

мира, оценивается как

Самая высокая известная нам плотность информации в

молекулах ДНКЕсли бы вся эта информация была записана в молекуле ДНК, для нее хватило бы одного процента объема булавочной головки. Как носитель информации, молекула ДНК эффективней современных кварцевых мегачипов в 45 миллионов миллионов раз.

Слайд 71

(c) Попова О.В., AME, Красноярск, 2005

Семантическая (смысловая) теория

информации связана с семиотикой – теорией знаковых систем.

Знаковые системы

– это естественные и искусственные языки. Они служат средством обмена информацией между высокоорганизованными системами, способными к обучению и самоорганизации (живые организмы, машины с определенными свойствами).

Слайд 72

(c) Попова О.В., AME, Красноярск, 2005

Для измерения количества

смыслового содержания информации, наибольшее признание получила тезаурусная мера, которая

связана со способностью пользователя принимать поступившее сообщение.Тезаурус - это совокупность сведений, которыми располагает пользователь или система.

Слайд 73

«Тезаурус» – сокровищница (греч.)

Человеческое знание, можно рассматривать в

виде совокупности смысловыражающих элементов и смысловых отношений между ними

= тезаурус.Количество семантической информации, извлекаемое человеком из сообщения, можно определить степенью изменения его знаний. Чем больше изменений, тем больше информации получено.

Человек получает информацию только в том случае, когда в его знаниях, т.е. в его тезаурусе после получения сообщения произошли какие-либо изменения.

Слайд 74

(c) Попова О.В., AME, Красноярск, 2005

Количество семантической информации

= 0, если:

«ИЗВЕСТНО ВСЕ» - Вам сообщают что-либо уже

известное, например, что дважды два – четыре, что после ночи наступает день…«НЕИЗВЕСТНО НИЧЕГО» - Вам сообщают что-либо на неизвестном вам языке, Вы видите совершенно незнакомую математическую формулу…

Т.е. информация была передана, приемник информацию получил, но его знания (тезаурус) остались без изменений.

Слайд 75

(c) Попова О.В., AME, Красноярск, 2005

Максимальное количество семантической

информации потребитель приобретает при согласовании её смыслового содержания со

своим тезаурусом, когда поступающая информация понятна пользователю и несет ему ранее не известные (отсутствующие в его тезаурусе) сведения.Т.о., эффективность передачи информации зависит от соотношения тезаурусов источника и приемника.

Слайд 76

(c) Попова О.В., AME, Красноярск, 2005

Почему академики не

учат первоклассников

- Мы были в лесу.

- Что такое

«лес»?Лес

- «Лес» – это, когда много деревьев.

- «Лес – это совокупность значительного количества деревьев, произрастающих в непосредственной близости друг от друга»

Слайд 78

(c) Попова О.В., AME, Красноярск, 2005

Цель – опережающее

отражение, модель будущего результата деятельности.

Цель является высшим уровнем передачи

информации. Информация передается для того, чтобы вызвать соответствующий отклик у ее получателя.

Слайд 79

(c) Попова О.В., AME, Красноярск, 2005

Прагматический аспект информации

В

языке предложения связываются друг с другом так, чтобы сформулировать

просьбу, недовольство, вопрос, указание, чтобы вызвать определенное действие у получателя сообщения.С помощью рекламного объявления производитель старается убедить покупателя приобрести его продукцию.

Слайд 80

(c) Попова О.В., AME, Красноярск, 2005

Ценность информации по

Стратоновичу

Ценность информации определяется уменьшением материальных или временных затрат, благодаря

использованию информации.Если, благодаря использованию информации, произошло увеличение затрат, то ценность такой информации отрицательная.

Слайд 81

(c) Попова О.В., AME, Красноярск, 2005

А.А. Харкевич предложил

связать меру ценности информации с изменением вероятности достижения цели

при получении этой информации таким образом:I = log(p1/p0) = log(p1) – log(p0),

где p0 - вероятность достижения цели до, а p1 – после получения информации.

Слайд 82

Кодирование информации

Информация может накапливаться и передаваться физическими средствами

лишь с помощью кода

Слайд 83

Примеры систем кодирования

—•—• — — — •—•

А

Б В Г Д Е…

Yes Да

Ja? ! , ; “ ” … ( )

+7(3912)44-92-18

♪♫♮♯

ﺷﺹﺾﺰﺚﺠ

5-3531/1-1

♈♉♊♋♌♍♎♏♐♑♒♓

♣♦♠♥

Слайд 84

(c) Попова О.В., AME, Красноярск, 2005

Любой способ кодирования

характеризуется

наличием основы (алфавит, спектр цветности, система координат, основание системы

счисления…) и правил конструирования информационных образов на этой основе.

Слайд 85

Кодирование текстовой информации

Компьютер - всего лишь синтаксическое приспособление,

не различающее семантических категорий

Слайд 86

Для кодирования текстовой информации

используется таблица символов

ASCII

(American Standard Code of Information Interchange).

Слайд 87

(c) Попова О.В., AME, Красноярск, 2005

Национальные кодировки

Под национальные

кодировки отданы коды с 128-го по 255-й.

Windows-1251

Компьютерные вирусыКОИ-8 лПНРШАФЕТОШЕ ЧЙТХУЩ

Слайд 89

(c) Попова О.В., AME, Красноярск, 2005

UNICODE

UNICODE – универсальная

система кодирования. Для кодирования каждого символа используется 2 байта,

т.е. 16 бит.

Слайд 92

Графика: восприятие цвета

Лягушка видит только движущиеся предметы. Чтобы

увидеть все остальное, она должна сама начать двигаться.

Сумеречные и

ночные животные (волки и другие хищные звери), почти не различают цветов.Стрекоза хорошо различает цвета, но только нижней половиной глаз. Верхняя половина смотрит в небо, на фоне которого добыча и так хорошо заметна.

Пчелы и другие насекомые не видят красного цвета, но различают ультрафиолетовые цвета, невидимые для человека, и у многих цветов есть узоры в ультрафиолетовом диапазоне спектра.

Слайд 93

Графика: восприятие цвета

В человеческом глазе присутствуют два вида

рецепторов: палочки и колбочки.

Палочки реагируют на оттенки серого,

а колбочки воспринимают спектр цветов. Существует три типа колбочек: первые реагируют на красно-оранжевый цвет, вторые - на зеленый, а третьи - на сине-фиолетовый.

Слайд 96

Кодирование растровых изображений

Для черно-белого изображения информационный объем одной

точки равен одному биту (либо черная (0), либо белая

(1)).Для четырехцветного – 2 бита.

Для 8 цветов необходимо – 3 бита.

Для 16 цветов – 4 бита.

Для 256 цветов – 8 бит (1 байт).

Слайд 101

В вычислительной технике

используется два состояния включено/выключено (0/1), поэтому

кодирование команд, чисел, символов в компьютере осуществляется двоичным кодом

(в двоичной системе счисления)<и> (Windows-1251) = 232 (десятичная система счисления)

232 = &11101000 (двоичная система счисления)

Слайд 103

(c) Попова О.В., AME, Красноярск, 2005

Позиционная система счисления

способ записи чисел цифровыми знаками, где значение каждой

входящей в число цифры зависит от ее положения (позиции=разряда).Позиционная

005 = 5*1 (пять)

050 = 5*10 (пятьдесят)

500 = 5*100 (пятьсот)

Непозиционная

IX = 10-1 = 9

XI = 10+1 = 11

XX = 10+10 = 20

Слайд 104

Для позиционной системы счисления

где

x –

основание системы счисления

ai – цифры числа

i – номер позиции (разряда), начиная с 0справедливо следующее выражение:

+ a0*x0

+ a1*x1

+ a3*x3

+ a2*x2

+ a4*x4

…

…a4a3a2a1a0 =

Слайд 108

(c) Попова О.В., AME, Красноярск, 2005

Двоичная система счисления

способ

записи чисел с помощью цифр1 и 0, которые являются

коэффициентами при степени числа 2. Например, &101.& - амперсант указывает на то, что число записано в двоичной системе.

Слайд 109

(c) Попова О.В., AME, Красноярск, 2005

«Вычисление с помощью

двоек…, сведение чисел к простейшим началам (0 и 1)»

было предложено еще в XVII веке знаменитым немецким ученым Г.В. Лейбницем.

Слайд 110

(c) Попова О.В., AME, Красноярск, 2005

Двоичная система счисления

&101

=

5

&110 =

&111 =

6

7

= 8&1000

= 9

&1001

“Круглые” числа

&1 = 1

&10 = 2

&100 = 4

&1000 = 8

&10000 = 16

&100000 = 32

Слайд 111

Перевод 10 –> 2

25 = &11001

Проверка

1* 24 +

1*23+ 0*22 + 0*21 + 1*20 =

1*16 + 1*8

+ 0*4 + 0*2 + 1*1 =16 + 8 + 0 + 0 + 1 = 25

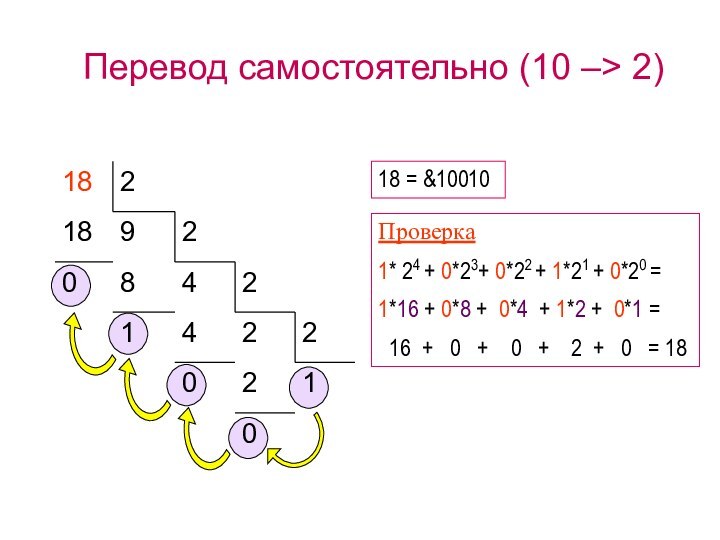

Слайд 112

Перевод самостоятельно (10 –> 2)

18 = &10010

Проверка

1* 24

+ 0*23+ 0*22 + 1*21 + 0*20 =

1*16 +

0*8 + 0*4 + 1*2 + 0*1 =16 + 0 + 0 + 2 + 0 = 18

Слайд 115

(c) Попова О.В., AME, Красноярск, 2005

Перевод 10 –>

16

4

11

176

16

180

180 = #b4

Проверка

11* 161 + 4*160 =

11*16 +

4*1 =176 + 4 = 180

= b

Слайд 118

(c) Попова О.В., AME, Красноярск, 2005

Необыкновенная девчонка

А. Н.

Стариков

Ей было тысяча сто лет,

Она в 101-ый класс

ходила,

В портфеле по сто книг носила –

Все это правда, а не бред.Когда, пыля десятком ног, Она шагала по дороге, За ней всегда бежал щенок С одним хвостом, зато стоногий.

Она ловила каждый звук Своими десятью ушами, И десять загорелых рук Портфель и поводок держали.

И десять темно-синих глаз Рассматривали мир привычно… Но станет все совсем обычным, Когда поймете наш рассказ.