Слайд 2

Перераховані види повідомлень є вихідними для будь-якої існуючої

системи передачі або системи електрозв’язку. Однак ці види повідомлень

не пристосовані для передавання системами електрозв’язку, тому вони перетворюються у особливий вид повідомлення – електричний сигнал.

Дискретне джерело інформації – це таке джерело, яке може виробити ( згенерувати ) за скінчений відрізок часу тільки скінчену множину повідомлень. Кожному такому повідомленню можна співставити відповідне число, та передавати ці числа замість повідомлень.

Дискретне джерело інформації є достатньо адекватною інформаційною моделлю дискретних систем, а також неперервних систем, інформаційні сигнали про стан яких піддають аналого - цифровому перетворенню; таке перетворення виконується в більшості сучасних автоматизованих систем управління.

Слайд 3

Первинні характеристики дискретного джерела інформації – це алфавіт,

сукупність ймовірностей появи символів алфавіту на виході дискретного джерела

та тривалості символів.

Алфавіт – множина символів, які можуть з’явитися на виході дискретного джерела; М – алфавіт джерела, тобто кількість різноманітних символів алфавіту.

Якщо всі ймовірності, які визначають виникнення символів на виході джерела, не залежать від часу, джерело називають стаціонарним. Ми будемо розглядати тільки стаціонарні джерела та для скорочення замість “стаціонарне джерело” будемо всюди використовувати “джерело”.

Для опису джерел, які не мають пам’яті, достатньо мати значення безумовних імовірностей p(xi) виникнення символів xi , i = 1, 2, 3,…, M на його виході.

Слайд 4

Більшість реальних джерел інформації є джерелами з пам’яттю.

Розподіл ймовірностей виникнення чергового символу на виході дискретного джерела

з пам’яттю залежить від того, які символи були попередніми. Таке джерело інформації називають марковським, оскільки процес появи символів на його виході адекватний ланцюгам Маркова; останні в свою чергу отримали таку назву на честь російського математика Маркова Андрія Андрійовича (1856 – 1922), який заклав основи розділу теорії випадкових процесів.

Будемо говорити, що глибина пам’яті марковського дискретного джерела інформації дорівнює h, ( h ≥ 0 ), якщо ймовірність появи чергового символу залежить тільки від h попередніх символів на виході цього джерела.

Слайд 5

Сигнал – це фізичний процес або явище, що

переносить інформацію о будь-якій події або о стані об’єкта

спостереження. Якщо фізичним процесом є електричний струм, електрична напруга або напруженість поля електромагнітної хвилі, то сигнал називається електричним. Отже електричні сигнали є переносниками інформації (повідомлень) у радіотехнічних системах.

Слайд 6

2.2. Кількісна міра інформації

Кількість інформації – одне із

основних понять теорії інформації, яка розглядає технічні аспекти інформаційних

проблем, тобто вона дає відповіді на запитання такого типу: якою повинна бути ємність запам’ятовуючого пристрою для запису даних про стан деякої системи, якими повинні бути характеристики каналу зв’язку для передачі певного повідомлення тощо.

Слайд 7

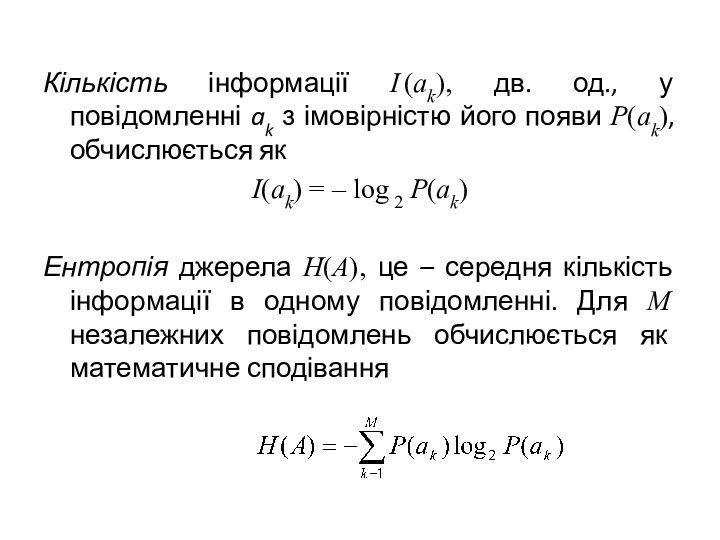

Кількість інформації I (ak), дв. од., у повідомленні ak

з імовірністю його появи P(ak), обчислюється як

I(ak) = –

log 2 P(ak)

Ентропія джерела H(A), це – середня кількість інформації в одному повідомленні. Для М незалежних повідомлень обчислюється як математичне сподівання

Слайд 8

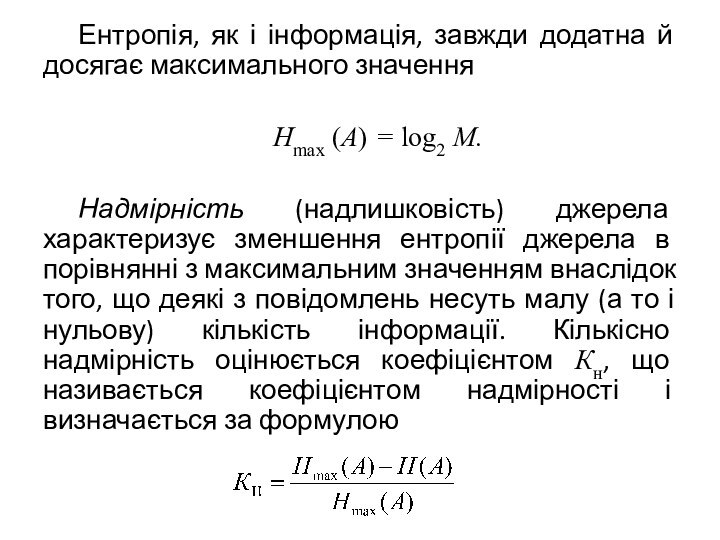

Ентропія, як і інформація, завжди додатна й досягає

максимального значення

Hmax (А) = log2 M.

Надмірність (надлишковість) джерела характеризує

зменшення ентропії джерела в порівнянні з максимальним значенням внаслідок того, що деякі з повідомлень несуть малу (а то і нульову) кількість інформації. Кількісно надмірність оцінюється коефіцієнтом Кн, що називається коефіцієнтом надмірності і визначається за формулою

Слайд 9

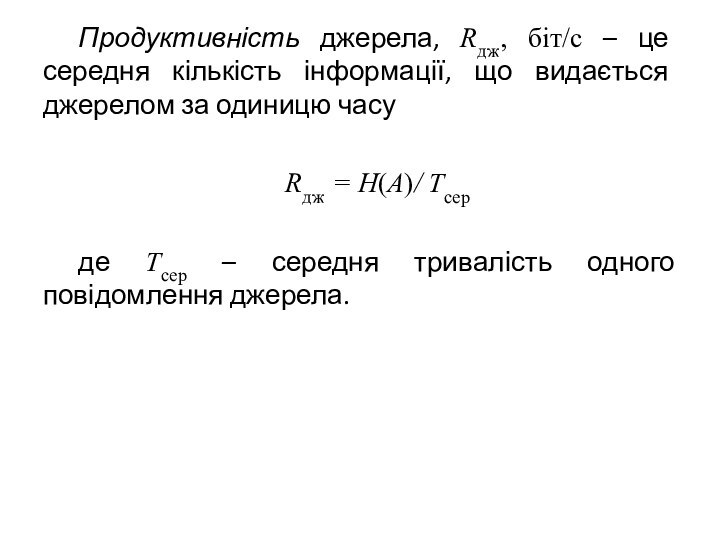

Продуктивність джерела, Rдж, біт/с – це середня кількість

інформації, що видається джерелом за одиницю часу

Rдж = Н(А)/

Тсер

де Тсер – середня тривалість одного повідомлення джерела.

Слайд 10

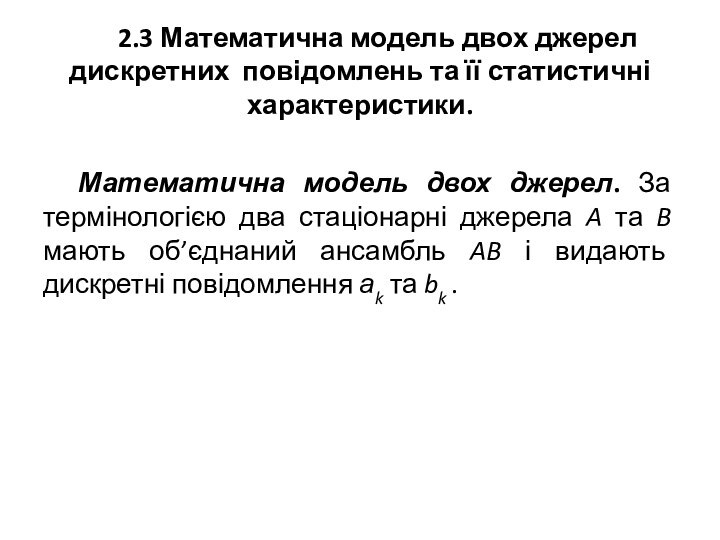

2.3 Математична модель двох джерел дискретних повідомлень та

її статистичні характеристики.

Математична модель двох джерел. За термінологією два

стаціонарні джерела A та B мають об’єднаний ансамбль AB і видають дискретні повідомлення аk та bk .

Слайд 11

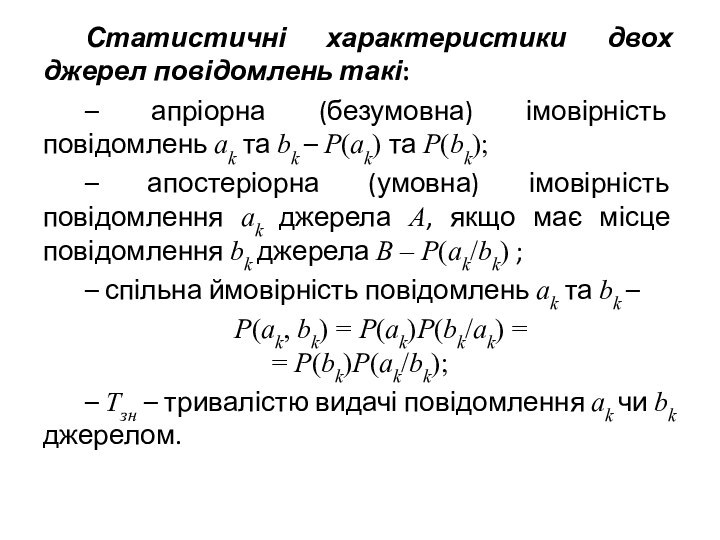

Статистичні характеристики двох джерел повідомлень такі:

– апріорна

(безумовна) імовірність повідомлень аk та bk – P(аk) та

P(bk);

– апостеріорна (умовна) імовірність повідомлення аk джерела A, якщо має місце повідомлення bk джерела B – P(аk/bk) ;

– спільна ймовірність повідомлень аk та bk –

P(аk, bk) = P(аk)P(bk/ak) =

= P(bk)P(ak/bk);

– Tзн – тривалістю видачі повідомлення аk чи bk джерелом.

Слайд 12

Типовим прикладом двох джерел повідомлень є повідомлення від

якогось джерела A на вході каналу зв’язку та ті

ж самі повідомлення на виході каналу. Ми спостерігаємо повідомлення на виході каналу (джерело B), а інформацію маємо отримати про джерело A.

Кількість інформації в повідомленні аk чи bk об’єднаного ансамблю AB двох джерел повідомлень A i B характеризується умовною та спільною інформацією.

Умовна кількість інформації в повідомленні аk чи bk об’єднаного ансамблю AB двох джерел дискретних повідомлень A i B і(аk/bk), визначається:

і(аk/bk) = – log 2 P(аk/bk)

і(bk/ak) = – log 2 P(bk/ak) [дв.од.]

Слайд 13

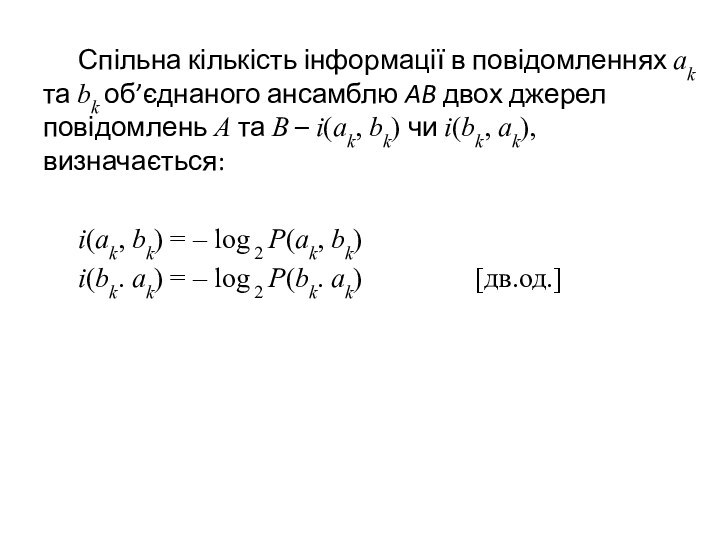

Спільна кількість інформації в повідомленнях аk та bk

об’єднаного ансамблю AB двох джерел повідомлень A та B – і(аk,

bk) чи і(bk, ak), визначається:

і(аk, bk) = – log 2 P(аk, bk)

і(bk. ak) = – log 2 P(bk. ak) [дв.од.]

Слайд 14

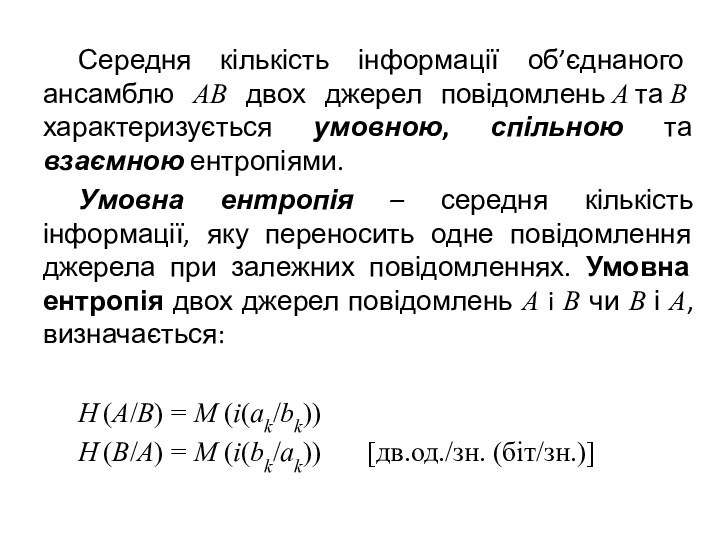

Середня кількість інформації об’єднаного ансамблю AB двох джерел

повідомлень A та B характеризується умовною, спільною та взаємною ентропіями.

Умовна ентропія

– середня кількість інформації, яку переносить одне повідомлення джерела при залежних повідомленнях. Умовна ентропія двох джерел повідомлень A i B чи B і A, визначається:

Н (A/B) = M (і(аk/bk))

Н (B/A) = M (і(bk/ak)) [дв.од./зн. (біт/зн.)]

Слайд 15

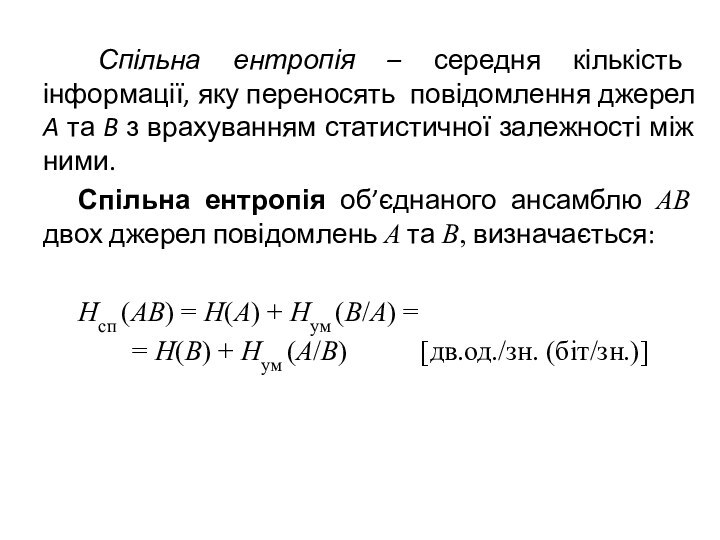

Спільна ентропія – середня кількість інформації, яку

переносять повідомлення джерел A та B з врахуванням статистичної

залежності між ними.

Спільна ентропія об’єднаного ансамблю AB двох джерел повідомлень A та B, визначається:

Нсп (AB) = Н(A) + Нум (B/A) =

= Н(B) + Нум (A/B) [дв.од./зн. (біт/зн.)]

Слайд 16

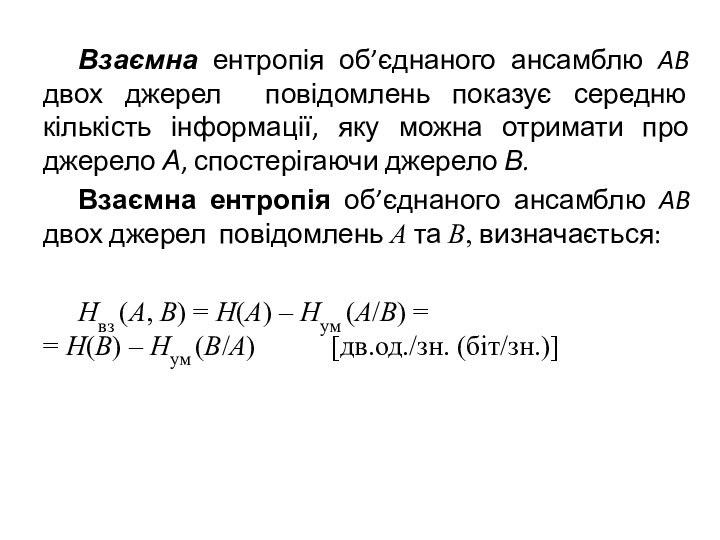

Взаємна ентропія об’єднаного ансамблю AB двох джерел повідомлень

показує середню кількість інформації, яку можна отримати про джерело

А, спостерігаючи джерело В.

Взаємна ентропія об’єднаного ансамблю AB двох джерел повідомлень A та B, визначається:

Нвз (A, B) = Н(A) – Нум (A/B) =

= Н(B) – Нум (B/A) [дв.од./зн. (біт/зн.)]

Слайд 17

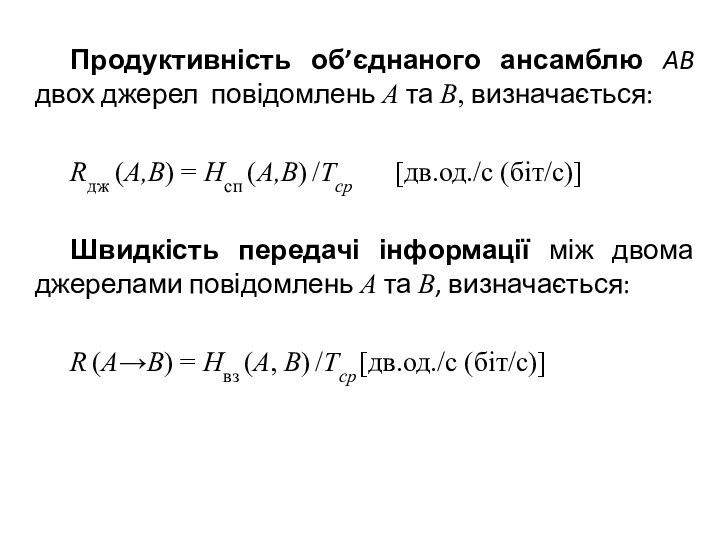

Продуктивність об’єднаного ансамблю AB двох джерел повідомлень A та B,

визначається:

Rдж (A,B) = Нсп (A,B) /Тср [дв.од./с (біт/с)]

Швидкість передачі інформації між

двома джерелами повідомлень A та B, визначається:

R (A→B) = Нвз (A, B) /Тср [дв.од./с (біт/с)]

Слайд 18

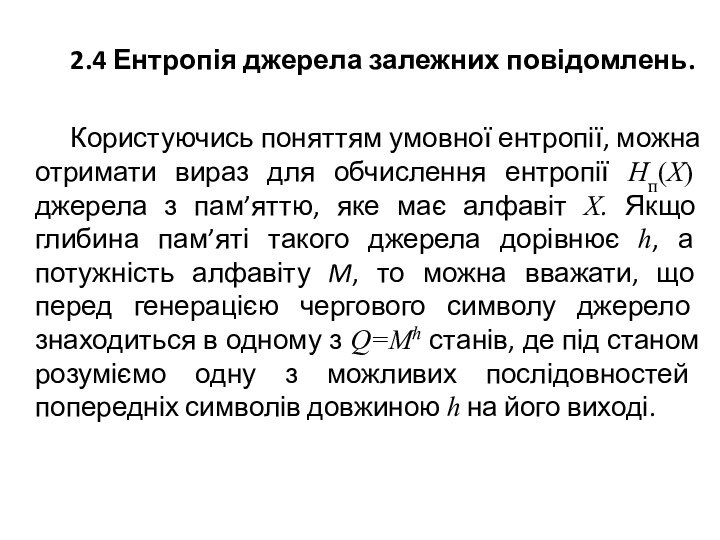

2.4 Ентропія джерела залежних повідомлень.

Користуючись поняттям умовної

ентропії, можна отримати вираз для обчислення ентропії Нп(X) джерела

з пам’яттю, яке має алфавіт X. Якщо глибина пам’яті такого джерела дорівнює h, а потужність алфавіту M, то можна вважати, що перед генерацією чергового символу джерело знаходиться в одному з Q=Mh станів, де під станом розуміємо одну з можливих послідовностей попередніх символів довжиною h на його виході.

Слайд 19

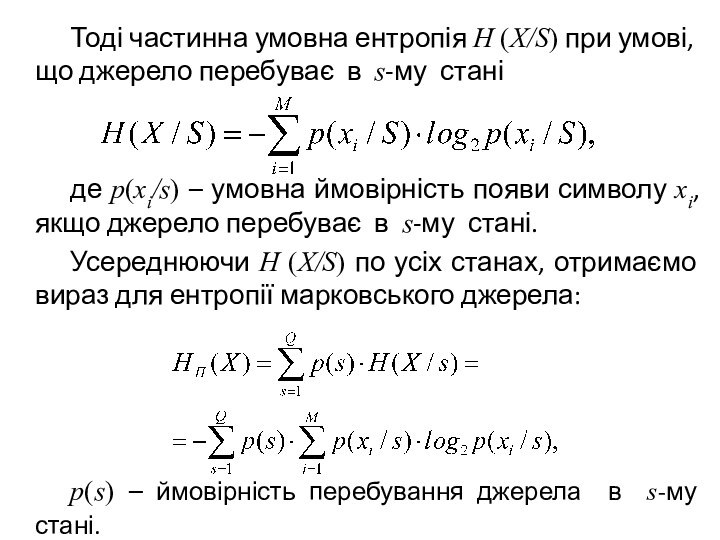

Тоді частинна умовна ентропія H (X/S) при умові,

що джерело перебуває в s-му стані

де p(xi/s) – умовна

ймовірність появи символу xi, якщо джерело перебуває в s-му стані.

Усереднюючи H (X/S) по усіх станах, отримаємо вираз для ентропії марковського джерела:

p(s) – ймовірність перебування джерела в s-му стані.

Слайд 20

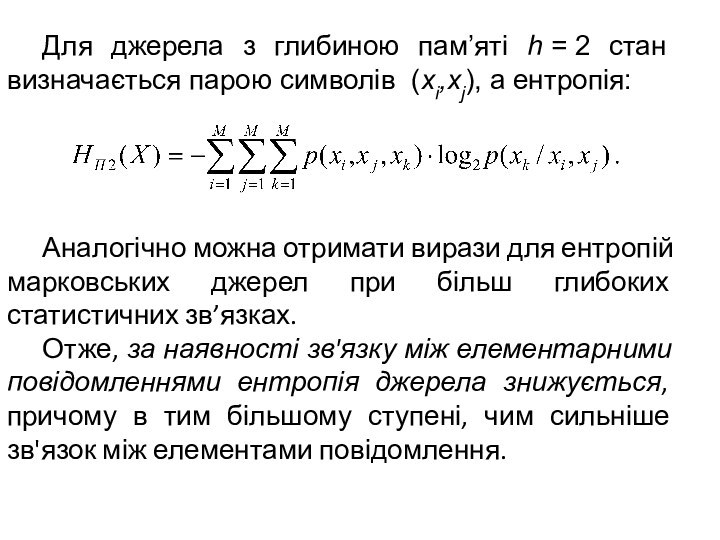

Для джерела з глибиною пам’яті h = 2 стан визначається

парою символів (xi,xj), а ентропія:

Аналогічно можна отримати вирази для

ентропій марковських джерел при більш глибоких статистичних зв’язках.

Отже, за наявності зв'язку між елементарними повідомленнями ентропія джерела знижується, причому в тим більшому ступені, чим сильніше зв'язок між елементами повідомлення.

Слайд 21

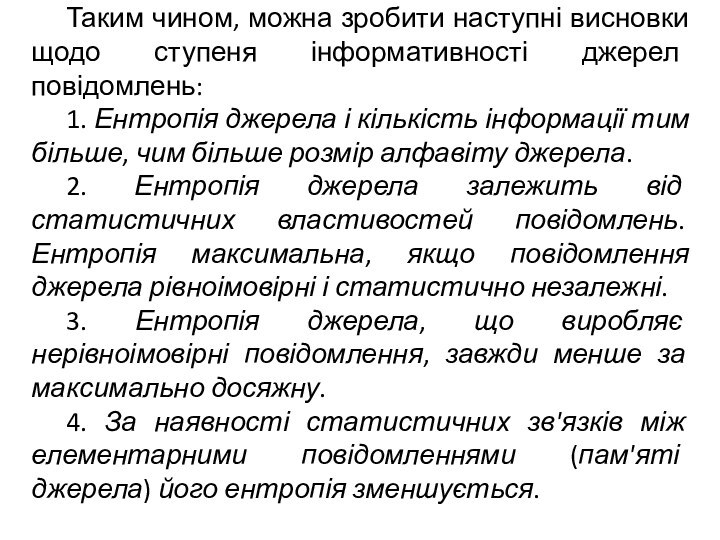

Таким чином, можна зробити наступні висновки щодо ступеня

інформативності джерел повідомлень:

1. Ентропія джерела і кількість інформації тим

більше, чим більше розмір алфавіту джерела.

2. Ентропія джерела залежить від статистичних властивостей повідомлень. Ентропія максимальна, якщо повідомлення джерела рівноімовірні і статистично незалежні.

3. Ентропія джерела, що виробляє нерівноімовірні повідомлення, завжди менше за максимально досяжну.

4. За наявності статистичних зв'язків між елементарними повідомленнями (пам'яті джерела) його ентропія зменшується.

Слайд 22

Як приклад розглянемо джерело з алфавітом, що складається

з літер А={а, б, в,....., ю, я}. Вважатимемо для

простоти, що розмір алфавіту джерела = 25 = 32.

Якби всі літери алфавіту мали однакову імовірність і були статистично незалежні, то середня ентропія, що доводиться на один символ, склала б

H max(А) = log2 32 = 5 біт/літеру.

Якщо тепер врахувати лише різну імовірність літер в тексті (а неважко перевірити, що так воно і є), розрахункова ентропія складе

H(А) = 4,39 біт/літеру.

Слайд 23

З урахуванням кореляції (статистичного зв'язку) між двома і

трьома сусідніми літерами (після літери “П” частіше зустрічається “A”

і майже ніколи – “Ю” і “Ц”) ентропія зменшиться, відповідно, до

H(А) = 3,52 біт/літеру і H (А) = 3,05 біт/літеру.

Якщо врахувати кореляцію між вісьма і більш символами, ентропія зменшиться до

H(А) = 2,0 біт/літеру

і далі залишається без змін.

Слайд 24

Реальні джерела з одним і тим же розміром

алфавіту можуть мати абсолютно різну ентропію.

Наприклад надмірність літературного російського

тексту складе

К= 1 - ( 2 біт/літеру )/( 5 біт/літеру ) = 0,6 .

Іншими словами, при передаванні тексту по каналу зв'язку кожні шість букв з десяти переданих не несуть ніякої інформації і можуть без жодних втрат просто не передаватися.