Слайд 2

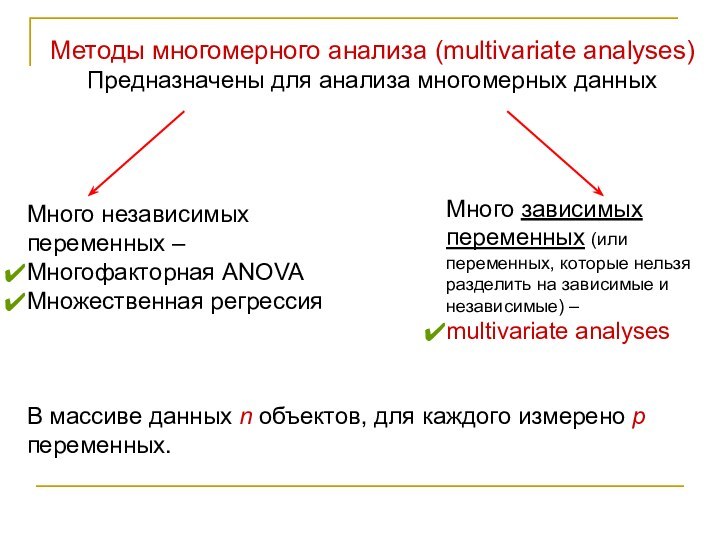

Методы многомерного анализа (multivariate analyses)

Предназначены для анализа многомерных

данных

Много независимых переменных –

Многофакторная ANOVA

Множественная регрессия

Много зависимых переменных (или

переменных, которые нельзя разделить на зависимые и независимые) –

multivariate analyses

В массиве данных n объектов, для каждого измерено p переменных.

Слайд 3

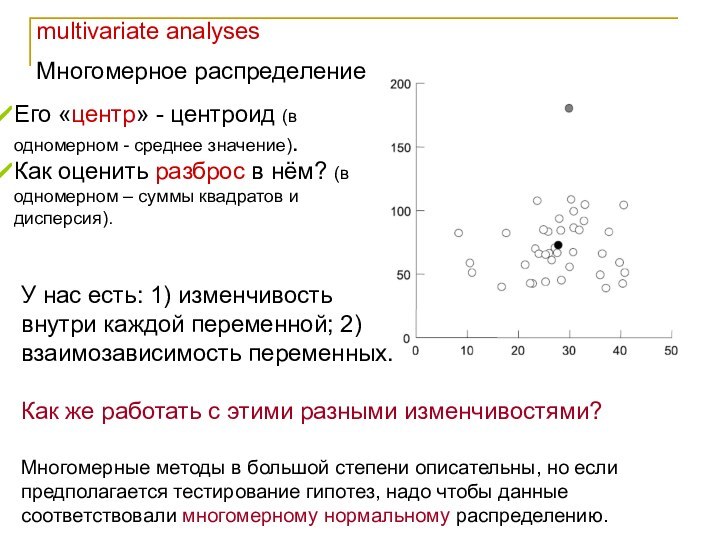

multivariate analyses

Многомерное распределение

Многомерные методы в большой степени описательны,

но если предполагается тестирование гипотез, надо чтобы данные соответствовали

многомерному нормальному распределению.

Его «центр» - центроид (в одномерном - среднее значение).

Как оценить разброс в нём? (в одномерном – суммы квадратов и дисперсия).

У нас есть: 1) изменчивость внутри каждой переменной; 2) взаимозависимость переменных.

Как же работать с этими разными изменчивостями?

Слайд 4

multivariate analyses

Используют особые таблицы - матрицы.

Одна матрица у

нас уже есть – матрица исходных данных (Y).

Clevenger &

Waltho изучали, сколько раз и как (на велосипеде-верхои-пешком) люди переходят дорогу в заповеднике на разных 11 переходах.

Слайд 5

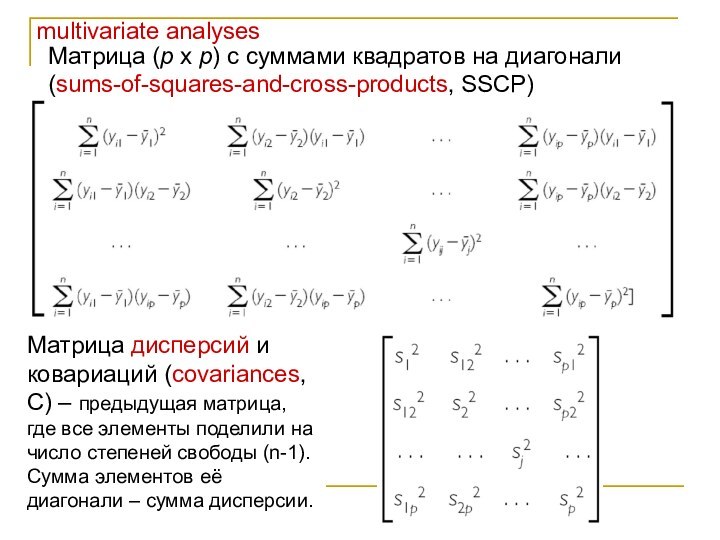

multivariate analyses

Матрица (p x p) с суммами квадратов

на диагонали (sums-of-squares-and-cross-products, SSCP)

Матрица дисперсий и ковариаций (covariances, C)

– предыдущая матрица, где все элементы поделили на число степеней свободы (n-1).

Сумма элементов её диагонали – сумма дисперсии.

Слайд 6

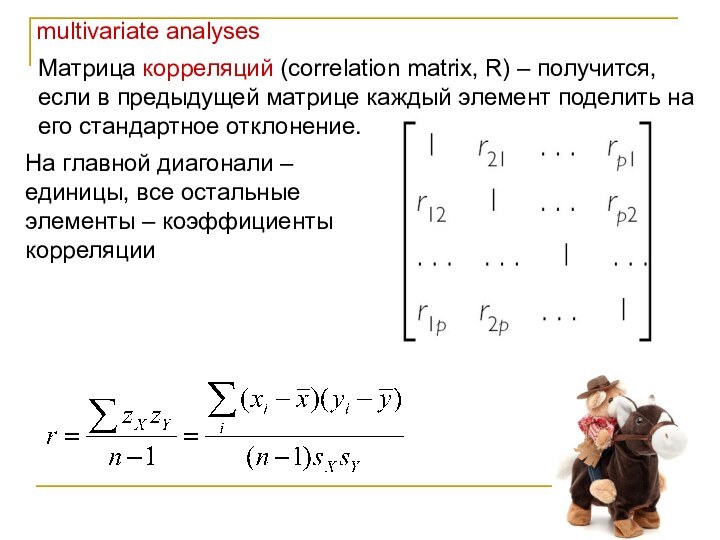

multivariate analyses

Матрица корреляций (correlation matrix, R) – получится,

если в предыдущей матрице каждый элемент поделить на его

стандартное отклонение.

На главной диагонали – единицы, все остальные элементы – коэффициенты корреляции

Слайд 7

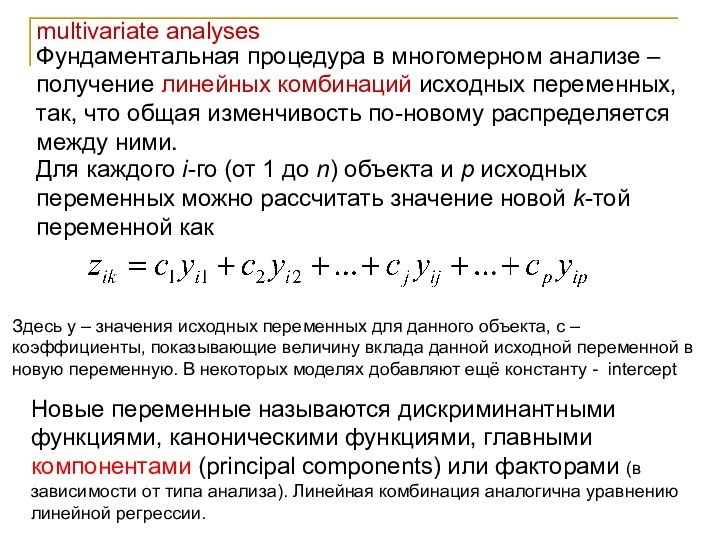

multivariate analyses

Фундаментальная процедура в многомерном анализе – получение

линейных комбинаций исходных переменных, так, что общая изменчивость по-новому

распределяется между ними.

Для каждого i-го (от 1 до n) объекта и p исходных переменных можно рассчитать значение новой k-той переменной как

Здесь y – значения исходных переменных для данного объекта, с – коэффициенты, показывающие величину вклада данной исходной переменной в новую переменную. В некоторых моделях добавляют ещё константу - intercept

Новые переменные называются дискриминантными функциями, каноническими функциями, главными компонентами (principal components) или факторами (в зависимости от типа анализа). Линейная комбинация аналогична уравнению линейной регрессии.

Слайд 8

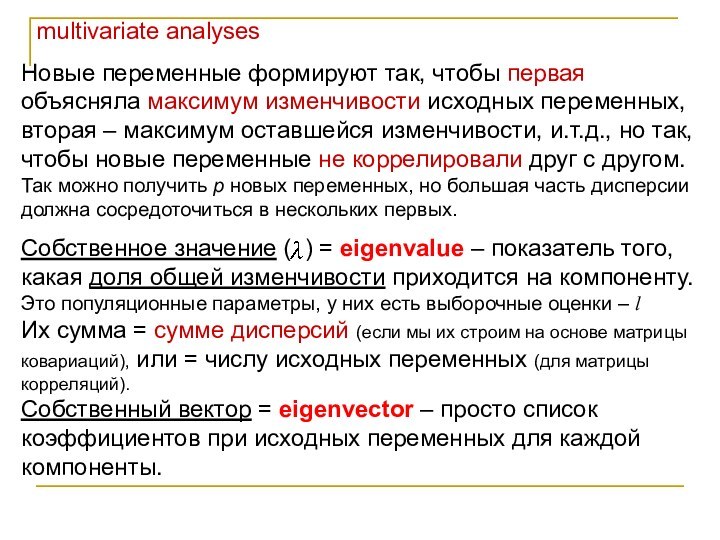

multivariate analyses

Новые переменные формируют так, чтобы первая объясняла

максимум изменчивости исходных переменных, вторая – максимум оставшейся изменчивости,

и.т.д., но так, чтобы новые переменные не коррелировали друг с другом. Так можно получить р новых переменных, но большая часть дисперсии должна сосредоточиться в нескольких первых.

Собственное значение ( ) = eigenvalue – показатель того, какая доля общей изменчивости приходится на компоненту. Это популяционные параметры, у них есть выборочные оценки – l

Их сумма = сумме дисперсий (если мы их строим на основе матрицы ковариаций), или = числу исходных переменных (для матрицы корреляций).

Собственный вектор = eigenvector – просто список коэффициентов при исходных переменных для каждой компоненты.

Слайд 9

multivariate analyses

Выделим новые компоненты для переходов:

В примере используется

матрица ковариаций

Значения собственных значений для новых переменных

Коэффициенты для новых

переменных (столбец = eigenvector)

Слайд 10

multivariate analyses

Теперь можно для каждого конкретного перехода посчитать

значения новых переменных = компонент. И, например, использовать в

дальнейшем анализе.

Мы рассмотрели способ получения компонент (и их значений для объектов) из матриц ковариаций или корреляций (p x p). – R-mode analysis.

Есть другой способ: построить матрицу «корреляций» = «дистанций» между объектами (n x n) в исходных переменных, и из линейных комбинаций объектов рассчитать значения новых компонент, и затем найти eigenvectors - Q-mode analysis.

Разные пути используются в разных типах многомерного анализа, но вообще-то они алгебраически связаны.

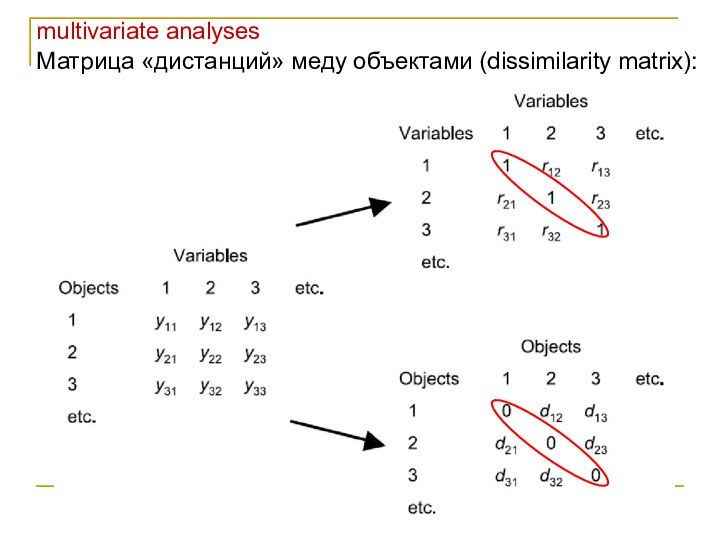

Слайд 11

multivariate analyses

Матрица «дистанций» меду объектами (dissimilarity matrix):

Слайд 12

multivariate analyses

Есть много показателей «дистанции» между объектами (самый

очевидный – евклидовы расстояния).

Дистанции можно посчитать между объектами с

любыми переменными, в т.ч. Качественными и даже бинарными!

Слайд 13

multivariate analyses

Подготовка данных для многомерного анализа

Трансформация данных: нормализует

распределения и делает отношения между переменными линейными (важно для

выделения компонент). Логарифмическая, квадратного корня и пр.

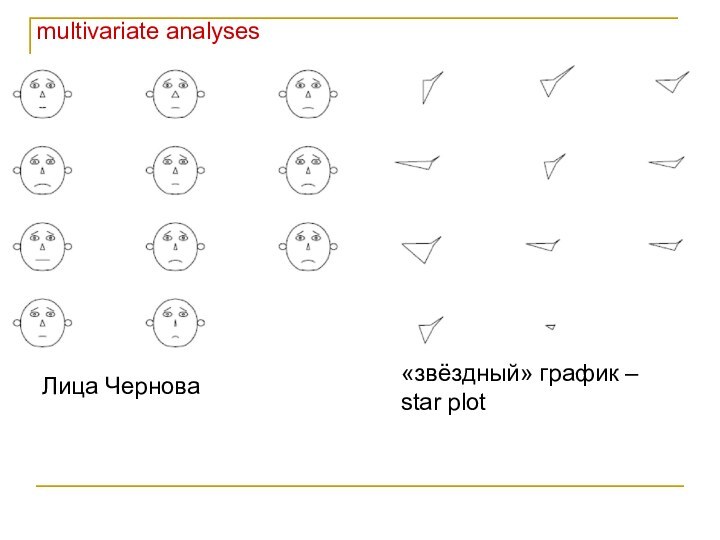

можно предварительно построить картинки и оценить сходство – различие между объектами (лица Чернова, «звёздный» график).

важно избавить от аутлаеров! Многомерные аутлаеры: их можно найти с помощью дистанций Махаланобиса (квадрат расстояния от объекта до центроида).

если переменные измерены в разных шкалах, принципиально использовать матрицу корреляций (не ковариаций) для получения компонент. Если нет – лучше пробовать оба варианта.

пропущенные измерения – не casewise, а pairwise deletion.

Слайд 14

multivariate analyses

Лица Чернова

«звёздный» график – star plot

Слайд 15

ФАКТОРНЫЙ АНАЛИЗ

У нас в руках измерения большого числа

переменных для

выборки объектов.

Наши цели:

Уменьшить число исходных переменных с

минимальными потерями исходной информации (что, например, уменьшит эффект множественных сравнений);

Обнаружить скрытые закономерности в данных, которые не выявляются при анализе отдельных переменных, путём помещения в пространство новых переменных (scaling). Например, выявление реальных действующих факторов (причинно-следственных связей), или просто выявление структуры взаимосвязи переменных.

Слайд 16

Анализ главных компонент

(principal component analysis, PCA)

Factor analysis

У нас

есть n объектов и p переменных. Мы собираемся трансформировать

переменные в k (от 1 до p) новых главных компонент = факторов.

Для каждого объекта мы получим значения этих компонент – z-значения.

В анализе – 6 этапов.

Слайд 17

Factor analysis

Этап 0. Подготовка данных к анализу.

Проверка распределений

на соответствие нормальному;

Трансформация данных (напр., логарифмирование некоторых переменных);

Исключение аутлаеров.

Этап

1. Получение eigenvalues для новых компонент

В программе их получают из матрицы корреляций, их сумма = числу переменных. Разумно использовать компоненты, для которых eigenvalues > 1. т.е., число компонент будет меньше числа исходных переменных. Напоминание: они независимы между сбой, т.е., ортогональны.

Этап 2. получение коэффициентов для каждой компоненты.

(Factor Score Coefficients). Они показывают вклад каждой переменной в компоненты. Необязательный этап.

Слайд 18

Factor analysis

Этап 3. получение factor loadings

Это показатели корреляции

(Пирсона) компонент с каждой из исходных переменных. Если какие-то

переменные почти одинаково коррелируют с несколькими компонентами, можно улучшить структуру компонент:

Этап 4. вращение выбранных компонент для получения более чётких связей с исходными переменными. (чтобы loadings приблизились к 0, 1 или -1). Varimax rotation – самый распространённый и удобный метод.

Этап 5. получение factor loadings после вращения

Рассмотрение корреляций новых, повёрнутых компонент с исходными переменными, понимание их биологического смысла.

Этап 6. получение значений новых переменных для каждого объекта (для дальнейшего анализа.)

Слайд 19

Factor analysis

Несколько слов о компонентах (факторах):

В многомерном пространстве

первая компонента располагается вдоль наибольшей дисперсии, т.е., это почти

аналог линии линейной регрессии.

Компоненты взаимно перпендикулярны

Компоненты – линейные комбинации исходных переменных

Если исходные переменные не коррелируют между собой, не получится собрать много дисперсии в первых компонентах, т.е., уменьшить их число.

Сколько компонент оставлять? Это решает исследователь так, чтобы обеспечить биологическую интерпретируемость результатов. Нет смысла оставлять компоненты, с которыми не коррелирует сильно ни одна исходная переменная. Правило «eigenvalue =1».

Слайд 20

Вращение компонент (факторов)

Factor analysis

Выбранные нами факторы (их мало)

поворачивают для получения более чёткой структуры переменных. Обычно используют

ортогональное вращение – факторы остаются перпендикулярными друг другу. Например, varimax.

Не ортогональное вращение – oblique rotation, у него есть свои поклонники, но этот метод не прост.

Анализ остатков – residuals – имеет смысл посмотреть, насколько много информации мы потеряли при сокращении числа переменных. На основе наших факторов генерируются корреляции между исходными переменными и сравниваются с реальными корреляциями. Если разница где-то велика, мы взяли слишком мало факторов.

Слайд 21

Мы изучаем пищевые предпочтения павианов и разработали комплексные

оценки привлекательности разных типов пищи для каждой особи. Павианы

едят разную еду, поэтому типов пищи – 10. особей в анализе – 100.

Но реальных факторов, определяющих эти предпочтения, наверняка меньше.

Мы хотим узнать, сколько (и каких) факторов определяют пищевые предпочтения павианов.

Factor analysis

Слайд 22

Итак,

Мы хотим

Найти те факторы, которые определяют изменчивость (объясняют

действие) большого количества измеренных нами реальных переменных.

Подразумевается, что таких

факторов гораздо меньше, чем исходных переменных.

Factor analysis

Слайд 23

Поясняющий пример:

Мы изучаем кроликов. Сначала взвешиваем каждого из

100 кроликов на безмене, потом на весах с гирьками,

потом на электронных кухонных весах.

Потом мы хотим исследовать влияние питания на вес кроликов.

Неужели мы возьмём в анализ все три переменные? Ведь, очевидно, вес кролика – только одна его характеристика, а не три. Скорее всего, мы захотим превратить все переменные в одну.

Factor analysis

Слайд 24

Подразумевается, что наши реально измеренные переменные являются линейными

комбинациями этих подлежащих факторов.

Примерно так будет проходить новая ось

OX – первая компонента.

Factor analysis

Слайд 25

Итак, мы изучаем питание павианов. Типов пищи у

павианов 10:

апельсины,

бананы,

яблоки,

помидоры,

огурцы,

мясо,

курица,

рыба,

насекомые,

червяки.

Мы измеряем привлекательность пищи каждого типа, для каждого

зверя. Сколько факторов скрывается за разными предпочтениями павианов в еде?

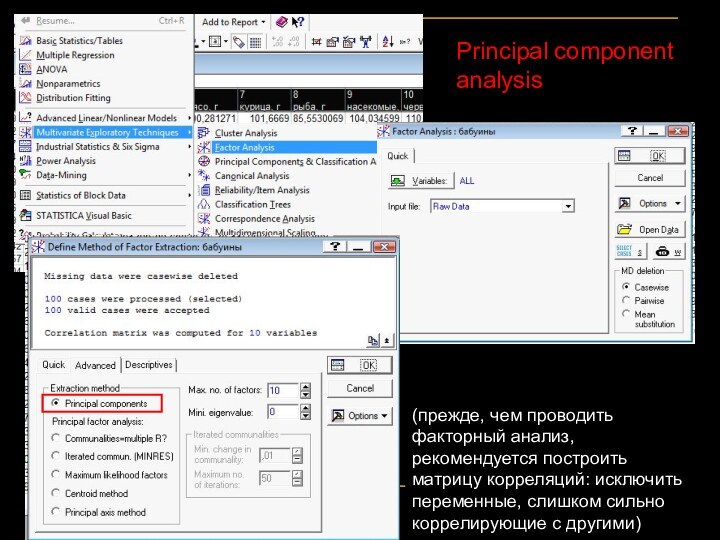

Слайд 26

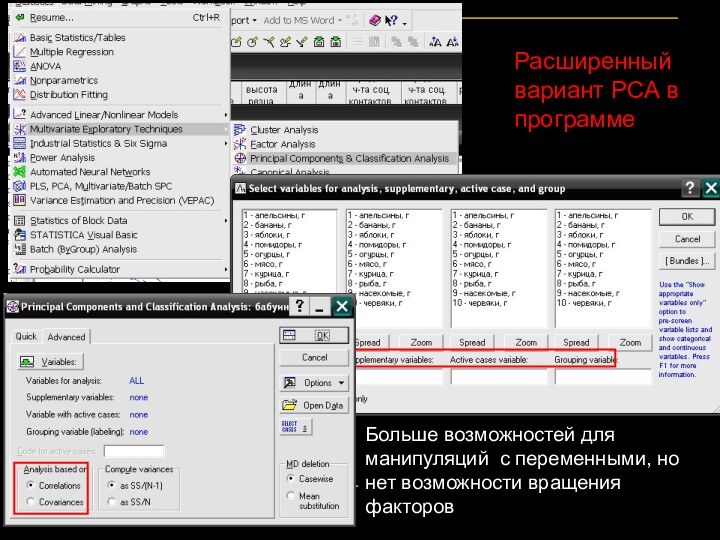

Principal component analysis

(прежде, чем проводить факторный анализ, рекомендуется

построить матрицу корреляций: исключить переменные, слишком сильно коррелирующие с

другими)

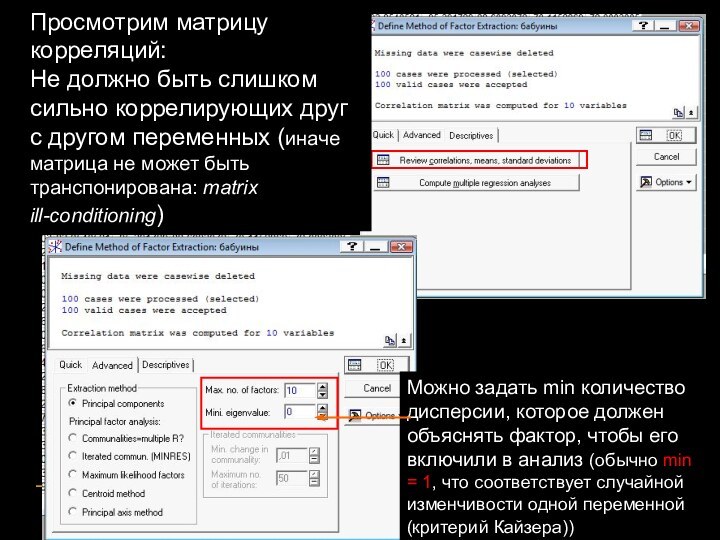

Слайд 27

Просмотрим матрицу корреляций:

Не должно быть слишком сильно коррелирующих

друг с другом переменных (иначе матрица не может быть

транспонирована: matrix ill-conditioning)

Можно задать min количество дисперсии, которое должен объяснять фактор, чтобы его включили в анализ (обычно min = 1, что соответствует случайной изменчивости одной переменной (критерий Кайзера))

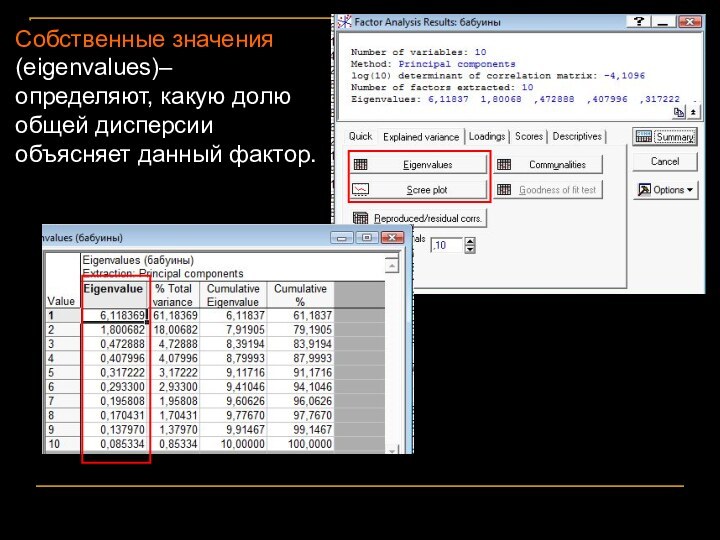

Слайд 28

Собственные значения (eigenvalues)– определяют, какую долю общей дисперсии

объясняет данный фактор.

Слайд 29

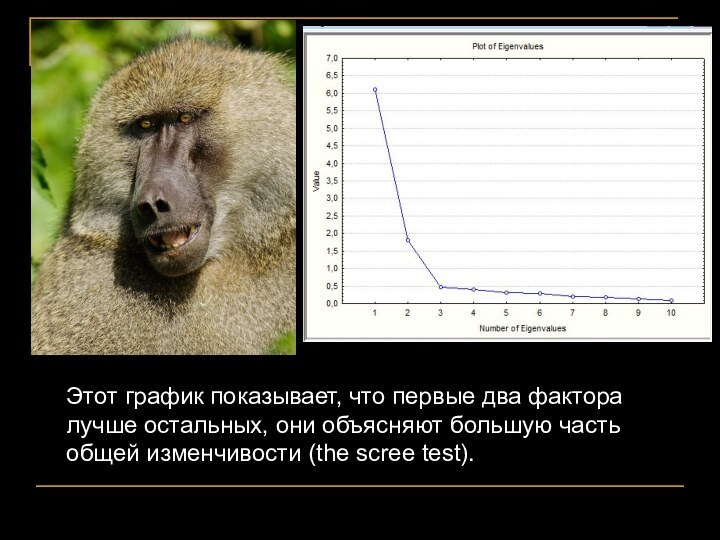

Этот график показывает, что первые два фактора лучше

остальных, они объясняют большую часть общей изменчивости (the scree

test).

Слайд 30

Посмотрим, как полученные факторы связаны с реальными переменными

Слайд 31

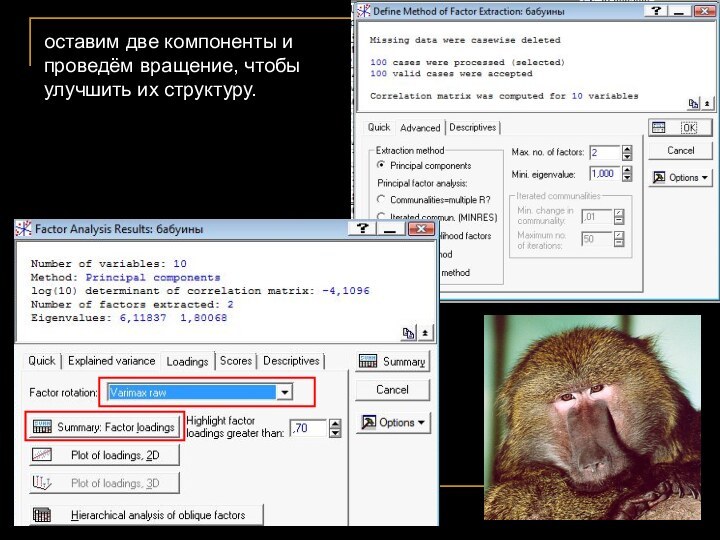

оставим две компоненты и проведём вращение, чтобы улучшить

их структуру.

Слайд 32

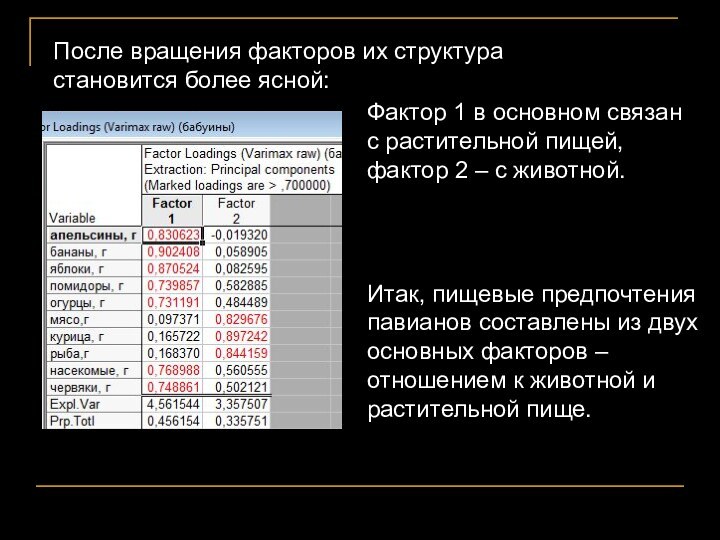

Фактор 1 в основном связан с растительной пищей,

фактор 2 – с животной.

После вращения факторов их структура

становится более ясной:

Итак, пищевые предпочтения павианов составлены из двух основных факторов – отношением к животной и растительной пище.

Слайд 33

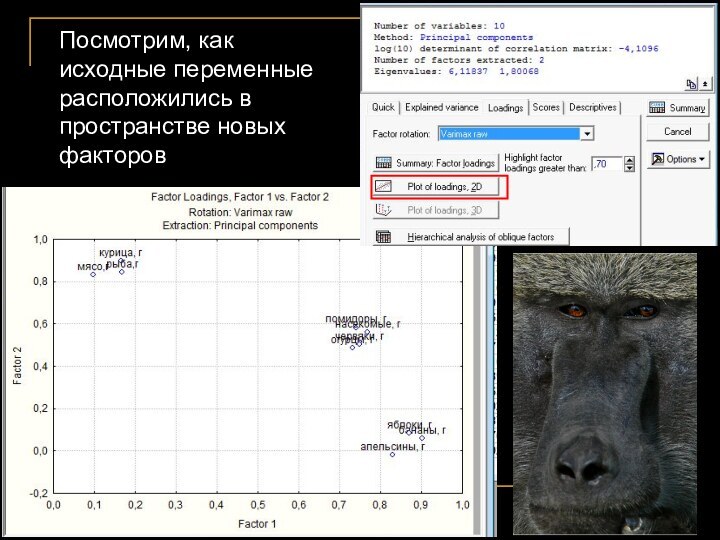

Посмотрим, как исходные переменные расположились в пространстве новых

факторов

Слайд 34

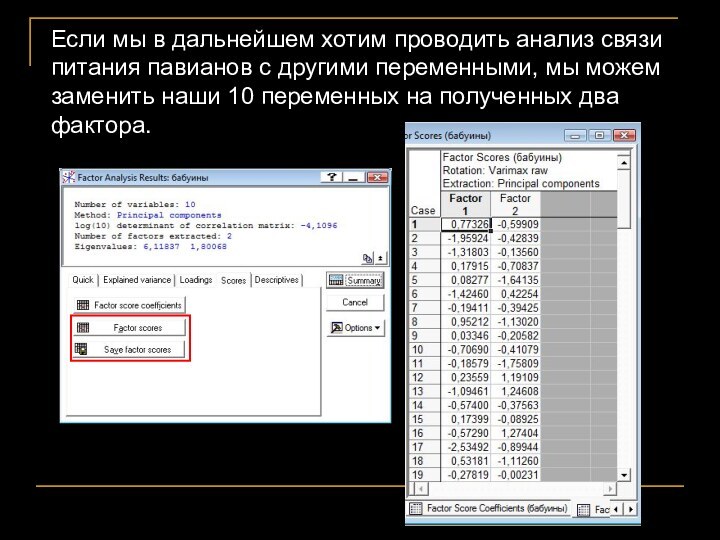

Если мы в дальнейшем хотим проводить анализ связи

питания павианов с другими переменными, мы можем заменить наши

10 переменных на полученных два фактора.

Слайд 35

Требования к выборкам для проведения факторного анализа

Внутри групп

должно быть многомерное нормальное распределение (оценка – на

основе построения гистограмм частот);

Гомогенность дисперсий (для метода главных компонент; не очень критичное требование);

Связь переменных должна быть линейной;

Размер выборки не должен быть меньше 50, оптимальный – ≥100 наблюдений.

Между переменными должна быть ненулевая корреляция, но коэффициентов корреляции, близких единице, тоже быть не должно.

Factor analysis

Слайд 36

Связь с MANOVA и регрессионным анализом.

Factor analysis

Если мы

на самом деле хотим сравнить группы (из объектов с

многими переменными) можно провести MANOVA (это тоже многомерный анализ, но он генерирует только одну переменную), а можно сначала факторный анализ, а потом – однофакторные ANOVA (у второго варианта есть преимущества).

Если мы хотим провести множественный регрессионный анализ, можно сначала сделать факторный анализ для независимых переменных (можно - без сокращения их числа), а потом – регрессионный анализ, убрав проблему скоррелированности исходных переменных.

Слайд 37

Principal factor analysis – если PCA генерирует компоненты,

объясняющие изменчивость исходных переменных, то PFA генерирует common factors,

объясняющие корреляции между переменными.

Correspondence analysis – для анализа таблиц сопряжённости (большого числа качественных переменных) . Сумма eigenvalues = общей статистике χ2 (называется total intertia).

Canonical correlation analysis – если у нас есть два блока переменных и мы хотим анализировать корреляции между ними. Генерирует пары переменных из этих блоков (canonical variates) так, чтобы между ними была максимальная корреляция.

Другие многомерные методы, близкие анализу главных компонент

communality of a variable is the portion that can be reproduced from the respective number of factors

Слайд 38

Redundancy analysis – усложнённая версия Canonical correlation analysis,

предсказывает линейную комбинацию зависимых переменных из комбинации независимых.

Canonical correspondence

analysis – расширенный вариант Correspondence analysis, в котором дополнительно учитывается влияние добавочных количественных переменных.

Другие многомерные методы, близкие анализу главных компонент

На свете много многомерных методов!