- Главная

- Разное

- Бизнес и предпринимательство

- Образование

- Развлечения

- Государство

- Спорт

- Графика

- Культурология

- Еда и кулинария

- Лингвистика

- Религиоведение

- Черчение

- Физкультура

- ИЗО

- Психология

- Социология

- Английский язык

- Астрономия

- Алгебра

- Биология

- География

- Геометрия

- Детские презентации

- Информатика

- История

- Литература

- Маркетинг

- Математика

- Медицина

- Менеджмент

- Музыка

- МХК

- Немецкий язык

- ОБЖ

- Обществознание

- Окружающий мир

- Педагогика

- Русский язык

- Технология

- Физика

- Философия

- Химия

- Шаблоны, картинки для презентаций

- Экология

- Экономика

- Юриспруденция

Что такое findslide.org?

FindSlide.org - это сайт презентаций, докладов, шаблонов в формате PowerPoint.

Обратная связь

Email: Нажмите что бы посмотреть

Презентация на тему Естественнонаучные основы психогенеза

Содержание

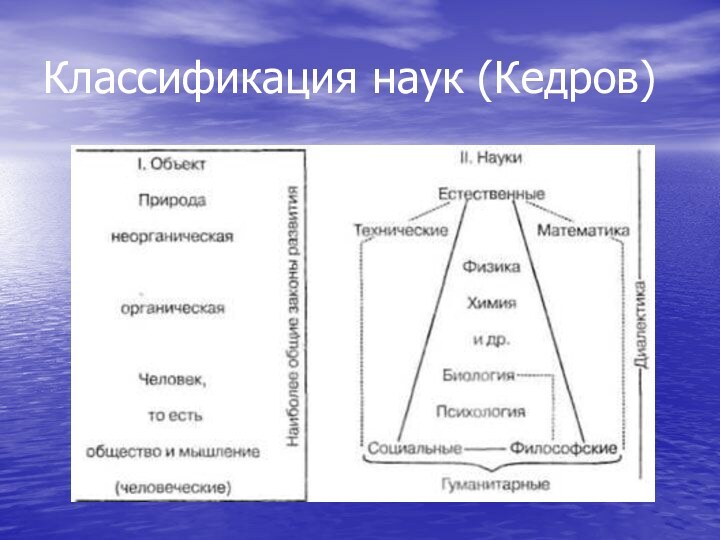

- 2. Классификация наук (Кедров)

- 3. ЭнтропияПонятие энтропии было впервые введено в 1865

- 4. Связь энтропии с вероятностьюВ 1877 году Людвиг

- 5. Информационная энтропияЭнтропия — это количество информации, приходящейся

- 6. Нормальное распределение

- 7. Эксцесс нормального распределения

- 8. ЛитератураИ. Пригожин, Г. Николис Познание сложного, изд.

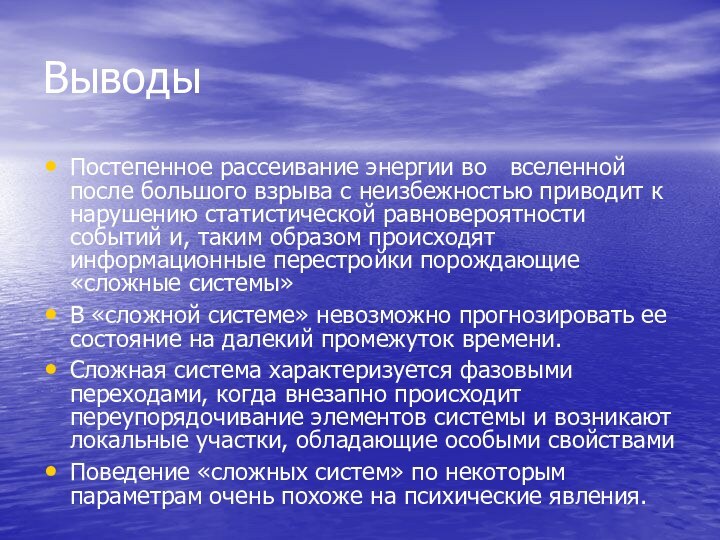

- 9. ВыводыПостепенное рассеивание энергии во вселенной после

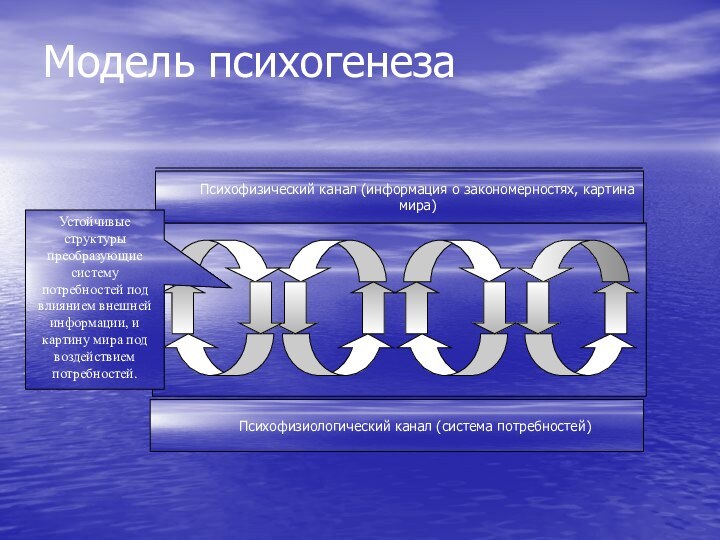

- 10. Модель психогенеза Психофизический канал (информация о закономерностях,

- 11. Треугольник Серпинского

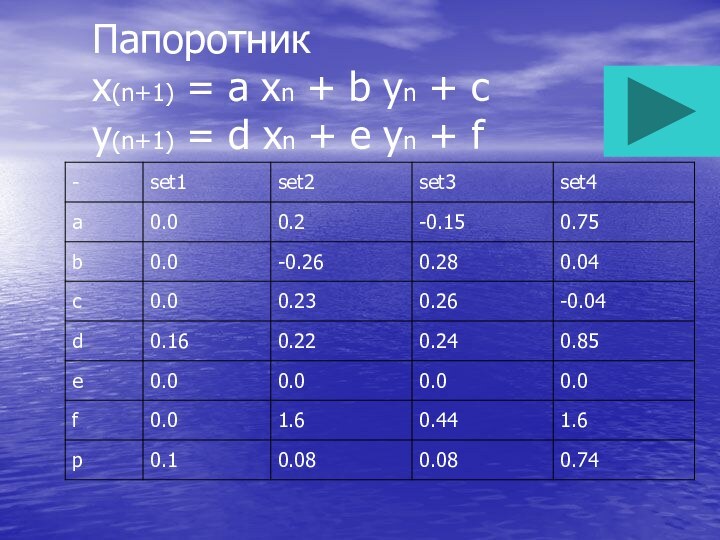

- 12. Папоротник x(n+1) = a xn + b

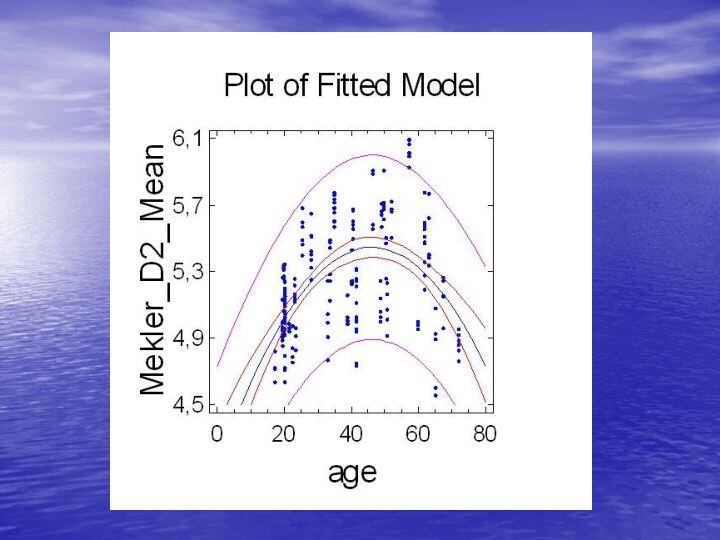

- 13. Изменение меры сложности мозга при осознании смысла текста

- 14. Электрические процессы и нервная система

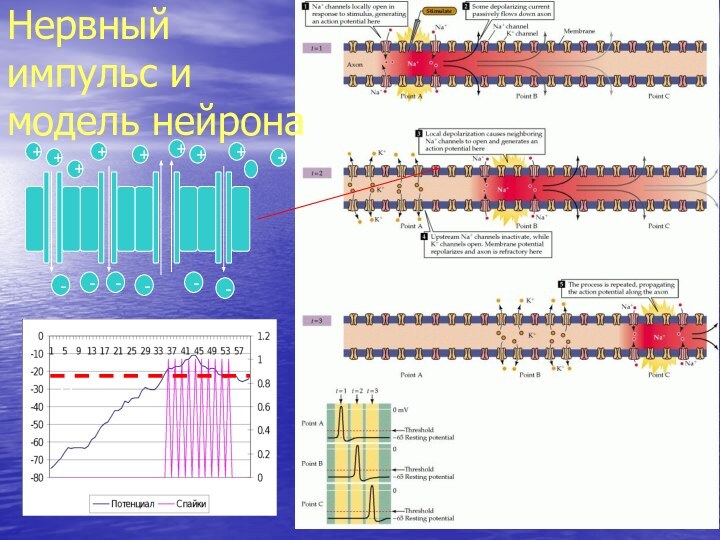

- 15. Нервный импульс и модель нейрона

- 16. Модель нейрона

- 17. НейросетиВсе модели нейронных сетей основаны на нескольких

- 18. Нейросети модель ХопфилдаВ модели Хопфилда каждая изинговская

- 19. Нейронная сетьColorYXZ

- 20. Примеры поведения моделей сложных систем

- 21. ЛитератураХоджкин А. Нервный импульс. М., Мир, 1965Доценко

- 22. Выводы по прошлому занятию Психогенез – процессы, происходящие

- 23. Модификация синапсаМолекулярный механизм формирования долговременной памяти. При изучении

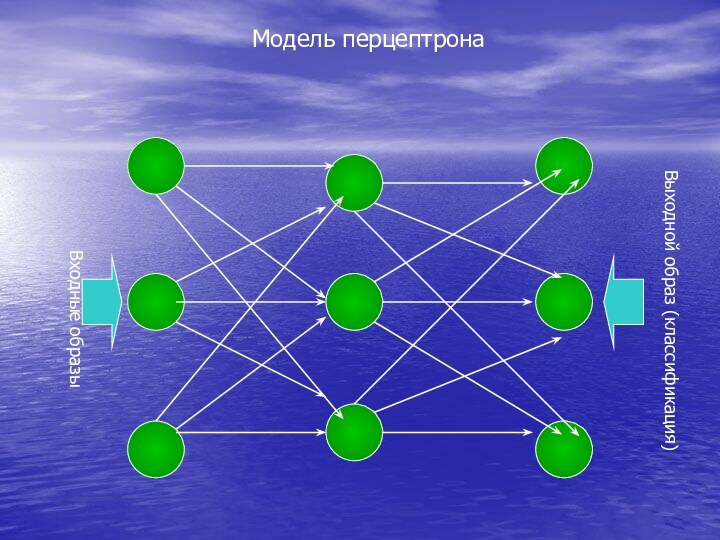

- 24. Модель перцептрона

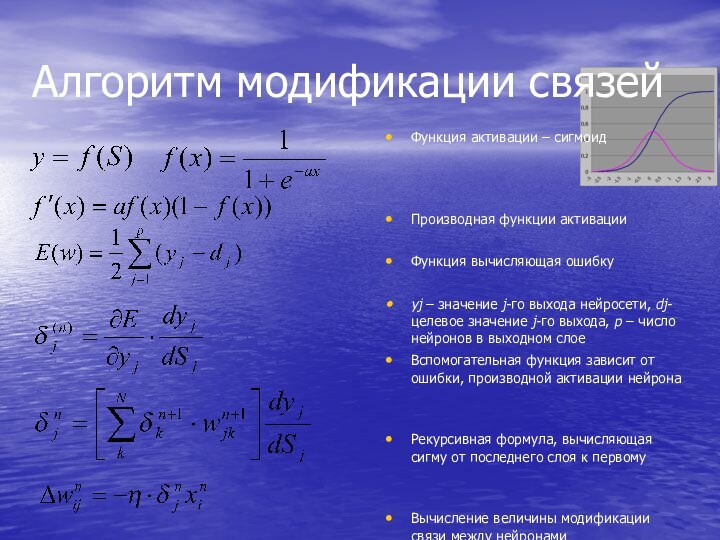

- 25. Алгоритм модификации связейФункция активации – сигмоидПроизводная функции

- 26. Полный алгоритм обучения нейросети: 1. Подать на

- 27. Поверхность решений диагностического алгоритма

- 28. Генетические алгоритмыАлгоритмы эвристического решения большого класса задач,

- 29. В чем генетика реализует приспособительные возможности организмаСтруктура

- 30. ЛитератураГладков Л. А., Курейчик В. В., Курейчик

- 31. Выводы по прошлому занятиюОдной из самых мощных

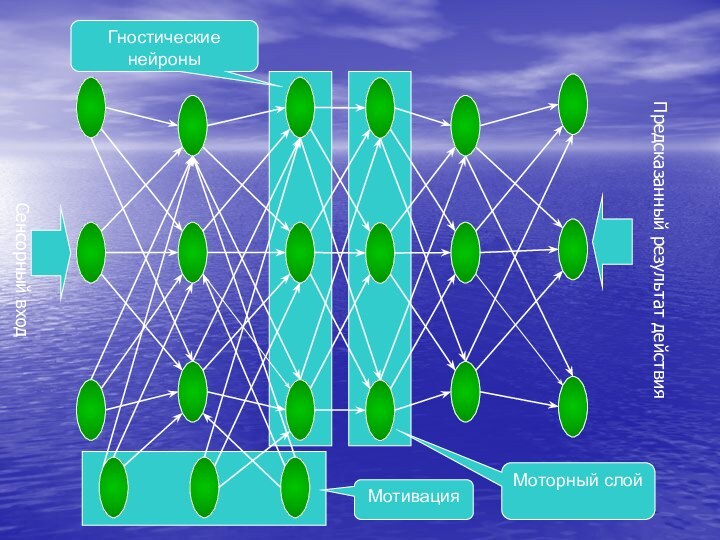

- 32. Сенсорный входПредсказанный результат действияМоторный слойМотивацияГностические нейроны

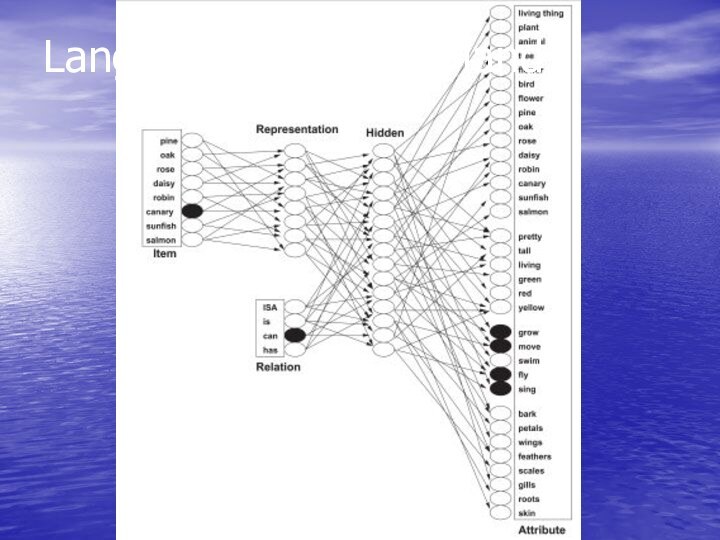

- 33. Langwith WEB (McLelland)

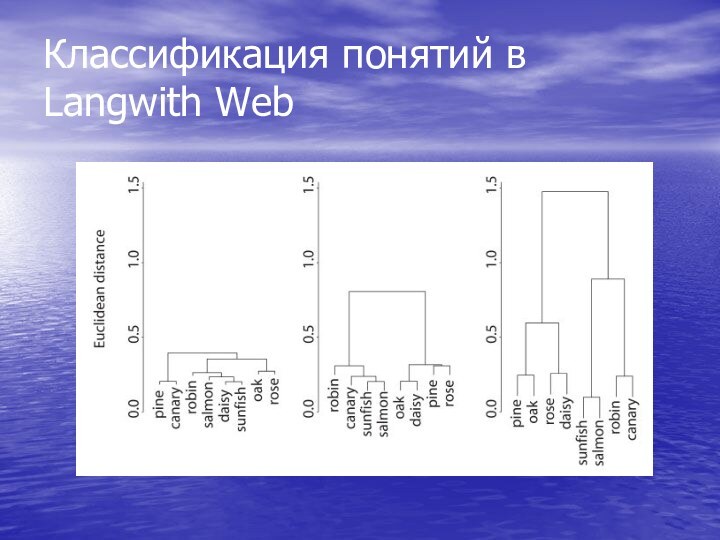

- 34. Классификация понятий в Langwith Web

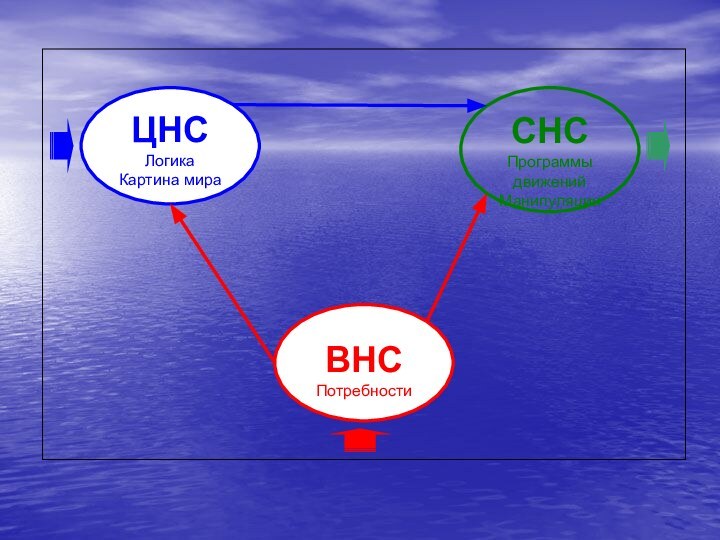

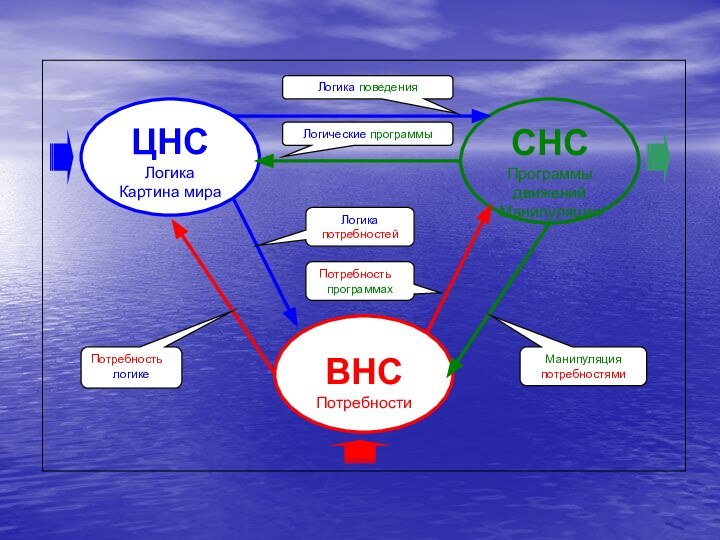

- 35. ЦНСЛогикаКартина мираВНСПотребностиСНСПрограммыдвиженийМанипуляции

- 36. Функциональные блоки мозга (А.Р. Лурия)

- 38. ЛитератураTimothy T. Rogers, James L. McClelland Preсis

- 39. Выводы по предыдущему занятиюНейросеть на основе перцептрона

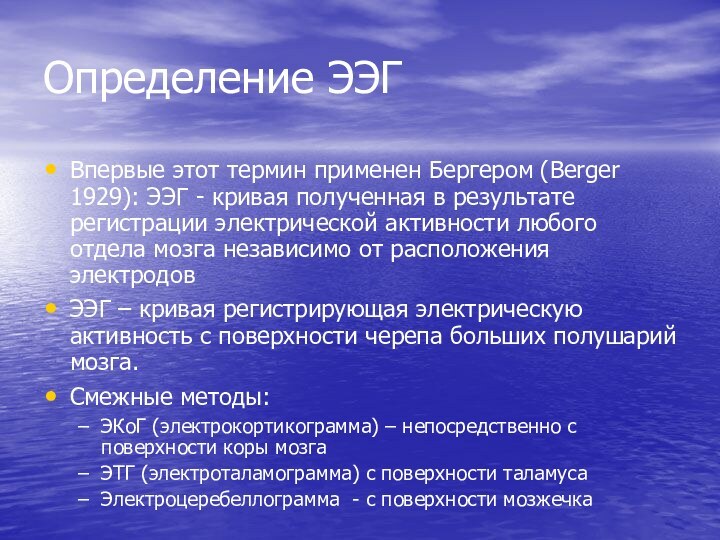

- 40. Определение ЭЭГВпервые этот термин применен Бергером (Berger

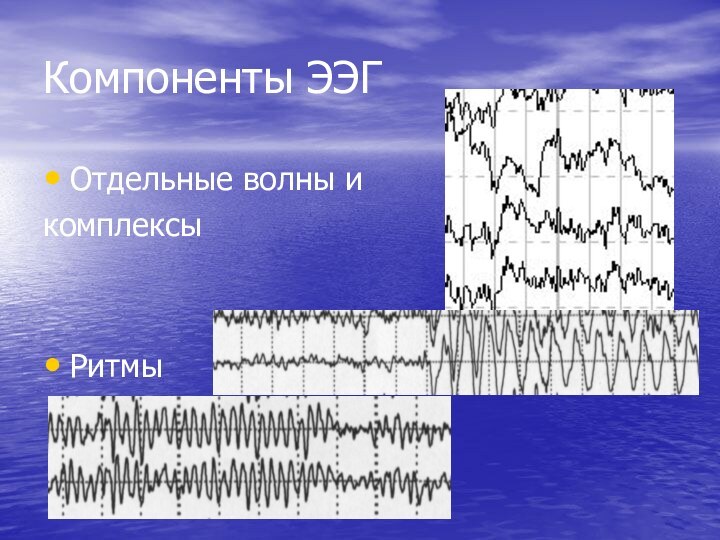

- 41. Компоненты ЭЭГОтдельные волны и комплексыРитмы

- 42. Отведение разности потенциалов-++-

- 43. Электроэнцефалограф

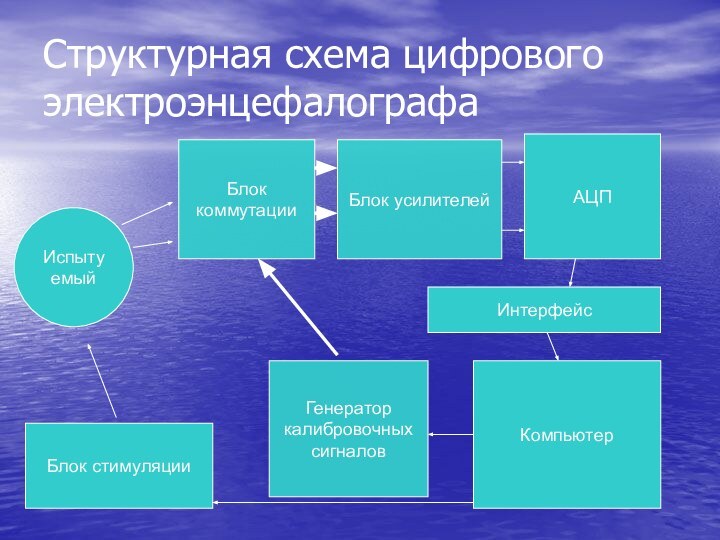

- 44. Структурная схема цифрового электроэнцефалографаБлок коммутацииБлок усилителейАЦПИнтерфейсКомпьютерБлок стимуляцииГенератор калибровочных сигналовИспытуемый

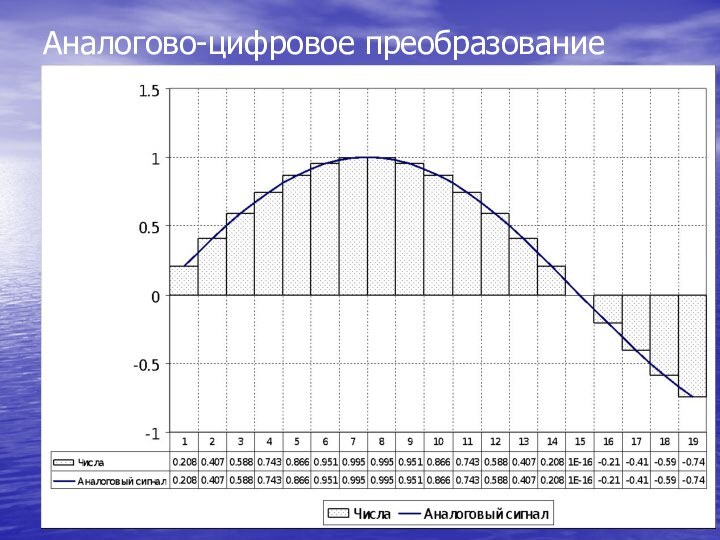

- 45. Аналогово-цифровое преобразование

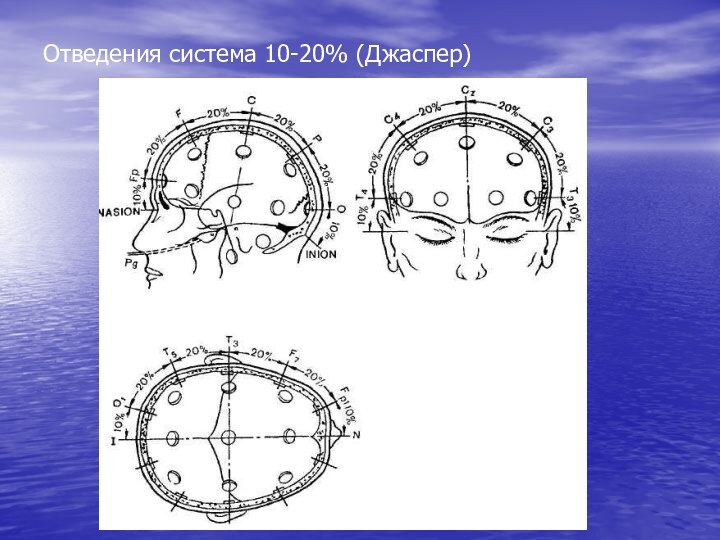

- 46. Отведения система 10-20% (Джаспер)

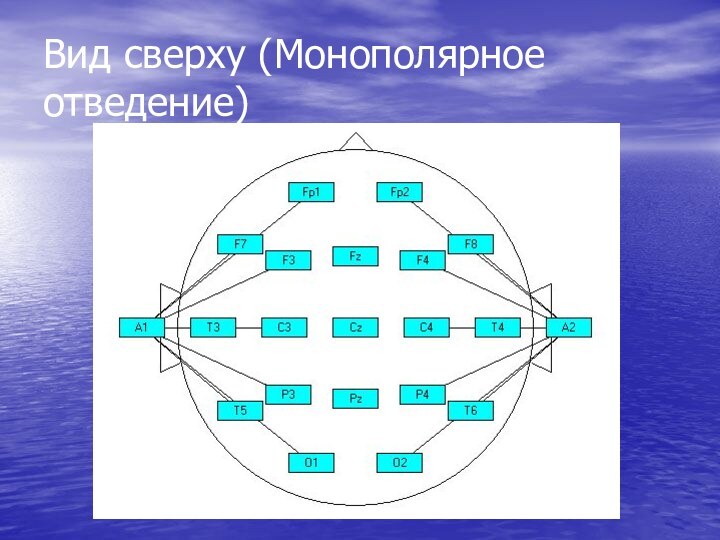

- 47. Вид сверху (Монополярное отведение)

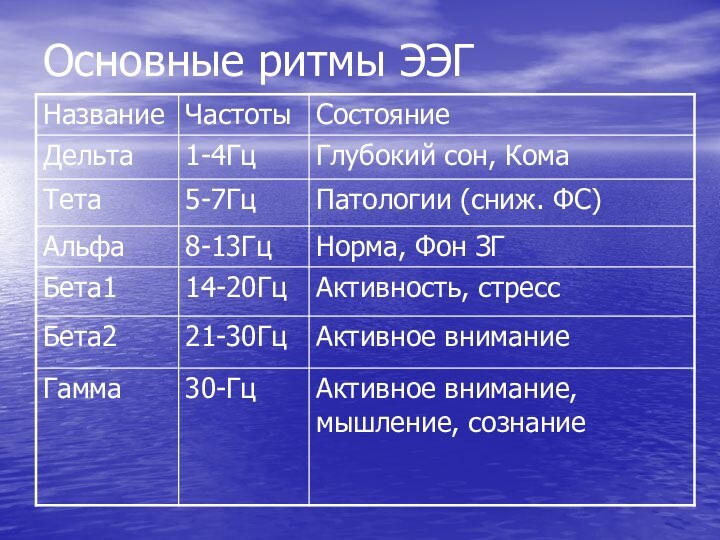

- 48. Основные ритмы ЭЭГ

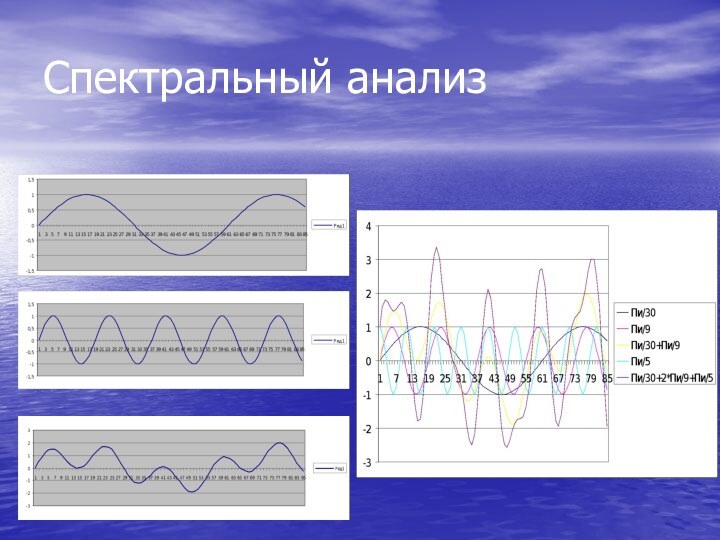

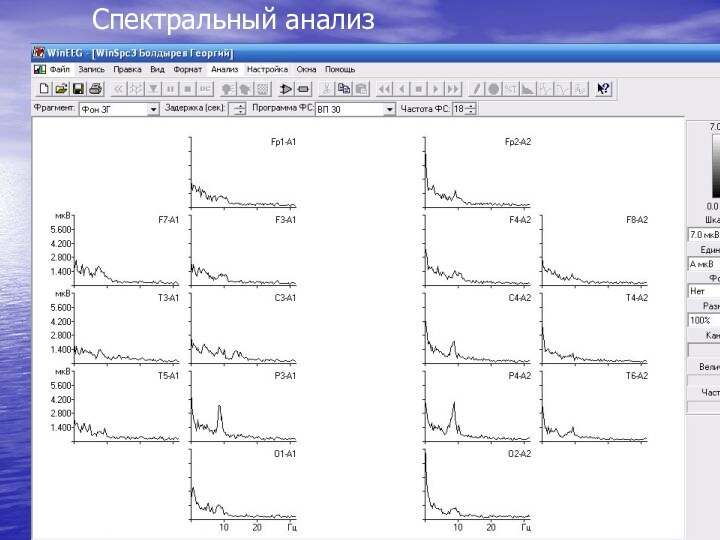

- 49. Спектральный анализ

- 50. Спектральный анализ

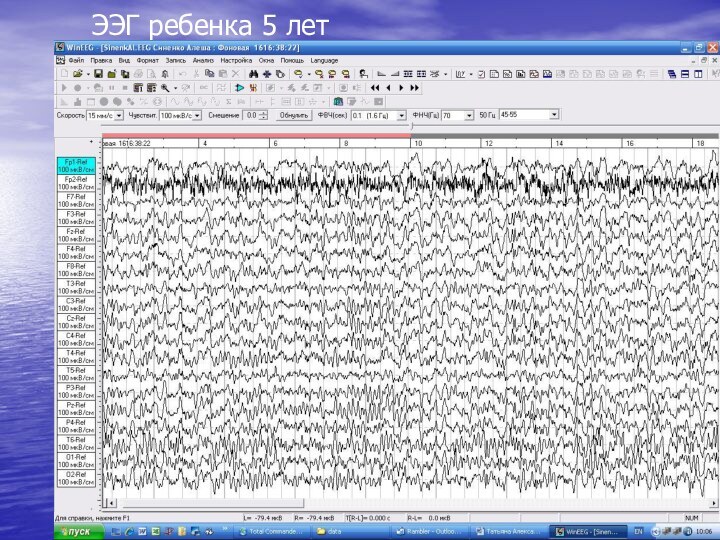

- 52. ЭЭГ ребенка 5 лет

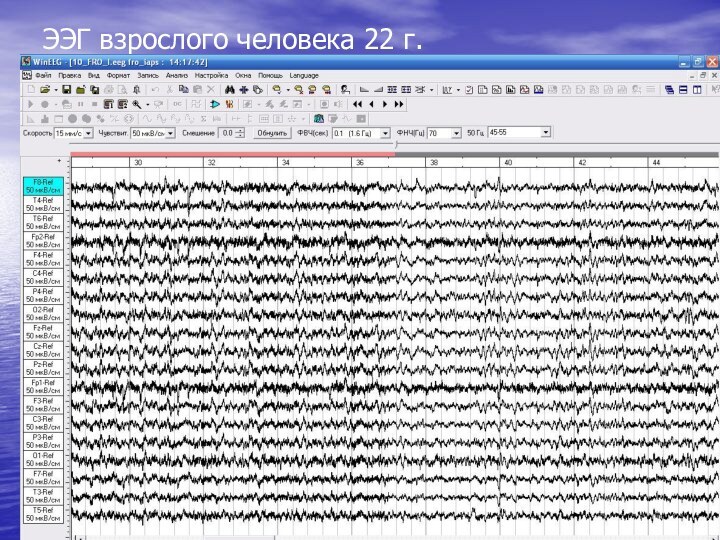

- 53. ЭЭГ взрослого человека 22 г.

- 54. ЛитератураГусельников В.И. Электрофизиология головного мозга (курс лекций)

- 55. Вызванные потенциалы мозга Занятие 2

- 56. Event-Related Potentials (Vaughan, 1969 ) В характеристиках

- 57. ИсторияСвязь электрической активности мозга с событиями в

- 58. Параметры и особенности ВПЧастотный диапазон 0-300 Гц.

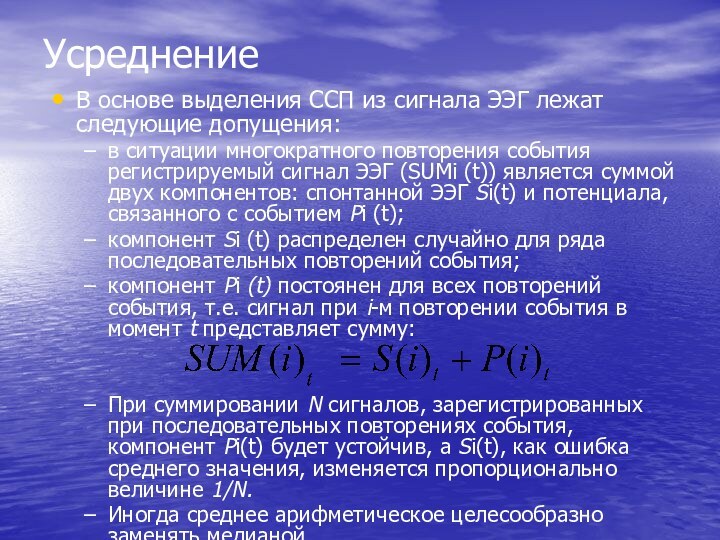

- 59. УсреднениеВ основе выделения ССП из сигнала ЭЭГ

- 60. Количество предъявленийпри суммировании 25 реализаций ЭЭГ в

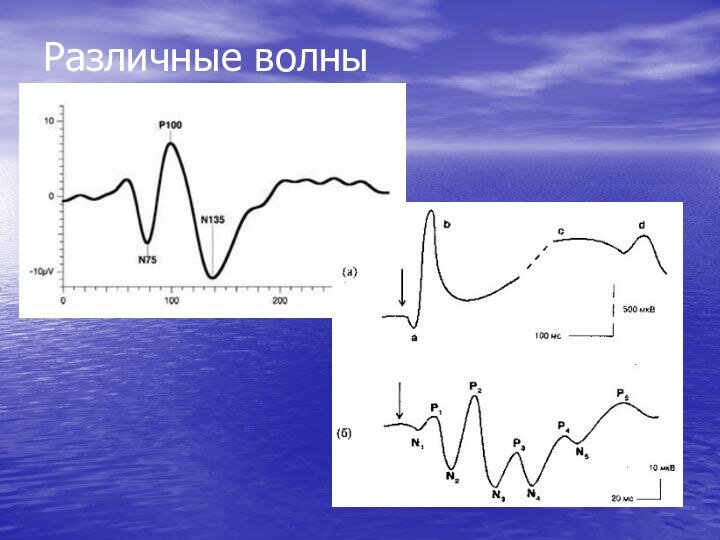

- 61. Различные волны

- 62. Варианты последующего анализаВизуальное или компьютерное выделение амплитуд

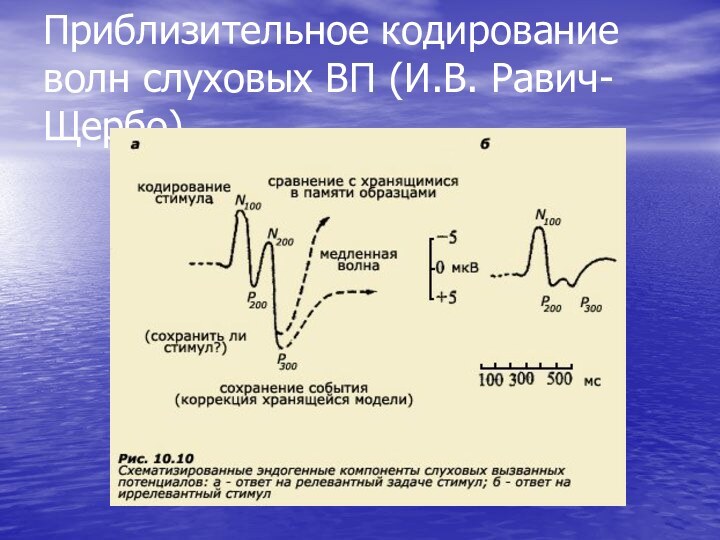

- 63. Приблизительное кодирование волн слуховых ВП (И.В. Равич-Щербо)

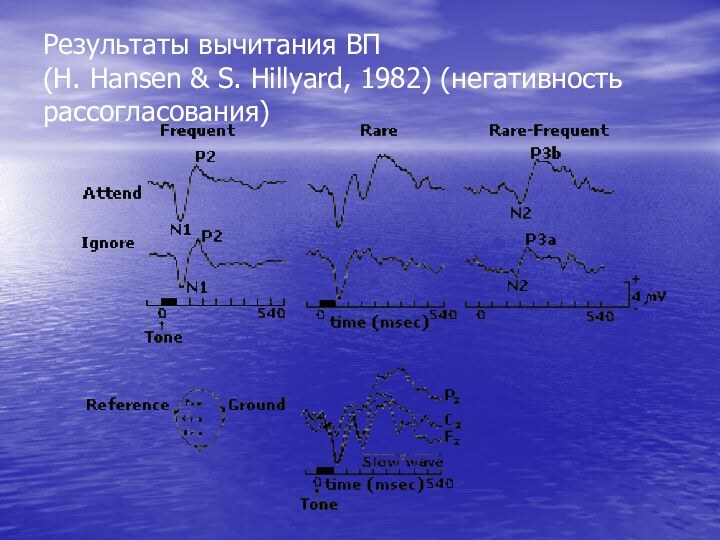

- 64. Результаты вычитания ВП (H. Hansen & S. Hillyard, 1982) (негативность рассогласования)

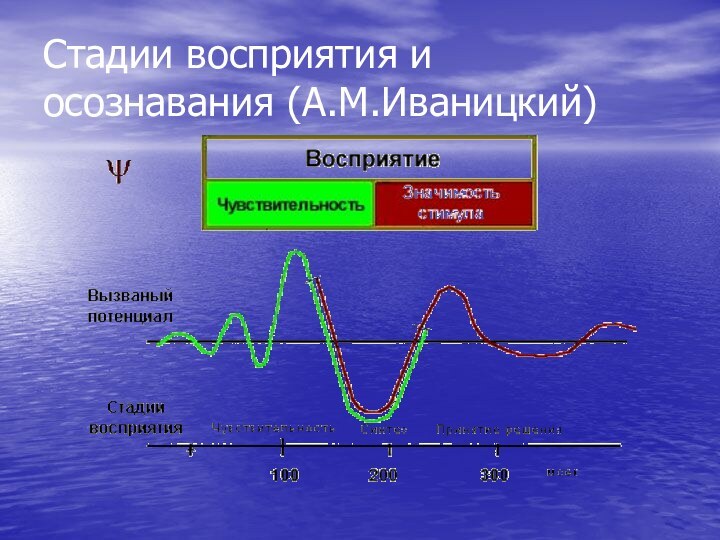

- 65. Стадии восприятия и осознавания (А.М.Иваницкий)

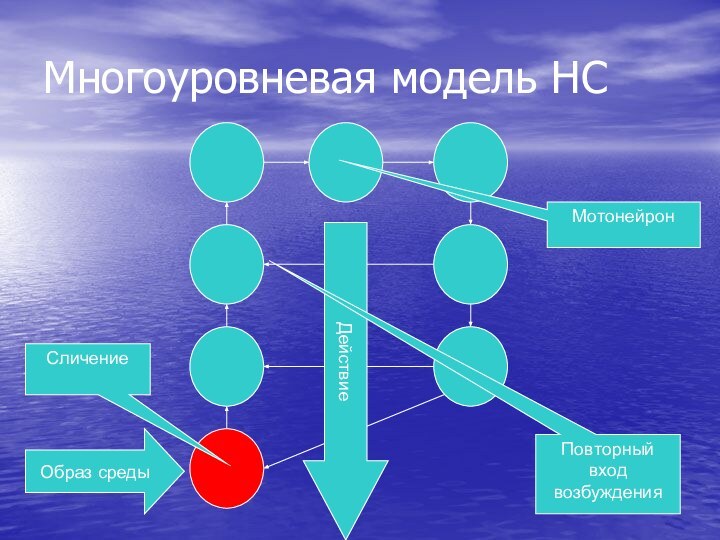

- 66. Многоуровневая модель НСОбраз средыСличениеДействиеПовторный вход возбужденияМотонейрон

- 67. Скачать презентацию

- 68. Похожие презентации

Классификация наук (Кедров)

Слайд 4

Связь энтропии с вероятностью

В 1877 году Людвиг Больцман

установил связь энтропии с вероятностью данного состояния. Позднее эту

связь представил в виде формулы Макс Планк:где константа k = 1,38×10−23 Дж/К названа Планком постоянной Больцмана, а Ω — статистический вес состояния, является числом возможных микросостояний (способов) с помощью которых можно перейти в данное макроскопическое состояние.

Существует мнение, что мы можем смотреть на Ω и как на меру беспорядка в системе. В определённом смысле это может быть оправдано, потому что мы думаем об «упорядоченных» системах как о системах, имеющих очень малую возможность конфигурирования, а о «беспорядочных» системах как об имеющих очень много возможных состояний. Собственно, это просто переформулированное определение энтропии как числа микросостояний на данное макросостояние.

Слайд 5

Информационная энтропия

Энтропия — это количество информации, приходящейся на

одно элементарное сообщение источника, вырабатывающего статистически независимые сообщения

Информационная двоичная

энтропия для независимых случайных событий x с n возможными состояниями (от 1 до n, p - функция вероятности) рассчитывается по формуле:Таким образом, энтропия события x является суммой с противоположным знаком всех произведений относительных частот появления события i, умноженных на их же двоичные логарифмы[1]. Это определение для дискретных случайных событий можно расширить для функции распределения вероятностей.

Слайд 8

Литература

И. Пригожин, Г. Николис Познание сложного, изд. ЛКИ,

2008

Г. Хакен : «синергетика, Введение: Неравновесные фазовые переходы и

самоорганизация в области физики, химии и биологии", 3-й ред. enl. ЭНЛ. ed. издание New York: Springer-Verlag, 1983. Нью-Йорк: Springer-Verlag, 1983. Shannon, Claude E.: Prediction and entropy of printed English, The Bell System Technical Journal , 30:50-64, January 1951.

Слайд 9

Выводы

Постепенное рассеивание энергии во вселенной после большого

взрыва с неизбежностью приводит к нарушению статистической равновероятности событий

и, таким образом происходят информационные перестройки порождающие «сложные системы»В «сложной системе» невозможно прогнозировать ее состояние на далекий промежуток времени.

Сложная система характеризуется фазовыми переходами, когда внезапно происходит переупорядочивание элементов системы и возникают локальные участки, обладающие особыми свойствами

Поведение «сложных систем» по некоторым параметрам очень похоже на психические явления.

Слайд 10

Модель психогенеза

Психофизический канал (информация о закономерностях, картина

мира)

Психофизиологический канал (система потребностей)

Устойчивые структуры преобразующие систему потребностей под

влиянием внешней информации, и картину мира под воздействием потребностей.

Слайд 17

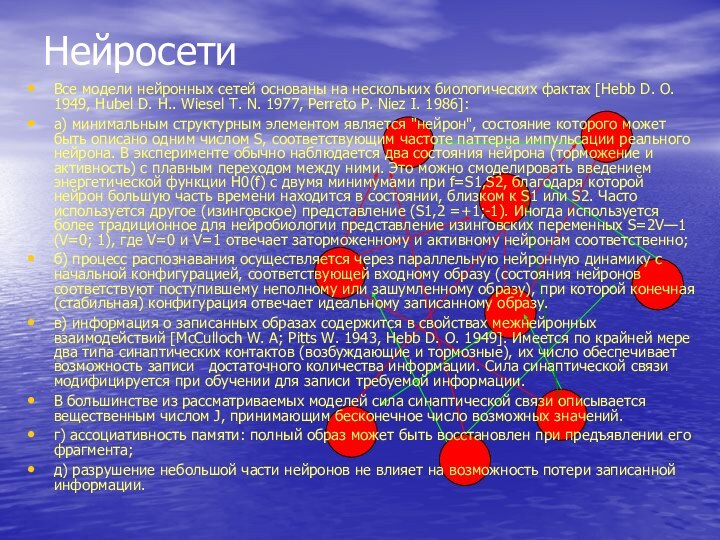

Нейросети

Все модели нейронных сетей основаны на нескольких биологических

фактах [Hebb D. O. 1949, Hubel D. H.. Wiesel

T. N. 1977, Perreto P. Niez I. 1986]:а) минимальным структурным элементом является "нейрон", состояние которого может быть описано одним числом S, соответствующим частоте паттерна импульсации реального нейрона. В эксперименте обычно наблюдается два состояния нейрона (торможение и активность) с плавным переходом между ними. Это можно смоделировать введением энергетической функции Н0(f) с двумя минимумами при f=S1,S2, благодаря которой нейрон большую часть времени находится в состоянии, близком к S1 или S2. Часто используется другое (изинговское) представление (S1,2 =+1;-1). Иногда используется более традиционное для нейробиологии представление изинговских переменных S=2V—1 (V=0; 1), где V=0 и V=1 отвечает заторможенному и активному нейронам соответственно;

б) процесс распознавания осуществляется через параллельную нейронную динамику с начальной конфигурацией, соответствующей входному образу (состояния нейронов соответствуют поступившему неполному или зашумленному образу), при которой конечная (стабильная) конфигурация отвечает идеальному записанному образу.

в) информация о записанных образах содержится в свойствах межнейронных взаимодействий [McCulloch W. A; Pitts W. 1943, Hebb D. O. 1949]. Имеется по крайней мере два типа синаптических контактов (возбуждающие и тормозные), их число обеспечивает возможность записи достаточного количества информации. Сила синаптической связи модифицируется при обучении для записи требуемой информации.

В большинстве из рассматриваемых моделей сила синаптической связи описывается вещественным числом J, принимающим бесконечное число возможных значений.

г) ассоциативность памяти: полный образ может быть восстановлен при предъявлении его фрагмента;

д) разрушение небольшой части нейронов не влияет на возможность потери записанной информации.

Слайд 18

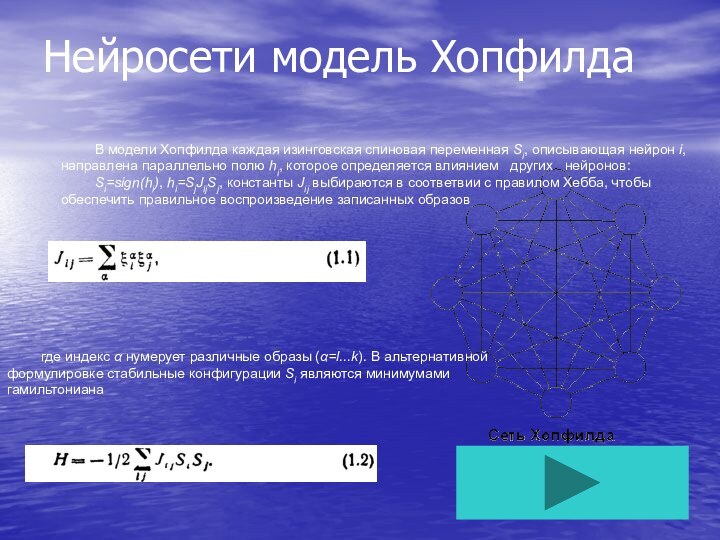

Нейросети модель Хопфилда

В модели Хопфилда каждая изинговская спиновая

переменная Si, описывающая нейрон i, направлена параллельно полю hi,

которое определяется влиянием других нейронов:Si=sign(hi), hi=SjJijSj, константы Jij выбираются в соответвии с правилом Хебба, чтобы обеспечить правильное воспроизведение записанных образов

где индекс α нумерует различные образы (α=l...k). В альтернативной формулировке стабильные конфигурации Si являются минимумами гамильтониана

Слайд 21

Литература

Ходжкин А. Нервный импульс. М., Мир, 1965

Доценко Вик.

С., Иоффе Л. Б., Фейгельман М. В., Цодыкс М.

В. Статистические модели нейронных сетей // В кн.: Итоги науки и техники. Серия «Физические и математические модели нейронных сетей». Том 1. Часть I. «Спиновые стекла и нейронные сети» / Ред.: А. А. Веденов. – М.: ВИНИТИ, 1990.Осовский С. Нейронные сети для обработки информации Изд-во: Финансы и статистика, 2002.

Слайд 22

Выводы по прошлому занятию

Психогенез – процессы, происходящие на

информационном стыке двух сред, осуществляемом нервной системой - внутренней

средой организма и внешней средой, характеризующиеся появлением в ней неравновесных состояний, изменениями энтропии, процессами локализации и структурирования, изменения связей между модулями нервной системы, и порождающие «сложное» поведение.Например, процесс осознания смысла текста характеризуется изменением «сложности» биоэлектрической активности мозга.

Передача информации в нервной системе осуществляется с помощью биоэлектрических процессов, характеризующихся медленной скоростью, но параллельных по времени.

Поведение нейросети и информация, записываемая в ней целиком зависит от силы связей, объединяющих элементы сети «нейроны».

Одна из упрощенных моделей нервной системы – математическая модель нейросети может обладать определенным «сложным поведением», характеризующимся аттрактором фрактальной размерности

Слайд 23

Модификация синапса

Молекулярный механизм формирования долговременной памяти.

При изучении защитного

рефлекса (втягивание жабры в ответ на стимуляцию сифона) у

морского зайца установлено, что нейромедиаторы, действующие на клетку, вызывают в ней каскад молекулярных реакций (показано стрелками).В результате изменяется форма и функции синапсов, что приводит к длительным модификациям защитного рефлекса.

Слайд 25

Алгоритм модификации связей

Функция активации – сигмоид

Производная функции активации

Функция

вычисляющая ошибку

yj – значение j-го выхода нейросети, dj- целевое

значение j-го выхода, p – число нейронов в выходном слое Вспомогательная функция зависит от ошибки, производной активации нейрона

Рекурсивная формула, вычисляющая сигму от последнего слоя к первому

Вычисление величины модификации связи между нейронами

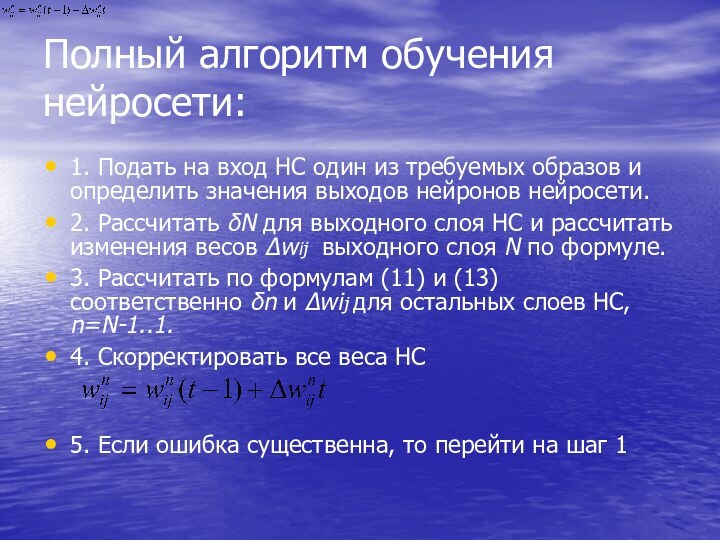

Слайд 26

Полный алгоритм обучения нейросети:

1. Подать на вход

НС один из требуемых образов и определить значения выходов

нейронов нейросети.2. Рассчитать δN для выходного слоя НС и рассчитать изменения весов Δwij выходного слоя N по формуле.

3. Рассчитать по формулам (11) и (13) соответственно δn и Δwij для остальных слоев НС, n=N-1..1.

4. Скорректировать все веса НС

5. Если ошибка существенна, то перейти на шаг 1

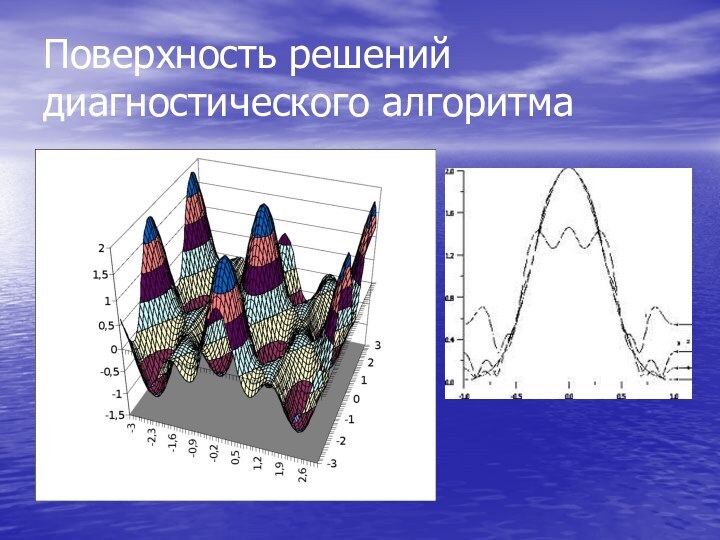

Слайд 28

Генетические алгоритмы

Алгоритмы эвристического решения большого класса задач, основанные

на эволюционной динамике. Преимущества – устойчивость к локальным минимумам,

отсутствие необходимости знаний о характеристиках решаемой задачи.

Слайд 29

В чем генетика реализует приспособительные возможности организма

Структура белков

синтезируемых в организме

Структура органов и тканей

Структура нервной сети (начальная)

: Генетические программы, начальная точка обучения

Слайд 30

Литература

Гладков Л. А., Курейчик В. В., Курейчик В.

М. Генетические алгоритмы: Учебное пособие — 2-е изд.. — М: Физматлит,

2006Рутковская Д., Пилиньский М., Рутковский Л. Нейронные сети, генетические алгоритмы и нечеткие системы — 2-е изд.. — М: Горячая линия-Телеком, 2008

Слайд 31

Выводы по прошлому занятию

Одной из самых мощных и

быстрых на сегодняшний день самообучающихся диагностических систем (аналогов человеческих

ощущений и восприятия) является модель многослойного перцептрона с возможностью самообучения -алгоритмом Back propagation error.В нервной системе человека аналогом самообучения является модификация химических синапсов.

Проблемой самообучения перцептронов является попадание в локальные минимумы поверхности решений, переобучение и необходимость внешнего учителя.

Внешнего учителя можно заменить процессом формирования образа будущего результата действия и сличением этого образа с реальным результатом

Генетические алгоритмы (аналог естественного отбора в биологии) лишены проблемы локальных минимумов.

Сочетание естественного отбора, задающего начальную точку обучения, наиболее близкую к вероятным «глобальным» минимумам и самообучения позволяет организму быстро адаптироваться в изменяющихся условиях среды

Слайд 38

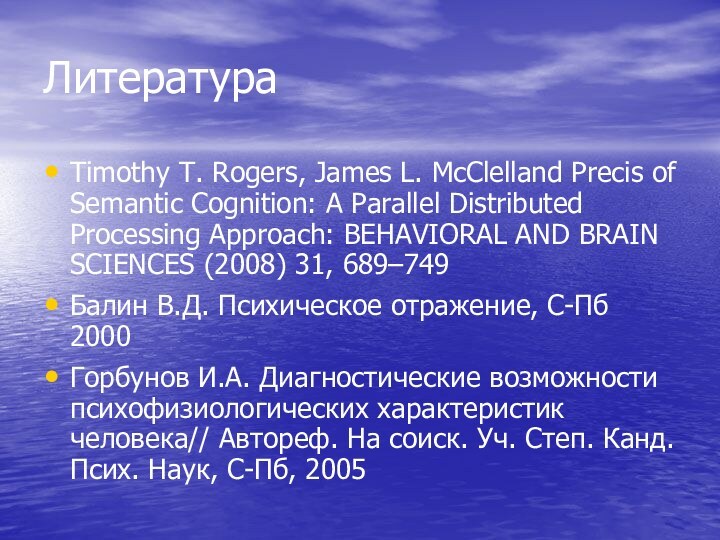

Литература

Timothy T. Rogers, James L. McClelland Preсis of

Semantic Cognition: A Parallel Distributed Processing Approach: BEHAVIORAL AND

BRAIN SCIENCES (2008) 31, 689–749Балин В.Д. Психическое отражение, С-Пб 2000

Горбунов И.А. Диагностические возможности психофизиологических характеристик человека// Автореф. На соиск. Уч. Степ. Канд. Псих. Наук, С-Пб, 2005

Слайд 39

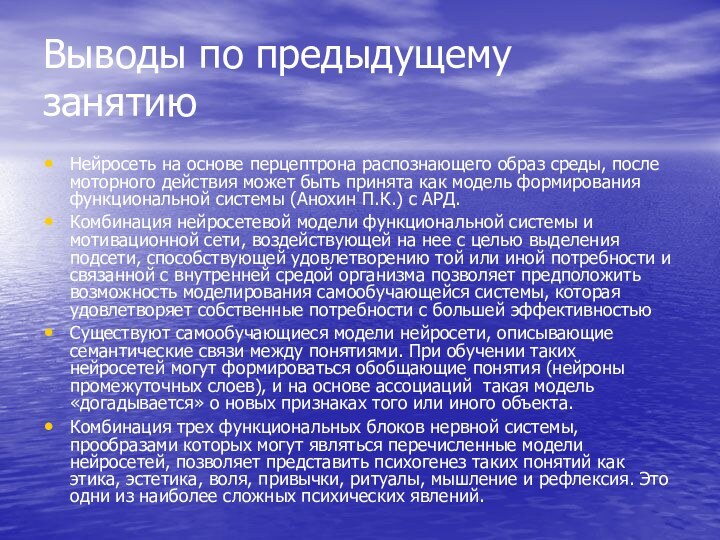

Выводы по предыдущему занятию

Нейросеть на основе перцептрона распознающего

образ среды, после моторного действия может быть принята как

модель формирования функциональной системы (Анохин П.К.) с АРД.Комбинация нейросетевой модели функциональной системы и мотивационной сети, воздействующей на нее с целью выделения подсети, способствующей удовлетворению той или иной потребности и связанной с внутренней средой организма позволяет предположить возможность моделирования самообучающейся системы, которая удовлетворяет собственные потребности с большей эффективностью

Существуют самообучающиеся модели нейросети, описывающие семантические связи между понятиями. При обучении таких нейросетей могут формироваться обобщающие понятия (нейроны промежуточных слоев), и на основе ассоциаций такая модель «догадывается» о новых признаках того или иного объекта.

Комбинация трех функциональных блоков нервной системы, прообразами которых могут являться перечисленные модели нейросетей, позволяет представить психогенез таких понятий как этика, эстетика, воля, привычки, ритуалы, мышление и рефлексия. Это одни из наиболее сложных психических явлений.

Слайд 40

Определение ЭЭГ

Впервые этот термин применен Бергером (Berger 1929):

ЭЭГ - кривая полученная в результате регистрации электрической активности

любого отдела мозга независимо от расположения электродовЭЭГ – кривая регистрирующая электрическую активность с поверхности черепа больших полушарий мозга.

Смежные методы:

ЭКоГ (электрокортикограмма) – непосредственно с поверхности коры мозга

ЭТГ (электроталамограмма) с поверхности таламуса

Электроцеребеллограмма - с поверхности мозжечка

Слайд 44

Структурная схема цифрового электроэнцефалографа

Блок

коммутации

Блок усилителей

АЦП

Интерфейс

Компьютер

Блок стимуляции

Генератор

калибровочных

сигналов

Испытуемый

Слайд 54

Литература

Гусельников В.И. Электрофизиология головного мозга (курс лекций) М.,

Высшая школа, 1976.

Л. Р. Зенков Клиническая электроэнцефалография с

элементами эпилептологии М. МедПрессИнформ 2004Вассерман Е.Л., Карташев Н.К., Полонников Р.И. Распознавание типов патологии у детей с односторонними поражениями головного мозга с использованием анализа фрактальной динамики электроэнцефалограмм // Труды СПИИРАН. 2002. Вып. 1. Т. 1. С. 333–345

Слайд 56

Event-Related Potentials (Vaughan, 1969 )

В характеристиках ССП проявляется

связь активности мозга с событиями во внешней среде:

например, с

предъявлением стимулов во внешне наблюдаемом поведении испытуемого (например, с двигательной активностью)

с психологическими характеристиками активности испытуемого (например, с ожиданием или с принятием решения) [Rockstroh et al., 1982].

Слайд 57

История

Связь электрической активности мозга с событиями в окружающей

среде и поведении впервые была продемонстрирована и описана англичанином

Р.Кейтоном (Richard Caton) в 1875–1887 гг. и независимо от него русским ученым В.Я. Данилевским в 1875 г. [Brazier, 1984].В 1890–1891 гг. А. Беком были исследованы потенциалы на свет в окципитальной коре и на звук – в височной. В 1898 г. В.Е. Ларионовым было проведено сопоставление вызванной электрической активности в разных областях коры

Слайд 58

Параметры и особенности ВП

Частотный диапазон 0-300 Гц. В

отдельных исследованиях до 3 кГц

Амплитуда 1-10 мкВ

Длительность -1-1000 мс

Монополярный

метод отведения (обычно)Аналогово-цифровое преобразование

Многократное предъявление

Усреднение

Слайд 59

Усреднение

В основе выделения ССП из сигнала ЭЭГ лежат

следующие допущения:

в ситуации многократного повторения события регистрируемый сигнал ЭЭГ

(SUMi (t)) является суммой двух компонентов: спонтанной ЭЭГ Si(t) и потенциала, связанного с событием Pi (t);компонент Si (t) распределен случайно для ряда последовательных повторений события;

компонент Pi (t) постоянен для всех повторений события, т.е. сигнал при i-м повторении события в момент t представляет сумму:

При суммировании N сигналов, зарегистрированных при последовательных повторениях события, компонент Pi(t) будет устойчив, a Si(t), как ошибка среднего значения, изменяется пропорционально величине 1/N.

Иногда среднее арифметическое целесообразно заменять медианой

Слайд 60

Количество предъявлений

при суммировании 25 реализаций ЭЭГ в полученном

ССП отношение сигнал/шум будет 1 : 5,

при 100

реализациях – 1 : 10 Для обычных ВП и УНВ достаточно 30-50 реализаций

Для стволовых ВП более 4000

Слайд 62

Варианты последующего анализа

Визуальное или компьютерное выделение амплитуд и

латентностей определенных волн (P100,N200,P300)

Определение компонентов ВП отличающихся в различных

состояниях или при предъявлении различных стимулов, при протекании различных психических процессовЛокализация дипольных источников потенциалов